В последнее десятилетие искусственный интеллект стал одним из главных драйверов инноваций в технологической индустрии. От автоматизации повседневных задач до революционных изменений в области медицины, транспорта и коммуникаций — ИИ открывает беспрецедентные возможности. Крупнейшие мировые технологические компании активно внедряют ИИ в свои продукты и услуги, обещая пользователям улучшенный опыт, более быстрые решения и масштабируемые инновации. Однако вместе с ростом популярности и масштабом применения искусственного интеллекта усиливается и внимание со стороны регуляторов, экспертов и конечных пользователей к правдивости заявлений об этих технологиях. Последнее время стало заметно, что некоторые компании вынуждены пересматривать рекламные и технические утверждения касательно своих ИИ-продуктов, которые ранее подвергались критике за завышенные обещания и недостаток прозрачности.

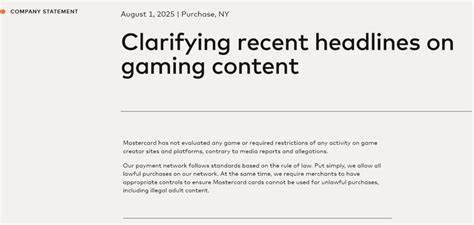

Одной из ключевых причин пересмотра заявлений является возросшая озабоченность по поводу этических аспектов ИИ, а также вопросы, связанные с точностью и надежностью алгоритмов. Например, некоторые рекламные кампании демонстрировали возможности ИИ как поистине универсального решения для множества задач, что на практике оказалось не всегда выполнимо в условиях реального использования. Критика со стороны специалистов и СМИ подтолкнула компании к более сдержанной и обоснованной коммуникации, чтобы не вводить пользователей в заблуждение о реальных преимуществах и ограничениях технологий. Параллельно с этим регуляторные органы разных стран начали активнее вмешиваться в деятельность технологических компаний, требуя большей ответственности и прозрачности в том, как создаются и представляются ИИ-продукты. В некоторых случаях были введены стандарты оценки безопасности и этичности искусственного интеллекта, а также обязательные проверки точности заявлений и рекламных материалов.

Это вынудило компании пересмотреть формулировки своих рекламных сообщений, уделить больше внимания возможным рискам и ограничениям, которые связаны с использованием ИИ. Кроме того, общественное давление играет не менее важную роль в процессе корректировки заявлений. Пользователи становятся все более информированными и требовательными к качеству и честности информации, связанной с ИИ-технологиями. Социальные сети и профильные форумы стали местом активной дискуссии, обмена опытом и критики, что влияет на репутацию компаний и их продуктов. В результате, многие технологические гиганты начали внедрять механизмы обратной связи, а также публиковать более подробные отчеты и данные о работе своих ИИ-систем, чтобы повысить доверие аудитории и продемонстрировать социальную ответственность.

Другим важным аспектом пересмотра рекламных заявлений стала техническая сложность и непрозрачность работы многих моделей ИИ, особенно тех, которые основаны на глубоких нейронных сетях. Несмотря на их высокую эффективность в решении определенных задач, отсутствие возможности полного объяснения процесса принятия решений затрудняет объективную оценку результатов и уровней риска. Это создает вызовы как для разработчиков, так и для пользователей и регуляторов. Следствием такого положения стало более осторожное описание возможностей ИИ-продуктов, где подчеркивается важность человеческого контроля и дополняется информация о возможных ошибках и ограничениях систем. Несмотря на все сложности и вызовы, корректировка заявлений не означает снижение инновационной активности.

Наоборот, откровенный диалог между компаниями, регуляторами и общественностью способствует формированию более зрелого рынка ИИ, где прозрачность и ответственность становятся основными принципами. Это не только укрепляет доверие пользователей и партнеров, но и стимулирует дальнейшие исследования и разработки, направленные на создание более надежных и эффективных решений. Одной из тенденций, наблюдаемых в ходе адаптации коммуникации технологических компаний, является переход от «гиперболизированных» обещаний к более сбалансированным и четко аргументированным сообщениям. Основное внимание теперь уделяется практической пользе ИИ, его интеграции в реальные бизнес-процессы и решениям конкретных задач, а не общим заявлениям о революционном характере технологии. Такой подход помогает избежать завышенных ожиданий и снижает риск разочарования пользователей.

В этом контексте важным становится и вопрос регулирования трансграничного характера ИИ-продуктов. Поскольку технологии активно распространяются по всему миру, компании обязаны учитывать различные национальные стандарты и правила, что требует гибкости и адаптации стратегий коммуникации для разных рынков. Это дополнительно стимулирует разработку универсальных принципов и стандартов взаимодействия с аудиторией. Теперь невозможно игнорировать факт того, что искусственный интеллект — это не просто технологический тренд, а сложный социально-технический феномен, который влияет на множество аспектов жизни. Именно поэтому крупные технологические компании находятся под пристальным вниманием, и их ответственность в коммуникации играет ключевую роль в формировании будущего индустрии.

Рассматривая ранее возникшие прецеденты, становится ясно, что попытки переоценить возможности ИИ часто приводят к падению доверия и негативному резонансу в обществе. Поэтому научно обоснованный подход к маркетингу и публичным заявлениям не только снижает риски, но и способствует укреплению долгосрочных отношений с клиентами и партнерами. Среди инициатив, которые способствуют этой тенденции, можно отметить привлечение независимых экспертов, публикацию открытых данных и участие в открытых дискуссиях по этике и безопасности ИИ. В заключение стоит отметить, что пересмотр заявлений о продуктах на базе искусственного интеллекта отражает общий процесс эволюции технологического сектора. От первоначального энтузиазма и амбициозных обещаний индустрия движется в сторону взвешенного и ответственного внедрения инноваций.

Это создает благоприятную среду для устойчивого развития ИИ, где технологии приносят реальную пользу и поддерживаются доверие и понимание со стороны общества. Будущее искусственного интеллекта зависит от того, насколько честно и прозрачно компании смогут выстраивать диалог со своими пользователями, регуляторами и партнерами, учитывая все вызовы и возможности новой эпохи.