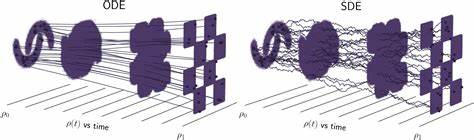

Распознавание и синтез речи уже давно перестали быть фантастикой — эти технологии прошли значительный путь развития, проникнув в повседневную жизнь пользователей через голосовые помощники, автоматические системы обслуживания и устройства умного дома. Одной из самых перспективных техник, кардинально меняющих подход к обработке речи, является Delayed Streams Modeling (DSM). Эта инновация заложена в основе моделей Kyutai для Speech-To-Text (STT) и Text-To-Speech (TTS), нацеленных на эффективность, точность и комфорт использования в реальном времени. Delayed Streams Modeling представляет собой концептуальный прорыв в обработке потоковых данных с задержкой, которая оптимизирует баланс между скоростью и качеством обработки. Традиционные системы либо жертвовали скоростью ради точности, либо отдавали предпочтение скорости в ущерб качеству.

DSM позволяет моделям работать с аудио и текстом, анализируя поток с учетом небольшой задержки, что даёт время для более глубокого понимания контекста и точного распознавания или синтеза. Kyutai STT — именно тот тип моделей, в котором реализована технология Delayed Streams Modeling для решения задач преобразования речи в текст с минимальными задержками. Эти модели отлично подходят для приложений, требующих высокой скорости отклика и качества одновременно – например, для голосовых ассистентов, онлайн-транскрипции и интерактивных систем. Одной из ключевых особенностей Kyutai STT является возможность потокового распознавания со сжатой задержкой, что обеспечивается благодаря продвинутому архитектурному решению. Модель обрабатывает аудио по частям, позволяя не дожидаться окончания фразы, но при этом сохраняет точность в выделении слов и фраз.

Важным достоинством является выдача word-level timestamps — то есть, временных меток для каждого слова, что удобно для последующей обработки, аннотирования и синхронизации. Разработка двух моделей Kyutai STT — kyutai/stt-1b-en_fr и kyutai/stt-2.6b-en — подчеркивает универсальность и масштабируемость подхода. Первая модель поддерживает английский и французский языки и характеризуется задержкой всего в полсекунды, к тому же она включает семантический Voice Activity Detection (VAD), который определяет, когда пользователь начинает и заканчивает говорить. Такая способность существенно повышает качество взаимодействия голосовых агентов с людьми.

Вторая модель ориентирована на английский язык с большей глубиной и размером параметров, что позволяет достигать еще более высокого качества распознавания при увеличенной задержке. Кроме того, Kyutai STT оптимизирована для масштабируемого использования в производстве. Сервер на Rust предлагает высокую стабильность и возможность обработки множества одновременных потоков благодаря эффективному использованию ресурсов GPU. Например, на современном GPU типа L40S можно обрабатывать десятки аудиопотоков одновременно с ускорением в несколько раз, что критично для коммерческих продуктов и сервисов с крупной аудиторией. Для исследователей и разработчиков открыты версии моделей на PyTorch, предоставляющие гибкость для экспериментов с архитектурой и параметрами.

Для пользователей Apple техника предложен вариант на базе MLX, что позволяет значительно повысить производительность на устройствах с чипами Apple Silicon без необходимости в дополнительных внешних вычислительных мощностях. В мире синтеза речи Kyutai TTS демонстрирует аналогичные преимущества, применяя DSM для создания реалистичного и естественного звучания с сохранением способности работать в режиме реального времени. Это особенно востребовано в сценариях озвучки диалоговых систем, интерактивных медиа и приложений для людей с ограниченными возможностями. Так же, как и модели STT, решения TTS предусматривают разные платформы и способы интеграции — PyTorch для прототипирования, Rust для высокой производительности и MLX для мобильных устройств Apple. Такая диверсификация позволяет гибко использовать технологию в самых разных условиях от исследовательских лабораторий до массовых коммерческих продуктов.

Одним из знаковых проектов, построенных на основе технологий Kyutai STT и TTS, является Unmute — голосовая AI-система, демонстрирующая эффективность delayed streams modeling в реальных условиях. Unmute позволяет интерактивно общаться с устройствами без задержек, обеспечивая естественное восприятие речи и быструю отдачу результата. Важным аспектом является открытость разработок — весомая часть кода и моделей распространяется под популярными и либеральными лицензиями MIT и Apache, а модели STT доступны под лицензией CC-BY 4.0. Такая политика способствует развитию сообщества и внедрению передовых технологий в различные направления.

Для тех, кто заинтересован в изучении, применении или развитии Kyutai STT и TTS, предусмотрены подробные инструкции по установке, работе и интеграции, а также поддержка в виде FAQ и активного сообщества разработчиков. Установка предкоммит-хуков и возможность запуска сервисов как standalone приложений облегчают адаптацию моделей под индивидуальные потребности. Delayed Streams Modeling в принципе открывает новые горизонты для систем с потоковой обработкой речи и текста, сочетая скорость реакции с глубиной анализа благодаря искусственной задержке. Модели Kyutai дают понять, что потоковое обучение и инференс с задержкой — не просто теоретическая концепция, а практический инструмент создания высококачественных речевых интерфейсов будущего. В ближайшие годы ожидается дальнейшее развитие DSM, расширение языковой поддержки, улучшение качества и адаптация под новые аппаратные платформы.

Kyutai STT и TTS, базирующиеся на этой технологии, предоставляют прочную основу для разработки голосовых систем нового поколения, которые смогут обеспечить беспрецедентный уровень взаимодействия человека с машиной. Современная эпоха, в которой голос становится полноценным интерфейсом для работы с компьютером, требует от технологий не просто распознавания и генерации речи, а умения эффективно работать с информацией в потоковом режиме. Задержанная потоковая модель — ответ на этот вызов, и Kyutai, используя Delayed Streams Modeling, находится в авангарде таких инноваций. Профессионалы и энтузиасты, заинтересованные в передовых решениях для речевых технологий, неизбежно обратят внимание на современные достижения Kyutai в области STT и TTS как пример успешной интеграции научных идей с реальными потребностями рынка.