В эпоху стремительного развития искусственного интеллекта большие языковые модели (LLM) стали одним из ключевых направлений исследований и коммерческих применений. Они глубоко преобразуют подходы к обработке естественного языка, способствуя созданию новых решений в чатботах, системах поддержки принятия решений и интеллектуальных помощниках. Однако масштаб и сложность этих моделей вызывают потребность в удобном, актуальном и структурированном подборе материалов, инструментов, данных и фреймворков для их создания, обучения и внедрения. Одним из таких ценных ресурсов, получивших широкое признание в сообществе исследователей и разработчиков, является репозиторий Awesome-LLM — тщательно кураторский список, объединяющий самые важные источники и проекты в области больших языковых моделей. Awesome-LLM — это открытый репозиторий на GitHub, который содержит не просто ссылки на научные статьи, а обширный, регулярно обновляемый набор разнообразных материалов.

Он объединяет ключевые исследования, форки популярных моделей, инструменты для обучения и оптимизации, доступные API и контрольные точки моделей, руководства и курсы, а также самые популярные приложения и программные библиотеки. Такой центральный хаб становится незаменимым помощником для тех, кто хочет оставаться на передовой ИИ развития, не тратя время на поиск и отбор информации в миллионных потоках данных. Важной особенностью данного списка является наличие разделов с особенностями и новинками. Например, в категории «Трендовые LLM проекты» представлены проекты с открытым исходным кодом, которые стремятся воспроизвести сложные модели типа GPT-4 или реализовать масштабируемые модели со специализированными архитектурами. TinyZero и open-r1 посвящены минималистичной реализации систем глубокого обучения с акцентом на простоту и доступность, что особенно важно для тех, кто хочет экспериментировать с архитектурами на своей аппаратуре.

DeepSeek-R1 и DeepSeek-V3 — это попытки создать открытые аналоги сложных моделей, которые могут конкурировать с закрытыми решениями в смысле многоходового осмысленного вывода. Платформы типа Qwen2.5-Max и Kimi-K2 акцентируют внимание на использовании технологии Mixture of Experts (MoE), которая позволяет масштабировать модели на триллионы параметров, обеспечивая экономию ресурсов без потери качества. Для исследователей полезной станет большая подборка фундаментальных и последних научных публикаций, посвященных теории и практике LLM. В разделе «Эталонные статьи» можно найти ключевые работы, формировавшие современное понимание трансформеров, самообучения и методов дообучения на инструкциях, что позволило моделям обрести способности к решению разнообразных задач.

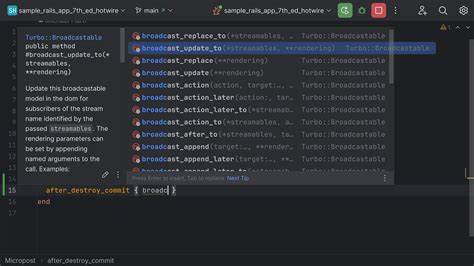

Возможность сравнения моделей предоставляется через специально созданные лидерборды, такие как Chatbot Arena Leaderboard или Open LLM Leaderboard, где в режиме реального времени обновляются рейтинги на основе производительности языковых моделей и систем диалогов. Такие платформы строятся на анонимных и случайных состязаниях, чтобы обеспечить объективную и прозрачную оценку. Для разработчиков и инженеров важны инструменты и библиотеки для эффективного обучения и вывода моделей. Awesome-LLM предлагает множество фреймворков, от минималистичных и легковесных до масштабируемых решений ведущих корпораций. DeepSpeed, Megatron-LM и торчетитан — среди тех, которые позволяют оптимизировать распределенное обучение, с помощью параллелизации и эффективного управления памятью.

В части инференса и развертывания представлены современные решения, включая vLLM, llama.cpp, SGLang и TensorRT-LLM, обеспечивающие быструю, экономную по ресурсам работу моделей на различных платформах и устройствам. Большое место в списке занимает также раздел с приложениями и инструментами для конструирования высокоуровневых приложений с использованием LLM. Это библиотеки, такие как LangChain и LlamaIndex, позволяющие создавать цепочки вызовов моделей и интегрировать дополнительные источники данных, существенно расширяя функциональность и точность результатов. Не менее полезными являются учебные материалы, курсы и книги, аккумулированные в списке.

Пользователи могут пройти от начальных курсов с простыми объяснениями архитектур до продвинутых семинаров по адаптации и отладке моделей, что позволяет углубить понимание и повысить техническую компетенцию. Помимо технической информации, в Awesome-LLM найдется ряд аналитических статей и мыслей ведущих экспертов, посвященных текущим трендам, вызовам и перспективам развития крупных языковых моделей. Это содействует формированию целостного взгляда на индустрию и помогает в стратегическом планировании исследований и внедрений. Изучение и использование такого централизованного, структурированного и постоянно обновляемого ресурса может оказаться ключевым фактором успеха в быстро меняющемся мире больших языковых моделей. Он позволяет не только получить доступ к самым качественным данным и технологиям, но и поддерживает соединение с сообществом, которое создает и развивает искусственный интеллект нового поколения.

В итоге, Awesome-LLM — это не просто список ссылок, а полноценная экосистема знаний и инструментов по крупномасштабным языковым моделям, объединяющая актуальную информацию о последних достижениях, практиках и доступных ресурсах. Для тех, кто занимается разработкой, исследованием или просто интересуется современными языковыми моделями, это незаменимый ресурс, способный максимально упростить процесс поиска и освоения материалов, способствуя развитию и внедрению инновационных технологий в самых разных сферах.