Современные большие языковые модели (LLM) кардинально меняют способы взаимодействия человека с информационными технологиями. Они все активнее внедряются в сферы, связанные с обслуживанием клиентов, автоматизацией бизнеса и созданием интеллектуальных ассистентов. Однако ключевой проблемой остается ограниченность контекста: большая языковая модель не способна сохранять и использовать знания из предыдущих сессий диалога, что снижает качество и глубину взаимодействия. Новое решение — объектная база данных, работающая поверх MCP-сервера, призвано устранить эти ограничения и создать персистентную память между чатами, значительно расширяя возможности LLM. Обсудим, что собой представляет это новшество и как оно может повлиять на будущее искусственного интеллекта.

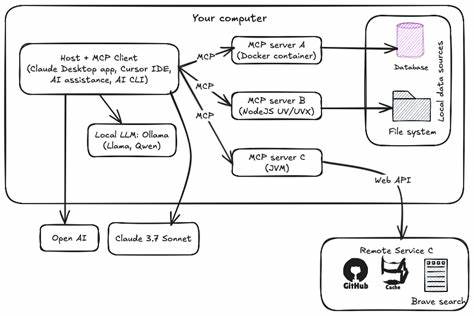

Объектная база данных для LLM — это специально разработанная система, которая способна хранить структурированную информацию, полученную во время взаимодействия с пользователем, и делать её доступной в последующих сессиях. В отличие от традиционных баз данных, которые ориентированы на таблицы и строгое структурирование, объектные базы позволяют более гибко работать с данными в формате, близком языковым моделям. Это упрощает связь между моделями и хранимой информацией, помогает эффективно организовать знания и применить их при генерации ответа. Основой такой технологии стал MCP-сервер — механизм, обеспечивающий управление объектной базой и связь с LLM. MCP-сервер выполняет роль централизованного хранилища и обработчика запросов, поддерживая коммуникацию между пользователем и языковой моделью, а также обеспечивает постоянство данных.

Именно за счет MCP-сервера LLM получает возможность «помнить» контекст из предыдущих чатов, а не ограничиваться заданным линейным контекстным окном. Преимущества применения объектной базы данных с поддержкой MCP-сервера очевидны: создание длинных, сложных диалогов с учетом предыдущей истории, персонализация ответов на основе накопленной информации, улучшение качества и релевантности взаимодействия, а также повышение производительности за счет снятия нагрузки на повторный анализ уже известных данных. Такие возможности особенно востребованы в сегментах знаний с большой глубиной, например, в технической поддержке, юридических консультациях и образовании. Более того, благодаря персистентности данных, компании могут создавать долгосрочные профили клиентов, что значительно расширяет инструментарий для маркетинга и улучшения клиентского опыта. Технология MCP-сервера и объектной базы данных также открывает двери для новых подходов в обучении и дообучении языковых моделей.

Вместо того чтобы «запоминать» информацию только в процессе обучения, моделям становится доступен динамический доступ к обновляемым данным, что позволяет актуализировать знания практически в реальном времени. Это существенно сокращает время между получением новых данных и их использованием в ходе диалога. Однако стоить отметить сложность реализации такой системы. Прежде всего, это вопросы архитектуры — необходимо гарантировать синхронизацию данных между LLM и объектной базой, избежать потерь и ошибок в момент сохранения и извлечения информации. Также важен аспект безопасности, ведь хранение персональных данных требует надлежащей защиты и соответствия международным стандартам конфиденциальности.

Нельзя забывать и о производительности — для успешного практического применения MCP-сервер должен работать с минимальными задержками, не ухудшая впечатление от общения с моделью. В данный момент технология находится на стадии активного развития, в альфа-версии можно наблюдать основные функциональные возможности и потенциал. В будущем появятся более эффективные механизмы интеграции, расширится поддержка различных сценариев использования, а также станут доступны инструменты для адаптации под конкретные бизнес-потребности. Объектная база данных для LLM с поддержкой MCP-сервера — это значительный шаг в развитии искусственного интеллекта и обработки естественного языка. Она решает проблему кратковременной памяти моделей, обеспечивая устойчивое хранение и применение информации между сессиями.

Это означает, что взаимодействие с ИИ становится более осмысленным, контекстным и персонализированным. Технология обещает занять важное место в архитектуре будущих чат-ботов, виртуальных помощников и интеллектуальных систем. В итоге, потенциал объектов «памяти» для LLM поможет вывести на новый уровень качество услуг, основанных на искусственном интеллекте, и откроет новую эпоху эффективной коммуникации человека и машины.

![Surveillance Price Gouging (2024) [pdf]](/images/6E760533-93D2-482F-9292-101A902CB874)