Современный мир все глубже погружается в цифровую реальность, и вместе с этим развиваются и методы кибератак, становясь все более изощренными и опасными. Одним из новых и быстро распространяющихся направлений является использование искусственного интеллекта для создания глубоких подделок – deepfakes, а также применения технологий для имитации реальных сотрудников и руководителей компаний. Социальная инженерия в эпоху ИИ переосмыслена и вышла на совершенно новый уровень, при котором механизмы мошенничества становятся более персонализированными, точными и, соответственно, труднораспознаваемыми. И именно эти факторы делают борьбу с подобными атаками крайне актуальной для современных организаций во всем мире. В основе новых методов социальной инженерии лежит возможность с помощью генеративных моделей и глубокого обучения имитировать не только внешность, голос и манеру речи реальных людей, но и создавать поддельные цифровые профили, фальшивые страницы официальных сайтов и даже ложные обращение от имени топ-менеджеров или сотрудников компании.

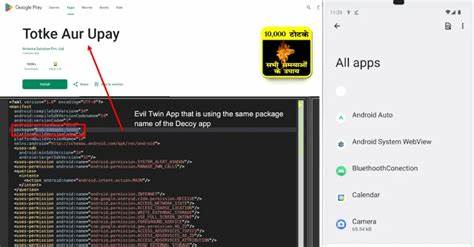

Эта техника получила особое развитие в последние годы и значительно усложняет задачу защиты корпоративных активов и данных. Важным инструментом таких атак становится имитация руководителей – например, клон финансового директора, который по телефону или электронным каналам связи требует срочного проведения денежных переводов. Ложные рекрутеры на платформах вроде LinkedIn создают доверие у потенциальных жертв, собирая таким образом конфиденциальную информацию о сотрудниках и доступах к корпоративным ресурсам. Всё это создает среду, в которой традиционные методы борьбы с фишингом и социальным инжинирингом становятся менее эффективными. Изменился и подход злоумышленников к проведению атак: теперь это не разовые попытки получить выгоду, а целенаправленные, масштабные кампании, охватывающие сразу несколько коммуникационных каналов – электронную почту, мессенджеры, социальные сети и специализированные порталы поддержки клиентов и сотрудников.

При этом каждый этап обычно тщательно продуман и адаптирован под конкретного человека или организацию. Такие специализированные атаки трудно выявить без использования продвинутых средств анализа и выявления поведения. Важным аспектом эффективной защиты становится реализация решений на базе искусственного интеллекта, которые позволяют вести мониторинг и анализ вероятных угроз в реальном времени. Современные платформы, например, позволяют обнаруживать не только подозрительные сигналы на уровне сообщений и страниц, но и анализировать поведение злоумышленников, проводить расследование и блокировать атаки до того, как они могут нанести репутационный или финансовый ущерб. Помимо технических средств, крайне важна культура безопасности и обучение сотрудников новым реалиям угроз.

Традиционные тренинги, основанные на распознавании фишинговых сообщений, нуждаются в обновлении, поскольку киберпреступники все чаще используют более тонкие приёмы, которые не всегда видны даже опытным специалистам. Внедрение современных методик безопасности, которые учитывают мультиканальный характер атак и их автоматизацию, становится залогом успешной защиты. Уникальность подхода с использованием ИИ в безопасности заключается в способности обучаться на данных обо всех выявленных попытках мошенничества, что позволяет значительно расширять базу знаний и предотвращать новые виды атак. Такой метод превращает защиту из реактивной в проактивную, позволяя не просто распознавать известные способы злоупотреблений, но и предугадывать поведение злоумышленников. Лидеры безопасности, сотрудники центров реагирования на инциденты (SOC), специалисты по управлению рисками и борьбе с мошенничеством находят в таких интеллектуальных системах незаменимого помощника в ежедневной работе.