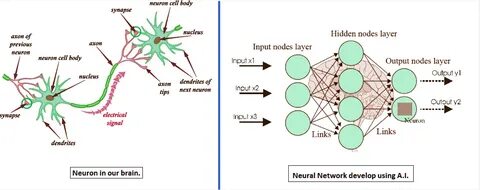

В мире искусственного интеллекта и глубокого обучения постоянно появляются новые архитектуры, способные решать сложные задачи с большей эффективностью и точностью. Одним из таких инновационных подходов является uGMM-NN — нейронная сеть с использованием унивариантных гауссовых смесей, представляющая собой синтез традиционных методов глубокого обучения и вероятностного моделирования. Эта статья раскрывает суть технологии и потенциал uGMM-NN, а также показывает, почему такой подход может стать прорывом в области машинного обучения. Традиционные нейронные сети основываются на принципе взвешенного суммирования входных сигналов с последующим применением активационной функции. Такой подход хорошо зарекомендовал себя в задачах классификации, регрессии и других.

Однако он обладает определенными ограничениями: например, неспособностью полноценно моделировать неопределенность и сложные распределения входных данных. Это сокращает возможности нейросетей при работе с шумными данными и в сценариях, требующих учета вероятностных зависимостей. В отличие от стандартных нейронов, в uGMM-NN каждый нейрон представляет собой унивариантную гауссову смесь. Такая модель описывает входные данные вероятностно, используя набор параметров — средние, дисперсии и веса смешивания, которые обучаются в процессе оптимизации. Каждый нейрон принимает на вход набор значений, и для каждого входа имеется отдельный гауссовский компонент смеси.

Таким образом, нейрон способен моделировать многомодальность входных данных и учитывать их неопределенность, что значительно расширяет возможности сети. Концепция унивариантной гауссовой смеси строится на идее разложения сложного распределения данных на комбинацию более простых гауссовых распределений. Это позволяет описывать даже сложные вероятностные структуры, которые традиционные нейроны проглатывают или сглаживают. В uGMM-NN такая архитектура реализуется посредством последовательного наложения слоев с uGMM-нейронами, что создает иерархическую модель распределения с возможностью многократных трансформаций и обогащения признаков. Преимущества использования uGMM-нейронов очевидны.

Во-первых, они обеспечивают более информативное представление данных, что способствует улучшению обобщающей способности модели. Во-вторых, благодаря вероятностной природе нейронов, сеть способна более корректно интерпретировать область неопределенности, что критично в задачах диагностики, прогнозирования и принятия решений в реальном времени. В-третьих, архитектура uGMM-NN гибка и может быть интегрирована в существующие фреймворки глубокого обучения с использованием популярных библиотек, таких как PyTorch. Практическая реализация uGMM-NN существенно напоминает классические полносвязные нейронные сети, что облегчает обучение и внедрение. Входной слой организован из переменных-узлов, соответствующих характеристикам исходных данных, например, пикселям изображений.

Каждый последующий слой состоит из набора uGMM-нейронов, обладающих собственными параметрами гауссовой смеси. Такие слои объединяются последовательно, образуя глубокую структуру, способную распознавать сложные паттерны в данных. Для тестирования и применения модели часто используют известные датасеты. Так, например, в задаче классификации рукописных цифр MNIST входные данные представлены изображениями размером 28 на 28 пикселей. uGMM-NN строится с использованием соответствующего числа переменных-узлов, а внутренние слои содержат сотни uGMM-нейронов, что обеспечивает высокую выразительность модели.

Обучение производится с применением стандартных методов оптимизации, таких как Adam, и распространенных функций потерь, например, кросс-энтропии для задач классификации. Важным моментом является то, что в отличие от классических нейронных слоев, где каждый нейрон фиксирует свое поведение с помощью веса и смещения, uGMM-нейроны обучаются через оптимизацию параметров смеси — средних, дисперсий и коэффициентов смешивания. Это позволяет нейрону принимать решения, основанные на вероятностных оценках, что позитивно влияет на устойчивость модели к шуму и сложным распределениям данных. Помимо предпосылок к улучшению классификации, архитектура uGMM-NN открывает новые горизонты для генеративного моделирования. На примере датасета Ирисов можно создать сеть, которая научится не только классифицировать, но и генерировать данные, максимально приближенные к исходным.

Точность в таких задачах достигается за счет минимизации негативного логарифма правдоподобия, что позволяет сети адекватно оценить вероятность каждой точки в многомерном пространстве признаков. В академической и исследовательской среде uGMM-NN вызывает особый интерес благодаря своей способности объединять глубокое обучение и вероятностное моделирование — области, которые традиционно развивались независимо друг от друга. Такой синтез способствует разработке новых, более прозрачных и интерпретируемых моделей, где каждая компонента несет осмысленную статистическую нагрузку. Это важно для создания «белых ящиков» в машинном обучении, способных объяснять свои решения, что привлекает внимание специалистов в таких сферах, как медицина, финансы и автономные системы. Внедрение uGMM-NN не обходится без трудностей.

Обучение параметров смеси требует аккуратного выбора начальных значений и контроля за сходимостью. Кроме того, архитектура обладает повышенной вычислительной сложностью по сравнению с классическими нейронами, так как необходимо учитывать отдельные параметры для каждого компонента смеси. Тем не менее, усилия оправданы получаемыми преимуществами и возможностями сети. Источником вдохновения для создания uGMM-NN послужили классические статистические методы, которые на практике доказали свою эффективность в задачах кластеризации и плотностного моделирования. Совмещение их с мощью современных НС позволяет добиться модели, адаптирующейся к сложным данным и обрабатывающей информацию с повышенной точностью.

Сегодня проект имеет открытый исходный код на GitHub и поддерживается сообществом разработчиков, что облегчает его изучение, модификацию и применение в различных областях. Пример кода для построения и обучения сети на базе PyTorch упрощает интеграцию и способствует более широкому распространению концепции. Перспективы развития uGMM-NN весьма многообещающие. Исследователи могут расширять архитектуру за счет более сложных вероятностных компонентов, интегрировать ее с моделями для обработки последовательностей и графов, а также разрабатывать эффективные алгоритмы обучения и регуляризации. Это позволит применять методику в здравоохранении для диагностики заболеваний, в робототехнике — для обработки сенсорных данных, а также в финансовой сфере — для прогнозирования рыночных тенденций с учетом рисков.

В результате Univariate Gaussian Mixture Model Neural Network демонстрирует, как сочетание классических вероятностных методов и современных глубоких моделей может привести к созданию мощного инструмента машинного обучения с широкими возможностями. Это открывает путь к более устойчивым, информативным и универсальным системам, способным адаптироваться к вызовам реального мира, сохраняя высокую точность и качество решений.