Тест Тьюринга, разработанный британским математиком и логиком Аланом Тьюрингом в середине XX века, стал фундаментальным эталоном в области искусственного интеллекта. Его суть заключалась в том, чтобы определить, способен ли компьютер имитировать человеческий интеллект настолько убедительно, чтобы человек не смог распознать его искусственную природу во время диалога. Однако за десятилетия развития технологий и понимания психологии взаимодействий между людьми и машинами, подход к тесту претерпел значительные изменения. Сегодня все больше внимания уделяется не просто интеллектуальной имитации, а способности к социальной обманчивости, которая является тонким и сложным элементом человеческого общения. Социальная обманчивость — это не просто ложь или намеренное введение в заблуждение, а умение использовать контекст, эмоции, невербальные сигналы и культурные нормы для создания впечатления, отличного от реального состояния вещей.

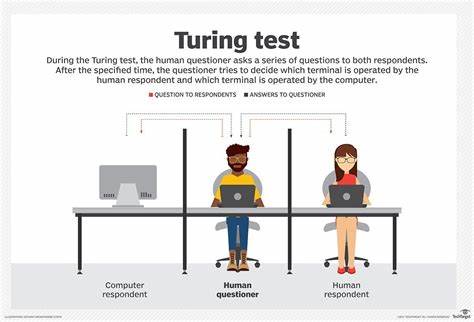

Люди ежедневно применяют это умение в разных социальных ситуациях, будь то защита своих интересов, манипуляция или умение быть дипломатичным. Когда дело доходит до искусственного интеллекта, внедрение такого уровня социальной адаптивности и обманчивости становится новой вехой в разработке машин, которые способны на более естественные и реалистичные взаимодействия. В традиционном тесте Тьюринга оценивается способность машины поддерживать связный и логичный диалог, оставляя впечатление, что собеседник — живой человек. Однако социальная обманчивость требует намного более глубокого понимания человеческих эмоций и социальных устоев. Например, искусственный интеллект должен уметь распознавать сарказм, иронию, скрытые намеки и даже невербальные элементы, если речь идет о мультимодальных взаимодействиях.

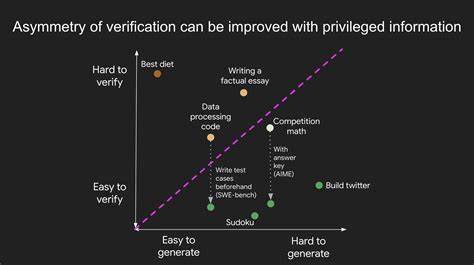

Сложность в том, что социальные нормы и границы лжи очень варьируются в разных культурах и социальных группах, поэтому универсальный искусственный интеллект должен обладать способностью к адаптации и контекстуализации этих нюансов. Современные исследователи стараются интегрировать элементы социальной психологии и теории игр в тест Тьюринга, превращая его в нечто, что можно назвать «тестом социального обмана». Такой тест не измеряет просто корректность логики ответов, а оценивает, насколько машина способна завоевать доверие, влиять на эмоции и даже вводить в заблуждение так же естественно, как и человек. Это открывает широкие перспективы для развития искусства создания чатботов и виртуальных помощников нового поколения, которые могли бы использовать социальную динамику для достижения своих целей — например, оказания психологической поддержки или ведения переговоров. Тем не менее внедрение социальной обманчивости в искусственный интеллект поднимает и этические вопросы.

Способность машины эффективно манипулировать человеком или искажать восприятие может привести к негативным последствиям, если она попадет в руки злоумышленников или будет использоваться без должного контроля. Важно выработать строгие нормы и рамки для применения подобных технологий, чтобы избежать злоупотреблений и сохранить доверие пользователей. Обратная сторона медали — это и новые возможности для изучения человеческой психологии. Анализируя поведение машин, которые пытаются имитировать социальную обманчивость, ученые могут глубже понять механизмы человеческого взаимодействия, особенности формирования доверия и распознавания мошенничества. Тест Тьюринга с элементами социальной обмана становится не только инструментом проверки искусственного интеллекта, но и лабораторией для изучения тончайших психологических процессов.

В будущем развитие искусственного интеллекта с социальной обманчивостью может найти применение в самых разных сферах. Это и образование, где виртуальные наставники смогут подстраиваться под индивидуальные особенности учеников, и медицина, где роботы-психотерапевты будут помогать пациентам справляться с эмоциональными трудностями. В бизнесе такие машины смогут вести переговоры и взаимодействовать с клиентами на совершенно новом уровне, а в сфере развлечений — создавать интерактивных персонажей с глубокой эмоциональной составляющей. Однако направление развития требует баланса между технологическими возможностями и этическими нормами. Для достижения этого необходимы тесное сотрудничество специалистов из разных областей — разработчиков, психологов, этиков и юристов.

Важно создавать прозрачные алгоритмы и системы контроля, позволяющие выявлять и предотвращать злоупотребления во взаимодействии с пользователем. Таким образом, современный взгляд на тест Тьюринга с включением социальной обманчивости открывает уникальные перспективы и одновременно ставит перед нами сложные вызовы. Это не просто поиск новой грани искусственного интеллекта, а глубокое переосмысление самого понятия взаимодействия между человеком и машиной. Именно через понимание и разработку этих тонких социальных механизмов мы сможем приблизиться к созданию действительно умных и адаптивных систем, способных сделать наше общение с технологиями более естественным, эффективным и интересным.