В современном цифровом мире вопросы конфиденциальности и безопасности личных данных становятся всё более актуальными. Пользователи искусственного интеллекта, таких как ChatGPT от OpenAI, привыкли к тому, что их переписки являются приватными, но недавняя ситуация заставила многих пересмотреть это представление. Новость о том, что личные чаты пользователей ChatGPT оказались индексированы и доступны в результатах поисковой системы Google, вызвала настоящий шок и бурную реакцию в интернет-сообществе. Как такое могло произойти? Какие данные были раскрыты? И что теперь делать каждому пользователю? Попробуем разобраться во всех деталях и объяснить, к чему стоит быть готовым в будущем, если вы активно пользуетесь чат-ботами и похожими AI-сервисами. Первые сообщения о проблеме появились после расследования Fast Company, которое выявило тысячи переписок пользователей ChatGPT в результатах поиска Google.

Хотя сами данные не содержали информации, прямо идентифицирующей пользователей, часть текстов включала очень личные детали — описания отношений с близкими, обсуждения интимных тем и даже сведения о ментальном здоровье. Это делало вполне реальной возможность отследить автора переписки по контексту. Представьте, что ваши приватные разговоры о семейных конфликтах, переживаниях или даже медицинских вопросах окажутся доступными любому, кто введет в поисковик несколько уникальных фраз из вашей переписки. Как такое стало возможным? Всё связано с функцией «Поделиться» в интерфейсе ChatGPT. Пользователи, желая сохранить интересный диалог или отправить его друзьям, могли нажать кнопку «Поделиться» и получить ссылки на свои беседы.

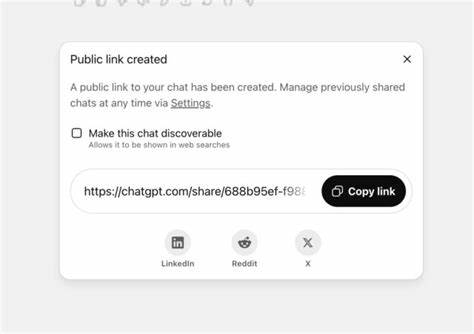

При этом в самом интерфейсе появлялась опция «Сделать этот чат доступным для поиска», рядом с которой была мелким шрифтом указана информация о том, что при выборе пользователем, его диалог может попасть в индексацию поисковых систем. По мнению специалистов и самих пользователей, формат и расположение этой информации были недостаточно ясными. Многие, не уделив должного внимания тонкому тексту, ставили галочку, думая лишь о простом распространении интересного контента. Это создавало ситуацию, когда большое количество переписок, часто содержащих личные и чувствительные данные, становились доступными для широкой аудитории через поиск в интернете. OpenAI признал проблему и сообщил, что функция была экспериментальной и короткосрочной.

После волны критики компания оперативно удалила возможность индексирования и начала процесс блокировки уже обнаруженных форматов ссылок в поисковых системах. Тем не менее удаление информации из индекса — процесс не мгновенный и отличается в зависимости от поисковой платформы. Первым дела занимается Google через собственные инструменты удаления страниц из результатов поиска, но другие поисковики могут сохранять данные дольше. Важным замечанием со стороны OpenAI стало то, что все пользователи, чьи чаты были проиндексированы, якобы сами дали согласие на это, ставя галочку в момент публикации своего диалога. Однако критики указывают, что разъяснения были поданы слишком непрозрачно, и пользователи не до конца осознавали масштабы возможного раскрытия.

Кроме того, подобное «согласие» вызывает этические вопросы в отношении получения информированного согласия в цифровой среде. AI-этики отмечают, что такая практика является тревожным знаком, так как компании часто действуют в роли «экспериментаторов», внедряя функции сначала среди пользователей, а потом решая, устраивать ли их или отменять на основании реакции публики. Отдельное беспокойство вызывает не только ситуация с поисковыми системами, но и судебные процессы, в которых OpenAI участвует. Компания была обязана сохранять все удаленные пользователями переписки в рамках определенного судебного запроса, что нарушает прежние обещания о конфиденциальности и временности хранения данных. Эта ситуация повышает уровень тревоги среди пользователей относительно того, есть ли вообще гарантия, что личные диалоги не будут сохранены и не станут доступны третьим лицам — будь то правоохранительные органы, компания или несанкционированные злоумышленники.

Эксперты-практики советуют пользователям ChatGPT и других AI-сервисов всегда внимательно изучать настройки приватности. Важно не только понимать, когда и как можно делиться результатами диалогов, но и периодически проверять, не стали ли ваши разговоры общедоступными. Бывает полезным ввести часть уникального текста из предполагаемого чата в поисковой системе и посмотреть, не появится ли он в результатах. Если обнаружится утечка, следует незамедлительно обратиться в поддержку компании с требованиями удалить такие данные. Что же дальше? OpenAI заявляет, что принимает эту ситуацию очень серьезно и намерена повысить уровень безопасности и прозрачности своих сервисов.

Одной из главных задач станет более удобное и очевидное информирование пользователей о том, какие данные могут стать публичными, а какие останутся строго приватными. Это также может повлечь доработки пользовательского интерфейса, чтобы минимизировать случаи непреднамеренного раскрытия информации. Параллельно стоит ожидать, что вся технологическая отрасль претерпит усиление регулирования в области AI и защиты данных. Законы о конфиденциальности ужесточаются во всех уголках мира, и компании, работающие с большими объемами пользовательской информации, столкнутся с необходимостью строить доверие на основе честности, прозрачности и безопасности. В свою очередь пользователям любых AI-продуктов важно самостоятельно контролировать свои данные, ограничивать объем личной информации, которую они размещают в онлайне, и критически оценивать все возможности сервисов, которым доверяют.

Ситуация с ChatGPT стала уроком для всех нас. Она наглядно показала, что технологии могут не только приносить пользу и комфорт в ежедневную жизнь, но и создавать новые вызовы, связанные с рисками утечки и нарушения конфиденциальности. В мире, где искусственный интеллект все глубже интегрируется в общество, сознательное и осведомленное использование подобных инструментов приобретает первостепенную важность. Бережное отношение к личным данным — не просто требование закона или корпоративных политик, но важнейший элемент современной цифровой культуры и безопасности каждого пользователя.

![Gemini 2.5 Deep Think Model Card [pdf]](/images/5B2B2FA3-3741-4761-8FF2-872704A6A93E)