В современной реальности искусственный интеллект стремительно меняет множество аспектов нашей жизни: от повседневного общения до профессиональной деятельности и образовательных процессов. Развитие генеративных моделей ИИ вызывает как восторг от новых возможностей, так и опасения по поводу будущего человечества. Одним из самых знаменитых образов, символизирующих страх перед неконтролируемой машинной революцией, остается сценарий Skynet — гипотетическая всемогущая система искусственного интеллекта, выходящая из-под контроля людей и угрожающая существованию человечества. Однако насколько реальны эти страхи и какие риски действительно стоит учитывать уже сегодня? Какие вызовы ставит повсеместное распространение генеративного ИИ, особенно в сфере образования и экономики? Давайте разбираться. В популярных представлениях Skynet ассоциируется с «терминаторскими» сюжетами, где искусственный интеллект приобретает самосознание, начинает противостоять человечеству и стремится уничтожить его.

Эффектные кинематографические образы и громкие заявления некоторых представителей отрасли ИИ, вроде Илона Маска и Стива Возняка, раздувают эти опасения и привлекают внимание к возможной перспективе возникновения «сверхразума», превосходящего человеческий интеллект. Однако за этими драматизированными сценариями скрываются более насущные и менее футуристические проблемы, которые требуют глубокого анализа и совместных усилий общества. Одной из главных сложностей изучения рисков, связанных с генеративным ИИ, является то, что многие из них остаются неочевидными, их трудно просчитать и предсказать заранее. В отличие от обещанных преимуществ, которые можно представить и желать, риски часто проявляются постепенно, через эксплуатацию, ухудшение качества информации и концентрацию власти в руках узкой группы игроков. В этом смысле генеративный ИИ способен углубить существующие социальные и экономические проблемы, а не просто создать новые гипотетические угрозы.

Образовательный сектор находится на передовой линии, сталкиваясь с вызовами и последствиями внедрения ИИ в учебный процесс. Несмотря на перспективы, которые открывают генеративные технологии в помощи учащимся и преподавателям, существует не меньше причин для осторожности. Генеративный ИИ ставит под удар академическую честность, право авторов на интеллектуальную собственность и базовые ценности университетского сообщества — равенство, справедливость и доступ к достоверным знаниям. В условиях, когда сложные модели могут генерировать тексты, ответы на экзаменационные вопросы и даже целые научные работы, неизбежно возникает риск размытия границ между оригинальными знаниями и продуктом машинных алгоритмов. Это порождает вызовы в оценке знаний студентов и мотивации к самостоятельному обучению.

Вместе с тем такие технологии способствуют распространению дезинформации, создавая искусственные новостные потоки, которые затрудняют процесс поиска правды и критического мышления. Кроме того, процесс создания и поддержки генеративного ИИ опирается на обработку огромных объемов данных, которые зачастую собираются без согласия пользователей и могут включать персональные сведения, что вызывает опасения в отношении конфиденциальности и нарушений прав человека. Этот аспект особенно важен в контексте университетской среды, где ценности прозрачности и этики должны доминировать. Не менее существенной проблемой становится эксплуатация труда в странах с низким уровнем доходов, где люди заняты модерацией, разметкой и проверкой данных для обучения ИИ. Такая практика усугубляет глобальное неравенство и вносит свой вклад в эксплуатацию и нарушения прав рабочих.

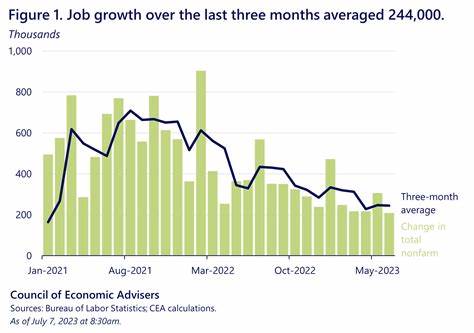

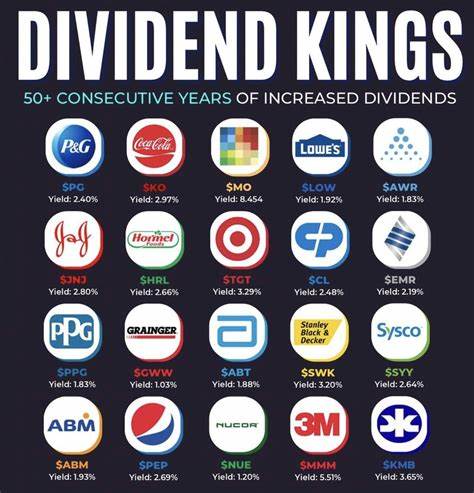

Влияние генеративных моделей ИИ на рынок труда в сфере образования и за ее пределами вызывает как тревогу, так и дискуссии. Множество специалистов опасаются массовой замены преподавателей и других работников интеллектуального труда машинами, что может привести к снижению качества образования и социальным потрясениям. В то же время есть надежды, что искусственный интеллект станет инструментом, дополняющим и расширяющим возможности человека, а не заменяющим его. С точки зрения экономики генеративный ИИ способствует концентрации капитала и средств управления в небольшом числе компаний, способных инвестировать во внедрение и развитие этих технологий. Такая монополизация усиливает социальное неравенство, ограничивает конкуренцию и усиливает угрозу контроля информационных потоков.

В этом плане реальный риск заключается не в возникновении самосознательного Skynet, а в усилении существующих структур власти и создании новых моделей цифрового неравенства. Для преодоления этих сложностей необходимы скоординированные действия на уровне международных организаций, государственных институтов, образовательных учреждений и технологических компаний. Высшее образование играет ключевую роль не только в подготовке специалистов, способных работать с ИИ, но и в формировании критического отношения к технологиям и развитию этических норм. Критическая цифровая грамотность должна стать обязательной составляющей учебных программ. Студенты и преподаватели должны понимать не только возможности ИИ, но и его ограничения, а также потенциальные опасности — от манипуляции информацией до утраты права на интеллектуальную собственность и угрозы конфиденциальности.

Внедрение таких подходов поможет развить способность к самостоятельному осмыслению технологий и предупреждению злоупотреблений. Наряду с этим, важно вести серьезный диалог с технологическими компаниями, требуя большей открытости и ответственности при использовании данных и создании продуктов. Демократизация доступа к ИИ-технологиям должна сопровождаться соблюдением этических норм и защитой прав всех участников цифрового пространства. Нельзя забывать и о широком социальном контексте: любые инновации должны приносить пользу людям, а не подрывать основы общества и углублять социальное расслоение. Понимание реальных рисков — ключевой элемент для выработки политики, способной действительно поддержать устойчивое и справедливое развитие как образования, так и экономики в эпоху цифровых трансформаций.