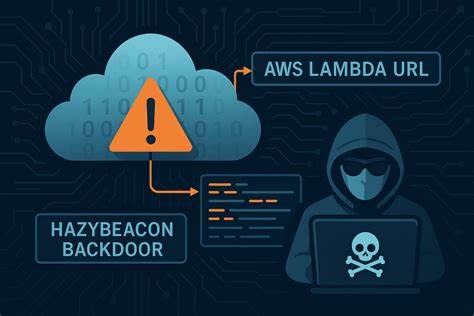

С развитием искусственного интеллекта и автоматизации бизнес-процессов все большую роль начинают играть агентные системы — автономные программы, способные выполнять сложные задачи без вмешательства человека. Такие ИИ-агенты могут автоматически запускать рабочие процессы, делать множество API-вызовов и изменять данные. Однако именно эти возможности открывают новые риски безопасности, связанные с так называемыми невидимыми идентичностями. Речь идет о неявных не-человеческих учетных записях, которые используют API-ключи, OAuth-токены и учетные записи сервисов для доступа к корпоративным ресурсам. В большинстве современных облачных сред количество таких идентичностей уже превышает число человеческих пользователей, что создает огромную заявку для злоумышленников.

Одной из главных проблем является то, что традиционные методы контроля доступа и управления идентичностями изначально были разработаны для людей. Они не способны отслеживать и управлять сложными связями между агентами ИИ, их учетными данными и правами доступа. Более того, в отличие от обычного кода, который работает по детерминированным алгоритмам, большие языковые модели (LLM), лежащие в основе современных ИИ-агентов, функционируют на основе вероятностных моделей. Это означает, что сложно предсказать, как именно и где агент будет использовать предоставленные ему полномочия. Такое непредсказуемое поведение требует кардинально новых принципов безопасности и управления.

Автономность ИИ-агентов существенно увеличивает потенциальный масштаб ущерба в случае компрометации их учетных данных. Один украденный или переизбыточный токен может использоваться для многократных операций без участия человека, что значительно увеличивает радиус поражения. А если учесть, что эти агенты зачастую работают с высокопривилегированными API, риск становится критическим. В современных реалиях безопасность агентного ИИ должна базироваться на концепции, при которой каждый агент рассматривается как полноценный субъект с собственными правами и обязанностями, подобно человеческому пользователю. Это подразумевает назначение ответственного человека или команды, которая отвечает за конфигурацию и управление каждым агентом.

Важно реализовать принцип наименьших привилегий — начинать с минимально необходимых прав и расширять их только тогда, когда агенты доказывают необходимость в дополнительных возможностях. Управление жизненным циклом учетных данных таких агентов должно быть автоматизировано и прозрачным. Своевременное отключение устаревших учетных записей и регулярная ротация секретов позволяют снизить риски компрометации и распространения уязвимостей. Ключевым элементом эффективной стратегии становится непрерывный мониторинг активности ИИ-агентов. Выявление аномалий, например, резкого увеличения вызовов к чувствительным API, позволяет оперативно реагировать и предотвращать потенциальные атаки.

Автоматизация процессов реагирования, включая постановку уведомлений и применение ограничений в режиме реального времени, обеспечивает баланс между безопасностью и оперативностью инновационных процессов. Современные платформы безопасности, разработанные специально для управления агентными системами, предлагают единое окно для обнаружения и управления всеми аспектами использования не-человеческих идентичностей. Они автоматически выявляют все агенты, связывают их с владельцами и правами, ранжируют риски и помогают устранять нарушения без ручного вмешательства. Применение таких решений дает три важнейших преимущества для бизнеса. Во-первых, это значительное снижение рисков благодаря устранению «слепых пятен» в инфраструктуре и предотвращение разрастания разрозненных и чрезмерно привилегированных учетных записей.

Во-вторых, обеспечение соответствия нормативным требованиям становится проще, поскольку все действия фиксируются и могут быть проверены в любой момент. Это упрощает подготовку к аудиту и повышает уровень доверия со стороны партнеров и регуляторов. В-третьих, автоматизация рутинных процессов позволяет сервисным и инженерным командам быстрее внедрять новые функции и поддерживать высокий темп инноваций без ущерба для безопасности. На практике интеграция продвинутых средств управления агентными идентичностями способствует формированию культуры ответственности и прозрачности в рамках длинных жизненных циклов автоматизированных процессов. Ответственность за агента закрепляется за конкретными сотрудниками, а непрерывный контроль обеспечивает раннее выявление отклонений.

Технологически это реализуется через использование современных систем управления доступом, специализированных средств анализа и средств реагирования на инциденты с элементами машинного обучения. Однако при этом важно понимать, что безопасность агентного ИИ — это не только вопрос технологий, но и организационных процессов. Необходимы четкие политики, инструкции и обучение сотрудников, чтобы избежать ошибок при настройке и эксплуатации агентов. Сложность и специфика поведения ИИ подчеркивают необходимость тесного взаимодействия между командами безопасности, разработчиками и бизнес-подразделениями. В результате грамотного применения перечисленных принципов компании могут безопасно раскрыть потенциал агентного ИИ, используя его для революционного улучшения бизнес-процессов и повышения общей эффективности.

Успешное внедрение таких подходов позволяет повысить не только безопасность, но и скорость адаптации к новым условиям рынка, что в современном цифровом мире становится конкурентным преимуществом. В будущем роль агентных систем будет только возрастать, а значит — качество и уровень защиты их «невидимых» идентичностей станут одним из ключевых факторов устойчивости и доверия в киберпространстве. Комплексная стратегия, основанная на объединении автоматизации, ответственного управления и непрерывного мониторинга — это оптимальный путь для решения этой задачи.