Hugging Face Transformers сегодня занимает особое место в мире искусственного интеллекта и машинного обучения, предлагая простой и унифицированный способ работы с тысячами моделей для самых разных задач: от анализа текста до генерации речи и обработки изображений. Эта открытая библиотека, построенная поверх популярных фреймворков, таких как PyTorch и TensorFlow, стала незаменимым инструментом для специалистов, исследователей и разработчиков, стремящихся создавать современные AI-приложения быстро и эффективно. Одной из главных причин популярности Hugging Face является не только широкий набор готовых моделей, но и удобство интеграции, что делает библиотеку доступной как для новичков, так и для профессионалов с большим опытом. Ключевым элементом архитектуры является использование трансформеров — нейронных сетей, которые переопределили подход к обработке последовательностей, прежде всего текста, и сделали возможными прорывные технологии, такие как BERT, GPT и T5. Эти модели способны понимать контекст, генерировать осмысленные тексты и выполнять сложные задачи, начиная от классификации и заканчивая переводом и ответами на вопросы.

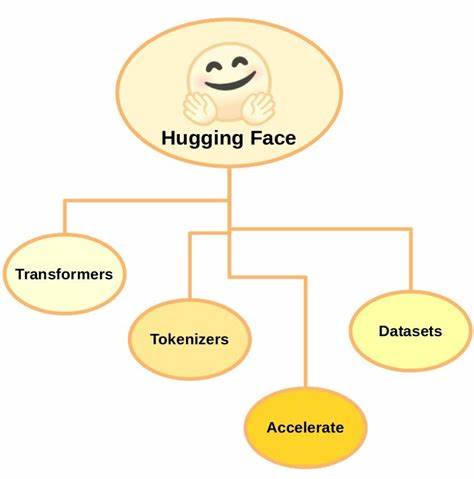

В центре Hugging Face находится возможность быстро загружать предобученные модели из обширного Model Hub — платформы, где сообщество и разработчики делятся своими достижениями. Это значит, что каждый пользователь может выбрать подходящую модель для своей задачи, будь то анализ тональности отзывов, распознавание именованных сущностей или генерация текста на несколько сотен слов. Одной из неоспоримых сильных сторон является модуль Tokenizers, который обеспечивает эффективное преобразование текста в формат, подходящий для подачи на вход трансформерам. Он обрабатывает сложные аспекты, такие как токенизация, паддинг и усечение, что позволяет моделям корректно воспринимать даже длинные и сложные тексты. Специальный модуль Pipeline призван упростить использование моделей без необходимости писать обширный код.

С его помощью можно быстро настроить и протестировать различные задачи — от классификации до генерации текста — что идеально подходит для прототипирования и обучения. Платформа Hugging Face также предлагает коллекцию Datasets — наборов данных, которые облегчают процесс обучения и оценки моделей. Это особенно полезно для разработчиков, которым приходится работать с большими объемами данных и нужно быстро загружать, фильтровать и предобрабатывать информацию. Библиотека Transformers является основой всей экосистемы, поддерживая несколько популярных фреймворков и давая возможность использовать, тренировать и дообучать модели в PyTorch, TensorFlow или JAX. Такая кросс-платформенность значительно расширяет круг пользователей и случаев применения.

Помимо технических преимуществ, Hugging Face поддерживает сообщество через Model Hub, где тысячи моделей доступны для бесплатного использования. Это стимулирует обмен знаниями и инновациями, делая процесс разработки открытым и демократичным. Обширный выбор предобученных моделей включает одни из самых популярных архитектур — от BERT и RoBERTa для точного понимания текста, до GPT-3 и T5 для генерации и обработки естественного языка. Эти модели нашли применение во многих сферах: бизнес автоматизирует обработку клиентских отзывов и обращений, юристы извлекают важные сущности из документов, а научные организации изучают вопросы и ответы в огромных массивах информации. Среди самых востребованных задач, решаемых с помощью Hugging Face, стоит выделить классификацию текста, когда модели помогают разделять текст на категории, определять негативные или позитивные отзывы, выявлять спам и многое другое.

Другая востребованная область — это именованное распознавание сущностей, позволяющее выявлять ключевые элементы — имена, даты, места — из необработанных текстов. Для поддержки клиентов и организации информации активно используются системы ответов на вопросы, где модели способны находить конкретные факты и сведения в документах. Кроме того, трансформеры демонстрируют впечатляющую способность создавать качественные тексты на заданную тему или кратко излагать большие объемы информации — что широко применяется в генерации контента и автоматическом создании отчетов. Несмотря на множество преимуществ, пользователи Hugging Face сталкиваются с рядом вызовов. Крупные модели требуют значительных вычислительных ресурсов, что может стать препятствием для тех, кто работает с ограниченными техническими средствами.

Кроме того, библиотека основной акцент делает на NLP, что не всегда подходит для задач в других областях машинного обучения. Масштабирование решений для корпоративного использования может вызвать сложности, требующие серьезных инвестиций в инфраструктуру. Еще одним моментом является различное качество моделей, предлагаемых сообществом, поэтому внедрение требует внимательного отбора и тестирования. В целом, благодаря своей универсальности, простоте и открытому доступу Hugging Face Transformers стал неотъемлемой частью современного ландшафта искусственного интеллекта. Постоянное развитие, поддержка сообщества и обширный функционал превращают библиотеку в мощный инструмент, способный помочь в решении множества сложных и разнообразных задач — от исследования и экспериментов до промышленного внедрения.

Пользователи получают возможность работать с передовыми моделями без необходимости глубокого погружения в технические детали, что дает огромное преимущество для бизнеса, науки и образования. Hugging Face предлагает уникальное сочетание инноваций, удобства и поддержки, которое продолжит влиять на развитие технологий и изменять способы взаимодействия человека с машинами во всех сферах жизни.