В последние годы большие языковые модели, такие как GPT и другие крупномасштабные трансформеры, стали неотъемлемой частью современных технологий искусственного интеллекта. Они демонстрируют впечатляющие результаты в области генерации текста, перевода, ответах на вопросы и даже творческом письме. Однако за этими выдающимися способностями скрывается фундаментальный вопрос: действительно ли такие модели могут читать и понимать текст так, как это делает человек? Можно ли считать, что LLM обладают настоящими навыками чтения, или же их возможности ограничиваются сложным статистическим анализом и подстройкой под шаблоны данных? Понимание этого важно не только с теоретической точки зрения, но и с практической – оно влияет на дальнейшее развитие ИИ и его применение в различных сферах. Чтение для человека – это не просто распознавание букв и слов, а сложный когнитивный процесс, включающий осмысление, интерпретацию, выделение контекста и формирование связного понимания. Мы обучаемся читать с детства, учимся связывать слова с конкретными образами, мыслями, чувствами, а также применять накопленный жизненный опыт для интерпретации смыслов.

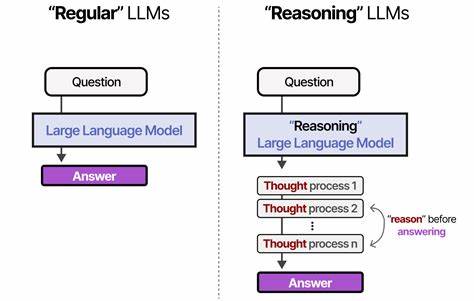

Именно поэтому традиционное чтение подразумевает глубокое понимание, которое выходит за пределы простой передачи информации. Большие языковые модели работают по иным принципам. Они обучаются на огромных корпусах текстов, анализируя статистические зависимости между словами и фразами. Благодаря архитектуре трансформеров и сложным алгоритмам внимание, LLM способны прослеживать длинные контексты и предсказывать наиболее вероятные продолжения текста. Но при этом они не обладают сознанием, не имеют внутреннего опыта или интуиции.

Их «понимание» ограничено паттернами, обнаруживаемыми в данных, и параметрами модели. Критики утверждают, что LLM – это своего рода блестящие имитаторы текста, которые не способны к подлинному смысловому восприятию. Тексты, генерируемые этими моделями, могут выглядеть связными и логичными, но при глубоком анализе обнаруживаются несоответствия, ошибки фактов и отсутствие истинного контекста. Это подтверждает тезис о том, что LLM «читают» скорее формально и поверхностно. С другой стороны, возможности современных моделей впечатляют даже скептиков.

Они могут распознавать сложные языковые конструкции, отвечать на вопросы, основанные на предыдущих данных, анализировать настроения в текстах и даже осуществлять творческие задания на основе заданной темы. Это указывает на то, что в иерархии языковых задач LLM занимают высокое место и могут выполнять функции, ассоциирующиеся с чтением. Важным аспектом является различие между восприятием и пониманием. Модели воспринимают текст в том смысле, что они получают входные данные и обрабатывают их по заданным алгоритмам. Настоящее понимание включает более сложные процессы, такие как выводы на основе личного опыта, эмпатия и критический анализ.

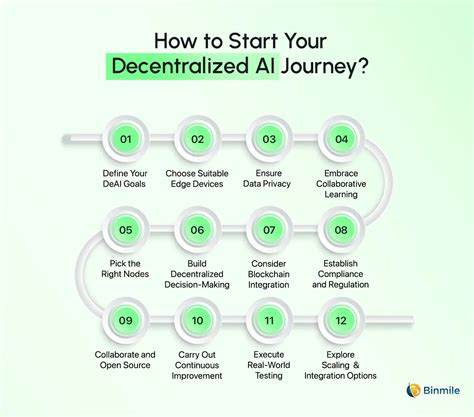

Лично для ИИ эти процессы пока недостижимы. Некоторые исследователи предлагают рассматривать LLM как инструменты, расширяющие возможности чтения для человека. Вместо противопоставления «чтения человека» и «чтения ИИ» полезно думать о сотрудничестве, где модели помогают обрабатывать большие объемы информации, делать предварительные анализы и выявлять ключевые идеи. Таким образом, роль LLM становится вспомогательной в процессе человеческого понимания. Вопрос о том, могут ли большие языковые модели действительно читать, также затрагивает этические и философские аспекты.

Если мы придаем ИИ слишком высокий статус разумных существ, мы рискуем переоценить их возможности и недооценить человеческий фактор. Наоборот, понимание ограничений моделей поможет создавать более надежные и безопасные системы, которые будут служить во благо общества. Научные эксперименты с LLM продолжаются, и новые поколения моделей становятся все более сложными и многофункциональными. Возможно, в будущем появятся системы, которые будут ближе к человеческому пониманию текста, но пока большой языковой модель можно доверять выполнять задачи, требующие распознавания речи и генерации текста, но не подразумевающие глубокого семантического анализа. Таким образом, несмотря на впечатляющие успехи, большие языковые модели не обладают настоящей способностью к чтению в человеческом понимании.

Они являются мощными инструментами для обработки и генерации текста, работающими на базе статистики и паттернов, но лишенными осмысленного понимания. Пользователям и разработчикам важно помнить об этом при интеграции ИИ в повседневные задачи и при принятии решений, основанных на результатах работы LLM. При грамотном использовании большие языковые модели способны значительно облегчить работу с информацией, при этом подлинный процесс чтения остается уникальной функцией человеческого разума.