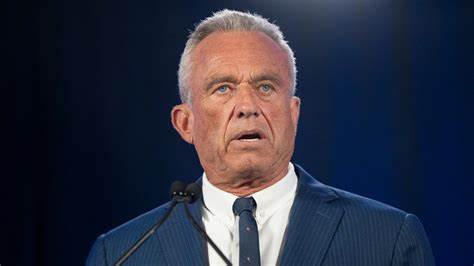

Идея широкого внедрения искусственного интеллекта в различные отрасли и сферы жизни становится одним из главных трендов современности. Однако когда речь заходит о применении ИИ в таких чувствительных сферах, как здравоохранение и проверка лекарственных препаратов, этот подход требует особой осторожности и глубокого понимания технологий. Недавно Роберт Кеннеди-младший, возглавляющий Министерство здравоохранения и социальных служб США, озвучил свою концепцию внедрения искусственного интеллекта практически во все аспекты работы ведомства. Его видение вызвало серьезные сомнения и критику среди экспертов, медиков и представителей научного сообщества. Анализируя подробности инициативы Кеннеди можно прийти к выводу, что такая политика, скорее всего, обернется серьезными проблемами и может нанести ущерб как системе здравоохранения США, так и доверия общества к медицинским институтам.

Кеннеди в своем интервью заявил, что «министерство переживает революцию ИИ» и предложил отказаться от слепого доверия традиционным экспертам в пользу искусственного интеллекта. Такая позиция вызывает тревогу, поскольку она ставит под сомнение десятилетия научных исследований и проверенных методик, на которых основаны современные стандарты медицины и здравоохранения. Искусственный интеллект — безусловно мощный инструмент, но он не является универсальным решением всех проблем. Особо остро это проявляется, когда речь идет о более сложных и многогранных вопросах, таких как оценка лекарственных препаратов, выявление побочных эффектов и реакции организма человека на новые методы лечения. Одним из ключевых моментов плана Кеннеди является использование ИИ для ускорения процесса одобрения новых лекарств на уровне Управления по контролю за продуктами и лекарствами США (FDA).

По словам Кеннеди, искусственный интеллект способен заменить традиционные методы, включая тестирование на животных, что, на первый взгляд, звучит гуманно и прогрессивно. Надо отметить, что подобные изменения уже часть политики FDA после принятия Закона о модернизации FDA 2.0, который предусматривает постепенный отказ от лабораторных испытаний на животных в пользу компьютерных моделей и анализа больших данных. Однако важно понимать, что компьютерные модели и искусственный интеллект могут лишь дополнить, но не полностью заменить сложные биологические эксперименты и клинические испытания. Простое ускорение процесса без достаточной проверки может привести к выходу на рынок препаратов с недостаточно изученными последствиями.

Кроме того, использование ИИ в сфере здравоохранения сопряжено с необходимостью работы с гигантскими массивами данных, включая медицинские записи, результаты исследований и статистику заболеваемости. Кеннеди утверждает, что ИИ позволит «эффективно анализировать мегаданные» и принимать «правильные решения о вмешательствах». Однако такой подход требует высококачественной и достоверной информации, а также строгого контроля над алгоритмами, чтобы исключить искажения и ошибки. В противном случае решения, принятые на основе ошибочных данных или предвзятых моделей, могут не только не улучшить ситуацию, но и усугубить проблемы, поставив под угрозу здоровье миллионов людей. Не менее важная проблема — повышение уровня недоверия к фармацевтической промышленности и медицинской науке, которая уже долгое время находится в центре общественных споров и теорий заговора.

Критические заявления Кеннеди относительно вакцин, а также его призывы «перестать доверять экспертам» лишь подливают масла в огонь. Внедрение ИИ, которое подается как панацея и альтернатива «традиционной» медицине, может использоваться как инструмент для распространения недостоверной информации и усиления скептицизма по отношению к проверенным методам лечения. Это критически опасно в условиях пандемий и необходимости массированной вакцинации населения. Практический пример негативных последствий поспешных инициатив можно увидеть в опыте программы, направленной на борьбу с мошенничеством, злоупотреблениями и нецелевым расходованием средств в системе здравоохранения. Программа, вдохновленная принципами ИИ, под руководством Илона Маска под названием DOGE, вызвала масштабные увольнения сотрудников Центров по контролю и профилактике заболеваний (CDC), последовавшие за ошибочными предположениями и недостаточной проверкой.

Позже произошла массовая реабилитация персонала, что продемонстрировало опасность торопливого и неграмотного внедрения технологий без должного анализа и экспертизы. Ключом к успешному применению искусственного интеллекта в медицине должна стать интеграция технологий с надежным научным подходом и четкими этическими нормами. При этом нельзя забывать, что ИИ — лишь инструмент, который должен дополнять работу специалистов, а не заменять их. Беспрекословное замещение человеческого фактора алгоритмами без учета индивидуальных особенностей пациентов и сложных процессов в живом организме грозит привести к ошибкам, потерям и снижению качества медицинской помощи. В конечном итоге идея масштабного «внедрения ИИ во всё» представляется не только рискованной, но и потенциально разрушительной для системы здравоохранения и доверия общества к науке.

![Running AI on a Raspberry Pi [video]](/images/205EBCE3-3791-47F7-AD76-939034B7F046)