В современном мире искусственный интеллект развивается стремительными темпами, меняя способы взаимодействия человека с технологиями и открывая новые горизонты для решения сложнейших задач. Одним из ярких представителей новейших достижений в области языковых моделей является Qwen3-235B-A22B-Thinking-2507 — усовершенствованная версия крупной модели с расширенными возможностями для интеллектуального анализа и генерации текста высокой сложности. Эта модель, обладая 235 миллиардами параметров, выводит продуктивность и качество работы ИИ на качественно новый уровень, уверенно конкурируя с ведущими проприетарными решениями на рынке. Одной из ключевых особенностей Qwen3-235B-A22B-Thinking-2507 стало заметное улучшение способностей к рассуждению и глубокому анализу. Она превосходит своих предшественников, демонстрируя высокие результаты в различных областях — от логики и математики до естественных наук, программирования и академических исследований.

Способность эффективно выполнять сложные задачи, которые раньше требовали вмешательства человека, является принципиальным шагом вперёд для открытого исходного кода и доступных ИИ систем. Разработчики модели оптимизировали обучение, включив в него как этап предварительной тренировки, так и этап посттренировки, что позволило сбалансировать качество генерации и способность следовать инструкциям, а также работать в режиме инструментальных вызовов. Улучшенные механизмы адаптации под человеческие предпочтения делают взаимодействие с системой максимально естественным и продуктивным, что особенно важно для использования в профессиональной и творческой сфере. Уникальной технической характеристикой Qwen3-235B-A22B-Thinking-2507 является её поддержка ультрадлинного контекста до 262144 токенов по умолчанию, с возможностью расширения практически до 1 миллиона токенов. Это делает модель незаменимой для обработки объемных документов, анализа больших массивов данных и долговременного ведения диалогов без утери контекста.

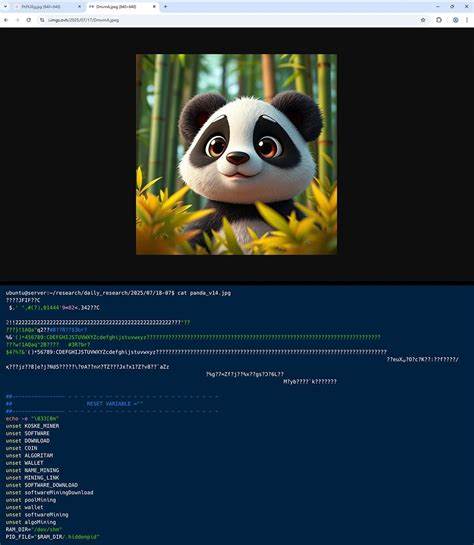

Технологии, лежащие в основе такой масштабируемости, включают Dual Chunk Attention — инновационный метод разбиения длинных последовательностей на управляемые части с сохранением глобальной когерентности, а также MInference — механизм разреженного внимания, который значительно снижает вычислительную нагрузку, фокусируясь на наиболее значимых взаимодействиях между токенами. Модель оснащена 94 слоями и 128 экспертами, из которых активируются 8, что способствует эффективному распределению вычислительных ресурсов и позволяет достигать баланса между производительностью и затратами на инференс. Такое устройство параметров обеспечивает устойчивость к переобучению и высокую гибкость в решении задач разных типов. При сравнении производительности Qwen3-235B-A22B-Thinking-2507 с другими современными моделями на известных бенчмарках, включая MMLU-Pro, GPQA, AIME25, LiveCodeBench и PolyMATH, она занимает лидирующие позиции среди моделей с открытым исходным кодом. Сильная сторона модели — это её способность показывать выдающиеся результаты в математическом и логическом анализе, а также в написании кода, что открывает широкие возможности для автоматизации сложных технических и научных задач.

При работе с моделью рекомендуется задавать параметры выборки для генерации текста с температурой 0.6, TopP 0.95 и TopK 20, что позволяет достичь баланса между разнообразием ответов и сохранением связности мыслей модели. Весомым преимуществом является возможность создавать выводы общей длиной до 32768 токенов для большинства сценариев и увеличивать их до 81920 токенов для особо сложных запросов, связанных с конкурирующими уровнями детализации в математике и программировании. Для удобства использования Qwen3-235B-A22B-Thinking-2507 поддерживается интеграция с передовыми фреймворками и инструментами, такими как Hugging Face Transformers, SGLang и vLLM, обеспечивающими упрощённый запуск и масштабируемость.

Пользователи могут быстро настроить локальные или облачные решения с поддержкой гибкого размером контекста и эффективным управлением использованием GPU памяти, что критично при работе с большими моделями. Разработчики также акцентируют внимание на агентных способностях модели через Qwen-Agent — инструмент, значительно снижающий сложность внедрения функционала вызова внешних инструментов и API. Такая архитектура способствует созданию продвинутых интеллектуальных агентов, способных решать комплексные бизнес-задачи, автоматически взаимодействовать с различными сервисами и обеспечивать многошаговые рассуждения. Ультра-длинный контекст и механизмы эффективной работы с ним делают модель привлекательной для приложений в области обработки юридических документов, научных публикаций, финансового анализа и даже крупноформатного контент-менеджмента. Возможность поддерживать и анализировать последовательности вплоть до миллиона токенов без существенной деградации качества открывает новые перспективы для корпоративных клиентов и исследовательских учреждений.

В вопросах датасетов и лицензирования Qwen3-235B-A22B-Thinking-2507 распространяется с лицензией Apache-2.0, что гарантирует широкую доступность и свободу использования для самых разных задач. Ее базовые обучающие слои опираются на современные стандарты обучения языковых моделей с учётом последних публикаций в научной литературе и компетенций ведущих специалистов в области машинного обучения. Область применения Qwen3-235B-A22B-Thinking-2507 разнообразна — начиная от интеллектуальных чат-ботов и систем автоматического написания кода до научных ассистентов и платформ для глубокого анализа текста. Благодаря высокой точности и эффективности рассуждений модель становится предпочтительным выбором для проектов, где важна надёжность и глубина понимания.

Пользователи, стремящиеся к максимальному раскрытию возможностей модели, получат пользу от применения улучшенных стратегий генерации, таких как соблюдение формата вывода, назначение специальных промптов с просьбой к модели обоснованно рассуждать шаг за шагом и аккуратно структурировать финальные ответы. Такие меры значительно повышают воспроизводимость и качество итогового результата. Таким образом, Qwen3-235B-A22B-Thinking-2507 представляет собой важный этап эволюции языковых моделей, объединяя масштаб вычислительных ресурсов, инновационные архитектурные решения и практическую применимость в реальных сценариях. Эта модель открывает новую эру в развитии открытого искусственного интеллекта, способного не только обрабатывать большие объемы данных, но и мыслить, рассуждать и творить на уровне, близком к человеческому, что существенно расширяет границы нашего взаимодействия с цифровыми системами.