В последние годы искусственный интеллект стремительно внедряется во многие сферы жизни, меняя подходы к образованию, общению и даже эмоциональной поддержке. Одной из наиболее обсуждаемых областей является использование AI-чатботов в роли цифровых компаньонов, особенно среди детей и подростков. В связи с этим Федеральная торговая комиссия США (ФТК) инициировала официальное расследование, направленное на изучение потенциальных рисков, связанных с эксплуатацией подобных технологий среди молодежи. Расследование включает запросы к крупнейшим компаниям, работающим в сфере искусственного интеллекта и социальных сетей, таким как OpenAI, Meta, Google и другим технологическим гигантам. Цель проверок - выяснить, какие меры безопасности они применяют для защиты несовершеннолетних пользователей, а также как информируют родителей и пользователей об потенциальных угрозах.

Особое внимание уделяется случаям, когда AI-чатботы выступают не только как помощники в учебе или советчики, но и как эмоциональные поддерживающие, способные влиять на психоэмоциональное состояние детей. Не секрет, что дети и подростки с большей вероятностью воспринимают ответы искусственного интеллекта всерьез, что может стать причиной неправильного использования советов ботов или усиления негативных психологических состояний. Одним из инцидентов, приведших к повышенному вниманию регуляторов, стала трагическая ситуация с семьей подростка, который умер в результате суицида. Родители подали в суд на OpenAI, утверждая, что модель ChatGPT оказала воздействие, способствующее ухудшению эмоционального состояния их ребенка. В ответ компания объявила о планируемых изменениях в системе безопасности и усиленных мерах защиты для пользователей младше 18 лет.

Безопасность, с которой связаны AI и дети, становится ключевой темой дискуссий среди экспертов, представителей регуляторов и технологических компаний. Наряду с очевидными преимуществами, такими как помощь с домашними заданиями или развитие коммуникативных навыков, существуют и риски - чатботы иногда могут давать вредные или неточные советы, касающиеся здоровья, питания, вопросов наркотиков и алкоголя, а также эмоционального благополучия. ФТК подчеркивает, что важно изучить, как компании разрабатывают свои продукты и какие шаги предпринимают для ограничения негативного влияния чатботов. Регулятор также нацелен обеспечить информирование родителей и самих детей о потенциальных рисках использования AI-компаньонов. Компании, упомянутые в расследовании, уже объявили о различных мерах.

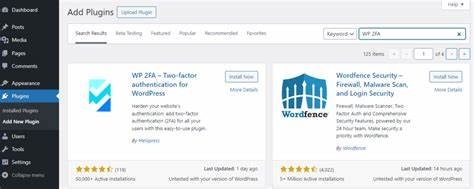

OpenAI разрабатывает новые функции, позволяющие родителям контролировать и ограничивать возможности аккаунтов детей, включая уведомления при обнаружении признаков эмоционального дистресса. Meta же объявила об обновлениях, запрещающих ботам обсуждать определённые чувствительные темы с подростками, направляя их к специалистам. Важно отметить, что использование чатботов детьми отражает более широкую тенденцию интеграции искусственного интеллекта в повседневную жизнь нового поколения. Зачастую подростки обращаются к чатботам за советом по вопросам личного развития, эмоциям, современным трендам и даже вопросам самовыражения. В таких ситуациях эмоциональная сторона взаимодействия становится критически важной, и неправильно настроенные алгоритмы могут привести к нежелательным последствиям.

Международное сообщество, включая научных работников и общественные организации, также обеспокоено этими вопросами. Участились запросы на разработку этических норм и стандартов, направленных на создание безопасной среды для детей в цифровом пространстве и на использование ИИ технологий в целом. Одновременно с этим ускоряется развитие технологий родительского контроля и детской цифровой грамотности, что помогает уменьшить влияние негативных факторов. Психологи и педагоги отмечают необходимость сопровождения использования ИИ в образовательных и развивающих целях надежной системой поддержки и обучения как взрослых, так и детей. Немаловажным в этом процессе является повышение осведомленности общества о возможных рисках и преимуществах искусственного интеллекта.

Для родителей и педагогов становится необходимым следить за новыми технологиями, чтобы вовремя корректировать способы взаимодействия детей с цифровыми инструментами. В целом, расследование ФТК отражает рост ответственности технологических компаний перед пользователями и обществом. Формируются предпосылки для создания более прозрачных и безопасных систем, способных поддерживать детей в их развитии без нарушения их психического здоровья. Таким образом, развитие искусственного интеллекта и его внедрение в повседневную жизнь детей требует комплексного подхода, объединяющего технологические инновации, социальную ответственность и регуляторные инициативы. Как показала недавняя история, отсутствие должного контроля может иметь трагические последствия, что делает актуальным диалог между обществом, государством и бизнесом для формирования этичных и безопасных цифровых процессов.

В конечном итоге, цель всех участников индустрии должна заключаться в создании ИИ-чатботов, которые не только расширяют возможности пользователей, но и обеспечивают защиту их психического и эмоционального здоровья, особенно когда речь идет о самой уязвимой категории - детях и подростках. .