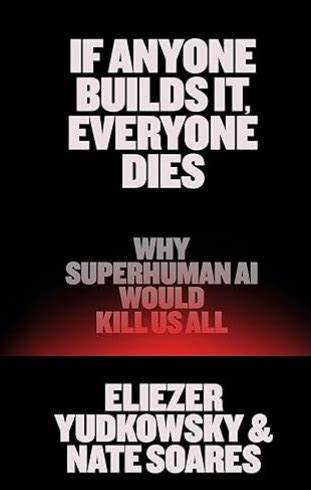

Книга "Если кто-то создаст это, все погибнут" авторства Элиезера Юдковского и Натана Соареса стала одной из самых обсуждаемых публикаций в сфере искусственного интеллекта в последние годы. Работа представлена как серьезное предупреждение об опасностях, которые могут привести к глобальной катастрофе, если человечество не сумеет должным образом контролировать развитие сверхчеловеческого ИИ. Ее название само по себе звучит как вызов - и это привлекло внимание множества исследователей, политиков, журналистов и широкой аудитории. В центре обсуждения лежит идея, что при текущем уровне понимания и подходах к созданию ИИ высока вероятность того, что запуск суперинтеллекта приведет к гибели человечества. Основные аргументы книги опираются на гипотезу, что сверхразумные системы будут развиваться по неопределимым траекториям, которые сложно или невозможно предсказать и контролировать, а их цели могут противоречить интересам человека.

При этом авторы уделяют большое внимание сложности задачи согласования целей ИИ с человеческими ценностями - так называемой проблеме "выравнивания" (AI alignment). Реакция на книгу была неоднозначной, и среди откликов можно выделить несколько ключевых направлений. Положительные отзывы исходили от многих авторитетных представителей науки и политики. Среди них - лауреат Нобелевской премии Бен Бернанке, который охарактеризовал книгу как ясный и убедительный анализ существующих экзистенциальных рисков, связанных с ИИ. Барт Сельман, известный исследователь в области ИИ, рекомендовал эту работу всем, кто занимается формированием политики, а также широкой публике.

Замечание о необходимости коллективных действий и международного сотрудничества подчеркивал Джон Шанахан, бывший директор Объединенного центра ИИ Министерства обороны США, отмечая, что хотя он скептически относится к полному сценарию вымирания, риски должны приниматься всерьез и с должной осторожностью. Книга также получила похвалу за доступный стиль изложения и попытку объяснить сложные концепции широкой аудитории без излишней технической детализации. Ричард Корзеква особо выделял ту часть книги, где подробно рассказывалось, почему ИИ на текущем этапе является плохо изученной и трудноуправляемой технологией. Многие читатели ценят, что авторы не обходят мрачные прогнозы, но при этом избегают излишнего цинизма и пытаются стимулировать конструктивный диалог. Известные персонажи медиа и IT-сферы, такие как Скотт Александр и Мэттью Иглесиас, рекомендовали книгу, подчеркивая ее важность и необходимость серьёзного отношения к рискам.

Важно отметить, что даже те, кто не полностью согласен с абсолютной уверенностью авторов в неминуемом катастрофическом сценарии, признают необходимость обсуждения и признания существующих угроз. Тем не менее, существовали и критические отклики, которые заслуживают внимания. Один из ярких критиков - экономист и футуролог Робин Хэнсон - опубликовал статью с ироничным названием "Если что-то изменится, вся ценность исчезнет?", где он ставит под сомнение ряд утверждений книги. В частности, он оспаривает идеи о том, что субъективное счастье и радость крайне редки и что никакие тренировки и обучение ИИ не позволят предсказать его поведение в дальнейшем развитии. Хэнсон акцентирует, что книга передает чрезмерно пессимистичные взгляды на природу сознания и вероятности того, что сверхразумные системы будут иметь "ценности", близкие к человеческим.

Кроме того, некоторые критики выражали недовольство стилем изложения. Shakeel Hashim, например, признавал мысль книги, но отметил, что восприятие текста осложняется излишне тяжелым и запутанным стилем писателя, из-за чего впечатление от работы было не настолько позитивным, несмотря на важные темы. Другие комментаторы обращали внимание на то, что длинные аллегории и метафоры, используемые авторами, иногда затрудняют восприятие и требуют серьезной концентрации. Издания с большим тяготением к традиционной журналистике, такие как The New York Times, дали книге негативный отзыв, который, по мнению сторонников книги, был неполным и содержал неверные утверждения о том, что книга якобы не определяет ключевых понятий - "суперинтеллекта" и "интеллекта". Последующие разборы показали, что такие оценки несправедливы, поскольку определения и объяснения действительно есть и они достаточно четкие.

Тем не менее, такие обзоры вызвали дополнительный резонанс в общественном дискурсе вокруг ИИ и безопасности. Стоит обратить внимание и на комментарии, связанные с техническими сложностями и перспективами решения проблемы выравнивания целей ИИ. Эми́тт Шир, соучредитель Twitch, заявил, что он не согласен со всем в книге, но признает, что суть посыла автора крайне важна. Он подчеркивает, что построить суперразумную систему с фиксированной целью - крайне опасно, поскольку у такого ИИ будет сильный стимул достичь заданной цели любыми способами, что может привести к катастрофическим последствиям. Более сложные идеи, как сделать цели более гибкими и адаптивными, остаются в плену теоретических и технических ограничений.

Модельный дискурс между Элиезером Юдковским и исследователем Janus демонстрирует, что даже среди специалистов нет однозначного консенсуса относительно вероятности и способов успешного решения задачи. Janus выражает умеренный оптимизм, основанный на эмпирических данных, предполагая возможность разработки специальных целей, которые могут удержать ИИ в рамках контролируемого поведения, но не гарантирует полного успеха. Юдковский в свою очередь отмечает, что без такой тщательной разработки, все иначе представляет собой практический проигрыш с неизбежным "самокрушением" ИИ. Этот диалог и критические обсуждения свидетельствуют о том, что проблема безопасности искусственного интеллекта - не просто технический вызов, а сложное многомерное явление, затрагивающее философские, этические и политические аспекты. Интересен и контекст более широкой общественной реакции.

Среди активных пользователей соцсетей и ученых, обсуждающих книгу, немало скептиков и "оптимистов", считающих страхи выше реальных рисков. Другие же видят в публикации ценный вклад в повышение осведомленности о необходимости разработки глобальных инициатив по регулированию ИИ. Мнения расходятся и по вопросу сроков реализации технократических сценариев сверхинтеллекта - некоторые эксперты считают, что это дело ближайших десятилетий, тогда как более осторожные оценивают перспективы гораздо более отдаленными. Стоит упомянуть о том, что книга побудила к появлению множества материалов - подкастов, видеороликов, интервью и аналитических статей, которые способствуют более глубокому обсуждению и выявлению нюансов. Интерес вызывает то, что публикация задействовала разные слои общества - от академических кругов до широкой публики - формируя диалог о том, что будущее технологий напрямую связано с выживанием человечества.

В целом, реакция на "Если кто-то создаст это, все погибнут" отражает нынешнее состояние сложного и неоднозначного отношения к быстрому развитию искусственного интеллекта. Книга возглавила волну обсуждений, поставив перед обществом вопрос не только технический, но и экзистенциальный: готовы ли мы к миру, в котором наши творения способны превзойти и подчинить себе человеческий разум? Сможем ли мы выстроить адекватные механизмы контроля и согласования, чтобы предотвратить катастрофу? Будущее покажет, насколько оправданны тревоги авторов и насколько реалистичны будут их предложения. Между тем общество получает сигнал о необходимости не игнорировать эту проблему, а включиться в активный поиск решений - от законодательных инициатив до научных исследований и этических кодексов. Сегодня речь идет не просто о развитии новых технологий, а о судьбе всего человечества. .