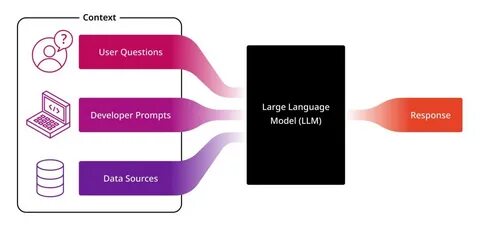

В последние годы большие языковые модели (LLM), такие как ChatGPT, Claude и Gemini, прочно вошли в повседневную рабочую среду многих специалистов. Их способность быстро генерировать текст, помогать в программировании и упрощать рутинные задачи впечатляет, однако вопросы безопасности и конфиденциальности данных остаются в центре внимания, особенно для тех, кто работает с особо чувствительной информацией. В данной статье рассмотрим точки зрения профессионалов в области приватности данных, а также пробуем разобраться в том, насколько безопасно использование LLM в рабочих условиях. Для начала стоит понять, что именно пугает специалистов по безопасности и конфиденциальности. В ситуациях, когда речь идет о финансовой, медицинской или любой другой чувствительной информации, даже малейший риск утечки данных может привести к серьезным последствиям как для компании, так и для клиентов.

Многие LLM-платформы работают через облачные сервисы, что предполагает передачу данных сторонним серверам. Это вызывает опасения, что конфиденциальная информация может быть случайно обнародована, использована для обучения моделей третьими сторонами или же стать объектом кибератак. Реакция профессионалов из приватного сектора на использование LLM на рабочем месте достаточно разнообразна. Одни полностью избегают облачных сервисов и предпочитают локальные решения, разворачивая собственные языковые модели на своих мощностях в целях максимального контроля над данными. Другие, несмотря на осознание рисков, продолжают использовать популярные решения, такие как ChatGPT или GitHub Copilot, выражая надежду на соблюдение компаниями-провайдерами стандартов безопасности и конфиденциальности.

Часть же специалистов придерживается жесткой позиции — вообще не применять LLM при работе с любыми конфиденциальными материалами. Некоторые пользователи отмечают, что доверять облачным сервисам сложно, поскольку даже локальное использование некоторых инструментов может означать активное подключение к интернету для обновления или кэширования данных, что влечет за собой потенциальные утечки. В некоторых случаях советуют применять виртуальные машины и контейнеры, в которых хранятся исключительно рабочие данные и код, чтобы минимизировать вероятность раскрытия сведений за пределы изолированной среды. Еще одной проблемой является вопрос авторских прав и соблюдения лицензий. Многие пользователи указывают, что обучающие базы данных для LLM включают код и тексты без явного согласия авторов, что вызывает опасения о нарушении прав собственности и потенциальных юридических последствиях как для разработчиков моделий, так и для пользователей, работающих с ними.

Все чаще на форумах и в профессиональных сообществах можно встретить советы о необходимости придерживаться политики «не вводить в LLM данные, которые не должны стать публичными». Это становится своеобразным универсальным правилом, призванным сохранить конфиденциальность, учитывая, что абсолютно гарантировать безопасность информационного потока общедоступных моделей пока невозможно. Отдельный интерес представляет обсуждение перспектив создания и использования локальных LLM с открытым исходным кодом. Такие решения позволяют использовать возможности искусственного интеллекта без необходимости передачи данных в облако, что значительно повышает уровень контроля над информацией. При этом существенным барьером остается высокая стоимость аппаратного обеспечения, особенно для организаций и специалистов, которым требуется вычислительная мощность для поддержки быстро обучающихся и адаптирующихся моделей.

Стоит также отметить примеры компаний, которые интегрируют LLM в свои процессы, обучая собственные модели исключительно на внутренних данных и размещая их на серверах в рамках корпоративной инфраструктуры с высоким уровнем защиты. Такой подход часто встречается в финансовом и медицинском секторах, где конфиденциальность и соответствие законодательным требованиям — первостепенные факторы. Принимая текущие реалии современного ИИ, можно сказать, что LLM несомненно повышают производительность, ускоряют процесс принятия решений и помогают специалистам справляться с рутинными задачами. Однако в вопросах безопасности и приватности данных необходимо сохранять бдительность и применять комплексный подход. Ключевым моментом остается баланс между преимуществами технологий и рисками, которые они несут для сохранения конфиденциальной информации.