Децентрализованные финансы (DeFi) за последние годы доказали свою способность трансформировать финансовый ландшафт, предоставляя пользователям по всему миру доступ к инновационным инструментам без посредников и с высокой степенью открытости. С появлением искусственного интеллекта (ИИ) в этом секторе открывается совершенно новое направление - DeFAI, или DeFi, усиленный технологиями ИИ. Однако внедрение ИИ в децентрализованные протоколы несет не только потенциал для повышения эффективности и автоматизации, но и ставит перед сообществом весьма серьезные вызовы, связанные с безопасностью и прозрачностью работы таких систем. Важно понять, какие риски появляются в зоне пересечения DeFi и ИИ, и как индустрия может оперативно и эффективно реагировать на них, чтобы сохранить доверие и защитить активы пользователей. DeFi и его эволюция: взгляд на инновации Базой DeFi стали смарт-контракты - программируемые контракты на блокчейне, которые автоматизируют условия и исполнение сделок без участия посредников.

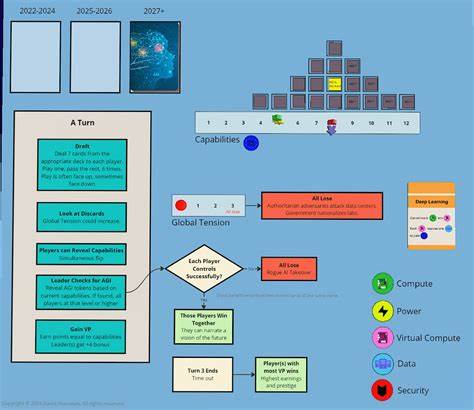

Их простая логика обеспечивала прозрачность и возможность аудита, что являлось фундаментом безопасности в экосистеме. Однако классические смарт-контракты часто строго фиксированы в своей логике: "если происходит событие X, то произойдет действие Y". С появлением ИИ эта парадигма меняется. DeFAI предлагает интеллектуальных агентов, способных самостоятельно принимать решения, анализируя данные в режиме реального времени, прогнозировать будущие события и адаптироваться к меняющемуся окружению. Такая гибкость обещает значительно повысить эффективность трейдинга, управления рисками и участия в управленческих процессах децентрализованных автономных организаций (DAO).

Проявления и риски DeFAI Умные боты, способные за секунды анализировать рынок и совершать сделки, выглядят инновационно и заманчиво. Однако ключевой момент заключается в природе этих ИИ-агентов. В отличие от традиционных смарт-контрактов, решения которых полностью предсказуемы и поддаются аудиту, ИИ функционирует на основе вероятностных моделей, что делает процесс принятия решений менее прозрачным и более трудно прогнозируемым. Такая "черная коробка" создает новые возможности для уязвимостей. Агентов ИИ могут атаковать через манипуляции с данными, называемые "отравлением данных", или используя методы адверсариальных атак - специально разработанных для обмана модели ввода.

В децентрализованных финансовых протоколах это способно привести к финансовым потерям, например, к совершению невыгодных сделок, исчерпанию ликвидности или искажению механизмов управления. Отсутствие прозрачности затрудняет своевременное выявление подобных атак или ошибок, поскольку для разработчиков и аудиторов сложно полностью понять логику и мотивацию ИИ-агентов. Кроме того, многие ИИ-инструменты в DeFi используют инфраструктуру Web2, то есть часть систем и сервисов, контролируемых централизованными организациями. Это противоречит базовой идее Web3 - децентрализации - и открывает дополнительную точку уязвимости, связанную с централизованной зависимостью. Необходимость прозрачной безопасности DeFAI Высокие темпы внедрения DeFAI не должны сопровождаться игнорированием системы безопасности.

Чтобы предотвратить возможные кибератаки и мошенничество, отрасли требуется разработать стандарты прозрачности и аудита ИИ-решений, взаимодействующих с DeFi. Без этого внедрение ИИ в децентрализованные протоколы может привести к потерям как для пользователей, так и для всей сети, что в итоге нанесет вред репутации и доверию к технологии. Один из ключевых шагов - это комплексное тестирование ИИ-агентов с применением методов ролевого моделирования и red-team практик. Такие тесты помогут выявить потенциальные слабые места модели и подготовить защитные меры до того, как реальные злоумышленники смогут их использовать. Не менее важна открытость алгоритмов и документации.

Публикация исходного кода и описаний архитектуры способствует созданию сообщества разработчиков и специалистов по безопасности, которые смогут совместно анализировать и улучшать систему. Это также соответствует философии Web3, основанной на проверяемости и взаимном доверии. Тестирование с учетом стрессовых сценариев способно подготовить ИИ-решения к работе в нестандартных, экстремальных условиях рынка, снижая вероятность сбоев и эксплуатации. Ответственность всех участников экосистемы В обеспечении защиты DeFAI должны участвовать не только разработчики и владельцы проектов, но и пользователи, инвесторы и сторонние аудиторы. Высокий уровень общего сознания безопасности помогает создавать более надежные протоколы, где риски максимально сведены к минимуму.

Для пользователей важна проверка выбора платформ и инструментов, на которых они работают. Необходимо отдавать предпочтение тем проектам, которые максимально открыты и проходят независимые проверки своих ИИ-моделей и смарт-контрактов. Только совместные усилия и дисциплина помогут сформировать устойчивую и безопасную экосистему. Инновации и безопасность могут и должны идти рука об руку - это главный урок, который прошлая история блокчейн-индустрии и DeFi подтвердила на практике. Перспективы развития технологий На горизонте появляются новые кросс-дисциплинарные решения, направленные на повышение надежности DeFAI.

Шифровальные методы, такие как доказательства с нулевым разглашением (zero-knowledge proofs), позволяют подтверждать корректность операций ИИ без раскрытия внутренней логики. Это открывает путь к новому уровню прозрачности и конфиденциальности одновременно. Ончейн-аттестация - технологии, фиксирующие происхождение и историю решений ИИ в рамках блокчейна - также представляют собой перспективный инструмент для отслеживания и анализа поведения агентов. Такие решения помогут установить ответственность и предотвратить мошеннические действия. Кроме того, появляются аудиторские инструменты на основе ИИ, способные анализировать поведение других ИИ-агентов и выявлять аномалии и потенциальные уязвимости, что позволяет оптимизировать работу над безопасностью в режиме реального времени.

Современные разработки ставят перед индустрией задачу не просто контролировать технологию ИИ, а строить систему, в которой ИИ поддерживает безопасность и доверие к DeFi, становясь мощным инструментом профилактики и оперативного реагирования на угрозы. Итог: качество безопасности - залог успешного DeFAI Развитие DeFAI - неизбежный процесс, открывающий новые горизонты для автоматизации и эффективности в децентрализованных финансах. Однако его скорость не должна обгонять создание надежной защитной среды. Каждый агент искусственного интеллекта - это сложный код, подверженный рискам и ошибкам, которые могут иметь разрушительные последствия, если их не учитывать. Технологии DeFi изначально строились на прозрачности, проверяемости и взаимном доверии.

Внедрение ИИ требует сохранения и развития этих принципов, чтобы предотвратить угрозы, несовместимые с идеей децентрализации. Результатом должен стать прозрачный, поддающийся контролю и открытому аудиту DeFAI, который станет драйвером инноваций, сохраняя при этом безопасность пользователей и протоколов. Все участники экосистемы должны работать сообща, объединяя технические, организационные и юридические ресурсы для создания безопасной среды, в которой будущее децентрализованных финансов и искусственного интеллекта будет реализовано на благо каждого пользователя. Только так можно избежать ловушек и обеспечить устойчивость нового этапа развития блокчейна и финансовых технологий. .