Современные технологии искусственного интеллекта во многом зависят от вычислительных мощностей графических процессоров (GPU), особенно на платформах NVIDIA. Однако в 2025 году исследователи из Университета Торонто продемонстрировали опасный вариант атаки под названием GPUHammer. Эта атака представляет собой новую разновидность известного аппаратного уязвимого RowHammer, которая позволяет злоумышленникам инициировать бит-флип (изменение битов) в памяти GPU, что приводит к искажению данных и ухудшению работы AI-моделей. RowHammer давно известна как уязвимость в динамической оперативной памяти (DRAM), связанная с физическим взаимодействием ячеек памяти. Повторяющиеся операции чтения определённых ячеек могут создать электрические помехи, вызывая ошибки в соседних ячейках, которые проявляются как неконтролируемые бит-флипы.

Аналогично тому, как атаки Spectre и Meltdown эксплуатируют механизмы процессоров, RowHammer использует физические особенности памяти. Но в отличие от процессоров, GPU долгое время оставались без должных механизмов защиты, таких как проверка четности или расширенное исправление ошибок, что создало благоприятные условия для развития подобных атак. GPUHammer выделяется именно своим воздействием на GPU-память NVIDIA, особенно на популярные модели с памятью GDDR6, такие как NVIDIA A6000. Исследователи смогли с помощью этого метода значительно снизить точность нейросетевых моделей обучения, построенных на базе ImageNet, с 80% до менее 1%. Одного бит-флипа достаточно, чтобы разрушить результаты работы сложной модели глубокого обучения, что демонстрирует серьёзную уязвимость AI-инфраструктуры в современных вычислительных средах.

Атака особенно опасна в условиях совместного использования GPU, что характерно для облачных платформ машинного обучения и виртуальных сред VDI. Злоумышленник, арендующий ресурсы на GPU в таких системах, потенциально может осуществить GPUHammer против соседних клиентов, не имея прямого доступа к их данным. Это создаёт сложную межклиентскую угрозу, не учитываемую во многих текущих системах безопасности для GPU. Важным аспектом уязвимости является то, что она работает даже при включённых механизмах защиты, таких как Targeted Row Refresh (TRR), которые были разработаны для снижения риска RowHammer. Это обусловлено отсутствием полноценной аппаратной защиты на уровне GPU.

В отличие от новых процессоров, у которых за годы исследований и внедрения появились продвинутые методы борьбы с подобными атаками, GPU долгое время оставались недостаточно защищёнными. Для частичной защиты NVIDIA рекомендует пользователям активировать системный механизм коррекции ошибок памяти — Error Correction Codes (ECC). ECC способен обнаруживать и исправлять отдельные ошибки в памяти, снижая вероятность успешных атак GPUHammer. Однако эта мера не лишена недостатков — активация ECC приводит к падению производительности согласно заявлению исследователей, примерно на 10% в задачах инференса на GPU A6000, а также уменьшает объём доступной памяти на 6,25%. Тем не менее данная компенсация считается приемлемой платой за повышение безопасности.

Стоит отметить, что более современные модели NVIDIA, включая серии H100 и RTX 5090, оснащены встроенной системой ECC на кристалле (on-die ECC), которая значительно повышает защиту от таких атак. Это за счёт улучшенного обнаружения и коррекции ошибок, вызванных физическими особенностями памяти, включая скачки напряжения на плотной памяти нового поколения. В контексте широкого применения AI на периферийных устройствах, автономных системах и в сфере выявления мошенничества, уязвимость GPUHammer приобретает особое значение. Коррупция модели без явных признаков взлома может привести к неправильным решениям и серьёзным последствиям, которые сложно своевременно выявить и устранить. Возможность бесшумного ухудшения качества работы ИИ повышает риски для безопасности и надёжности систем, выводя угрозу за пределы традиционных сфер кибербезопасности.

Для организаций, работающих с конфиденциальными или регулируемыми данными, а также применяющих ИИ в критически важных приложениях, GPUHammer представляет дополнительный регуляторный риск. Несанкционированные изменения модели или ошибок опровоцируют нарушения стандартов по безопасности данных, таким как ISO/IEC 27001, а также требованиям европейского законодательства по искусственному интеллекту. Поэтому защита GPU и памяти становится частью общей стратегии безопасности и аудита в IT-инфраструктуре. Атака GPUHammer также вписывается в более широкий тренд развития атак в области противодействия AI. Ранее злоумышленники сосредотачивались на вредоносных данных и моделях (input и data poisoning).

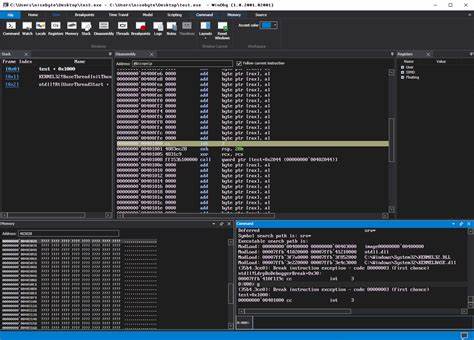

Но теперь атаки начинают осуществляться на более глубоком уровне — прямо в весах и параметрах модели, что существенно усложняет выявление вмешательства. Для успешной имитации GPUHammer исследователи использовали доказательство концепта, где один бит-флип устраивал искажение нейросети до практически полного отказа от правильных классификаций. Это доказывает, что даже минимальные аппаратные ошибки или атаки могут иметь разрушительные последствия для AI-систем. Учитывая важность вычислительных платформ NVIDIA для облачных сервисов и широкого круга отраслей, вопросы безопасности GPU и памяти требуют немедленного внимания. Крайне важно внедрять и развивать аппаратные и программные методы защиты, периодически проверять статус ECC и системных журналов на наличие коррекции ошибок, а также учитывать потенциальные риски в архитектуре совместного использования вычислительных ресурсов.

Дополнительно в академической среде обсуждается интеграция RowHammer с другими классическими уязвимостями, например, SpecHammer, который объединяет специулятивное выполнение (Spectre) и RowHammer для расширения атакующих возможностей. В целом, GPUHammer — это тревожный сигнал для индустрии, обозначающий, что с развитием AI и ростом зависимости от GPU необходимо системное переосмысление и усиление подходов к защите аппаратного обеспечения и доверия к моделям. Уже сегодня от информированности и проактивности разработчиков, инженеров и специалистов по безопасности зависит предотвращение серьёзных инцидентов и сохранение целостности AI-систем, лежащих в основе инноваций следующего поколения.