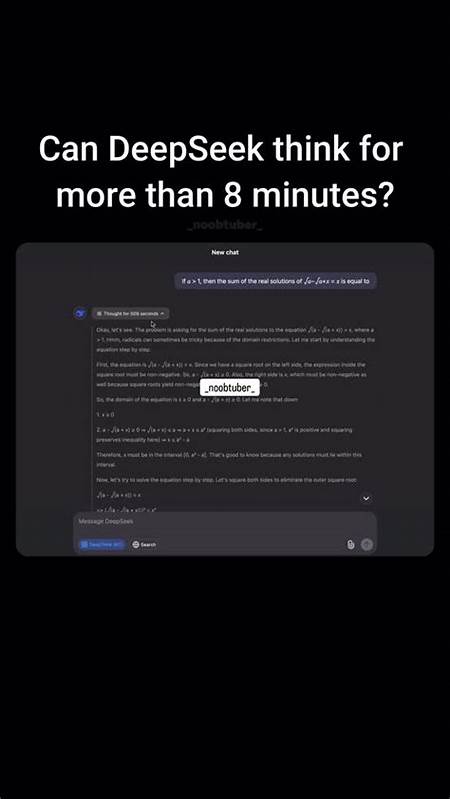

В современном мире искусственный интеллект и языковые модели становятся все более мощными инструментами, меняющими способы взаимодействия человека с информацией. Одной из таких инновационных разработок считается DeepSeek — модель, которая, в отличие от большинства коммерческих больших языковых моделей (LLM), демонстрирует уникальную возможность отображать свой внутренний процесс «мышления». Этот аспект вызывает живой интерес в профессиональном сообществе и среди энтузиастов, желающих понять, какие технические решения лежат в основе такого поведения. Попробуем подробно разобраться, как DeepSeek реализует этот процесс и что выделяет её среди других моделей. Главная особенность DeepSeek заключается в способности визуализировать этапы своего рассуждения до того, как выдает окончательный ответ.

Так называемое «внутреннее мышление» модели можно сравнить с тем, как человек планирует свои действия, обдумывает возможные варианты решения задачи и анализирует различную информацию перед принятием окончательного решения. В традиционных LLM этот этап чаще всего скрыт от пользователя, ведь модели стремятся напрямую предоставить ответ на поставленный вопрос, не раскрывая своих внутренних вычислений. Технически DeepSeek достигает уникального поведения через специально подготовленные датасеты, которые в своей структуре включают примеры, имитирующие процесс мышления с использованием так называемых think-тегов. Во время обучения модель получает множество образцов, где не просто приводится ответ, а подробно описывается рассуждение, что помогает ей выработать привычку «озвучивать» свои мысли на каждом этапе обработки запроса. Таким образом, DeepSeek словно обучается мыслить вслух, делая обоснования и выстраивая логику, которую может демонстрировать пользователю.

Казалось бы, что это простая особенность – вставлять теги и выводить текст с пояснениями, но на практике такой подход требует тщательно спроектированной архитектуры и продуманной стратегии обучения. DeepSeek использует сложные методы, позволяющие описывать промежуточные шаги вычислений, не снижая при этом качество и скорость генерации ответов. Именно за счёт игры с последовательностью токенов и тщательного приоритезационного отбора данных с think-тегами, модель вырабатывает навык рассуждения, который становится её отличительной чертой. В сообществе вокруг DeepSeek активно обсуждается вопрос о том, нет ли в основе этой технологии взаимодействия нескольких языковых моделей. Идея, что разные экземпляры ИИ могут специализироваться на выполнении различных ролей — одни продумывают решение, другие — оппонируют или предлагают альтернативные варианты, — кажется привлекательной и вдохновляется концепцией распределённого интеллекта.

Однако разработчики и эксперты указывают, что DeepSeek не использует несколько разнотипных моделей, взаимодействующих друг с другом для построения ответа. Этот миф развеян благодаря детальному анализу архитектуры и протоколов работы модели. Вместо кооперации множества разных моделей, DeepSeek применяет концепцию «Mixture of Experts» (MoE), современный тренд в развитии трансформеров и других архитектур глубокого обучения. MoE позволяет модели иметь несколько специализированных экспертных нейронных сетей (экспертов), каждая из которых отвечает за определённые аспекты обработки информации. Во время генерации ответа к каждому токену выборочно применяются только несколько «экспертов», что повышает производительность и общую точность вывода.

Обработка распределяется таким образом, что задействованы наиболее релевантные подсети, которые эффективно решают конкретную подзадачу. Этот подход отличается от классических моделей, где вся сеть применяется целиком к каждому примеру. Разделение на экспертов помогает масштабировать параметры модели без пропорционального увеличения вычислительных ресурсов. DeepSeek умеет эффективно распределять вычислительную нагрузку, используя специализированные механизмы маршрутизации, что позволяет ей работать на разнообразных устройствах и адаптироваться под задачи разного уровня сложности. И хотя MoE является важной составляющей архитектуры DeepSeek, она сама по себе не открывает внутренний процесс мышления для пользователя напрямую.

Вместо этого, именно специально обученные think-теги в тренировочных данных и оптимизация генерации с акцентом на развернутое пояснение шагов сделали DeepSeek по-настоящему уникальной. Таким образом, технология основана на комплексном сочетании архитектурных инноваций и интеллектуального подхода к обучению. В дополнение к базовой архитектуре DeepSeek широко исследует возможности «шардинга» — техники распределения частей модели по разным аппаратным ресурсам. Это позволяет эффективно масштабировать вычисления даже в больших системах, где задействованы несколько графических процессоров или серверов. Такая инфраструктурная гибкость необходима для работы сложных крупных моделей и улучшает общую отзывчивость и точность.

Несмотря на это, в текущей реализации DeepSeek нет механизма, при котором разные модели обменивались бы информацией для совместного решения задач. Для пользователя облегчённое отображение процесса «мышления» открывает новые перспективы использования систем искусственного интеллекта. Пользователь получает не просто ответ, а целый контекст, что повышает доверие и позволяет лучше понять логику модели. Это помогает избежать ситуаций, когда ИИ предоставляет неточную или неполную информацию, так как можно проследить цепочку рассуждений и выявить потенциальные ошибки или спорные моменты. Кроме того, возможность прозрачного отображения мыслительных этапов открывает дорогу для разработки более сложных систем с функциями самокоррекции и обучения на лету.

DeepSeek закладывает фундамент для будущих разработок, где искусственный интеллект может работать не как «чёрный ящик», а как партнёр, поясняющий свои действия и корректирующий их по запросу пользователя. Индустрия языковых моделей и ИИ в целом движется в сторону всё большей интерпретируемости и кастомизации. DeepSeek с её инновационным подходом к визуализации процесса рассуждения демонстрирует, что можно сочетать масштабируемость, производительность и прозрачность. Такие исследования и разработки способствуют формированию более этичных, эффективных и понятных искусственных интеллектуальных систем. Подводя итог, можно сказать, что DeepSeek — это не просто очередная языковая модель, а полноценный шаг вперёд в понимании и демонстрации внутренней логики работы ИИ.

Успех этой технологии основан на грамотной подготовке датасетов, использовании think-тегов, архитектурных инновациях с Mixture of Experts и гибком распределении вычислений. Всё это позволяет модели «думать вслух» и представлять пользователю продуманные и обоснованные ответы. Такой подход меняет парадигму взаимодействия с искусственным интеллектом и открывает новые возможности для использования ИИ в различных сферах — от науки и образования до бизнеса и творчества.