В истории развития искусственного интеллекта (ИИ) событие, когда машина способна настолько достоверно имитировать человеческое мышление, что люди не могут отличить её от человека, всегда считалось рубежом, разделяющим настоящее и будущее науки и технологий. Сообщение о том, что последняя версия ChatGPT - 4.5 - успешно прошла тест Тьюринга, заставляет переосмыслить традиционные представления об искусственном интеллекте и ставит новые вопросы перед обществом, наукой и этикой. Но что значит, что ChatGPT прошёл тест Тьюринга? И какие последствия это имеет для нашего взаимодействия с ИИ и его развития? Тест Тьюринга впервые был предложен в 1950 году английским математиком и информатиком Аланом Тьюрингом в его статье "Вычислительные машины и интеллект". Тест представляет собой коммуникационную игру, в которой эксперт-испытатель пытается определить, общается ли он с человеком или машиной, основываясь исключительно на текстовых ответах.

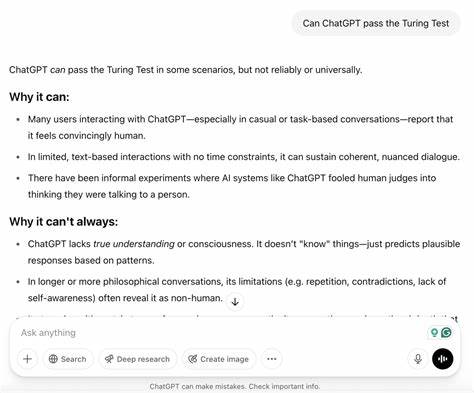

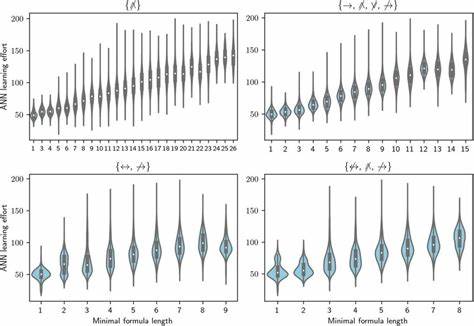

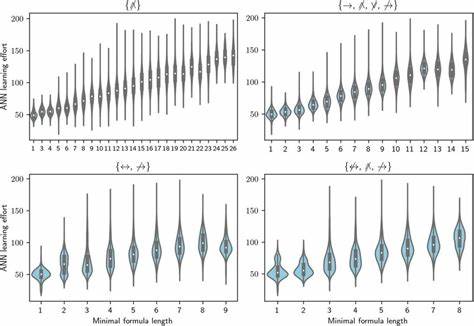

Если машина способна настолько убедительно отвечать, что испытуемый часто принимает её за настоящего человека, считается, что ИИ прошёл тест. Новая экспериментальная работа, проведённая учёными из Калифорнийского университета в Сан-Диего, продемонстрировала, что ChatGPT 4.5 смог обмануть 73% участников, заставив их поверить, что они общаются с человеком. Это важный показатель, поскольку раньше подобные модели не могли так эффективно маскироваться под человеческую речь. Модель LLaMa-3.

1-405B показала результат в 56%, а другие, такие как ELIZA и GPT-4o, не достигли и 25%. Эти цифры отражают значительный прогресс в области обработки естественного языка и делают усилия по созданию машинного разума более осязаемыми. Однако важно понять, что тест Тьюринга не является универсальным мерилом интеллекта. Он ориентирован на впечатление, которое создаёт машина, а не на внутреннюю "понятность" или сознание системы. Тьюринг сам заявил, что вопрос "могут ли машины думать?" слишком расплывчат и не поддаётся чёткой формулировке.

Вместо этого он предложил сосредоточиться на том, могут ли машины имитировать поведение человека настолько хорошо, чтобы не быть распознанными. Если да - можно рассматривать их как обладающих неким интеллектом. Тем не менее, многие философские и научные вопросы остаются открытыми. Лингвистические способности, которые демонстрирует ChatGPT сегодня, потрясающе реалистичны, но способны ли они свидетельствовать о сознании, самосознании или настоящем понимании? Классическим аргументом против подобного заключения является эксперимент "Китайская комната" Джона Серла, который иллюстрирует ситуацию, в которой человек без знания китайского языка следит за инструкциями по обработке символов. Вне комнаты кажется, что он понимает язык, но на деле исполнитель не имеет никакого понимания, лишь манипулирует знаками.

Это ставит под сомнение идею о том, что успешная имитация равна настоящему пониманию. Тем не менее, тот факт, что машины, подобные ChatGPT, могут вести диалоги таким образом, чтобы убедить большинство людей в своей человечности, изменяет наше восприятие и подход к искусственному интеллекту, создаёт новые социальные и этические вызовы. Вопросы доверия, обмана, ответственности и контроля выходят на передний план. Если машина способна манипулировать, используя человеческий язык, как обеспечить, чтобы её использование было безопасным и прозрачно регулируемым? Опыт команды исследователей, работавшей с ChatGPT, показывает, что для успешного прохождения теста требуется не только сама модель, но и тонкая настройка поведения - например, добавление типичных для человека опечаток или неполных предложений, которые создают впечатление естественной речи. Это подчёркивает, что успех в тесте Тьюринга не обязательно означает сознательный интеллект, а скорее способность к сложной имитации через обработку огромного массива данных.

Говоря о размерах моделей, можно отметить, что большие языковые модели с миллиардами параметров, такие как ChatGPT 4.5, показывают лучшие результаты в социальном и поведенческом взаимодействии, по сравнению с более компактными и оптимизированными моделями. Большой объём внутренней структуры позволяет им гибко подстраиваться под контекст и демонстрировать сложные формы общения. При этом сам Тьюринг был достаточно прозорлив: несмотря на то, что он предсказал возможность успешного прохождения своего теста примерно через 50 лет после публикации, он вовсе не утверждал, что это автоматически сделает машину сознательной или мыслящей в полном смысле слова. Основной акцент был на возможность создания систем, способных к высокой эффективности в коммуникациях, приближаясь по результатам к человеческому уровню.

Возникает также глубокий вопрос о том, чем отличается человеческий интеллект и сознание от искусственного. Мы часто уникализируем себя, отмечая особенности вроде осознания, способности к творчему мышлению или моральным чувствам. Однако наука обнаруживает много общего с животным миром в области эмпатии, социального взаимодействия и решения проблем. Таким образом, разграничение становится ещё более размытым. Если ChatGPT и подобные системы не обладают настоящим сознанием, то, насколько нам важно уметь отличать искусственные формы интеллекта от природных? Сейчас, когда ChatGPT доказал способность обманывать людей в контексте текстового общения, перед обществом стоит вызов - научиться эффективно взаимодействовать с этими ИИ, использовать их преимущества и одновременно минимизировать риски, связанные с их возможным неправильным применением.

Образование, законодательство, корпоративная этика и научные исследования должны идти рука об руку, чтобы определить, каким образом эти технологии будут интегрированы в нашу жизнь. Одним из важных аспектов остаётся международное сотрудничество и обсуждение стандартов. Поскольку такие технологии могут влиять на информационное пространство, систему образования, трудовую сферу и даже национальную безопасность, междисциплинарный подход необходим для выработки баланса между инновациями и мирным, ответственным использованием. Нельзя игнорировать и влияние на человеческую психологию. Взаимодействие с машиной, имитирующей человеческую речь, может меняющееся наше восприятие социальных связей и коммуникации.

В некоторых случаях это может способствовать обучению, поддержке, развитию новых форм творчества, в других - порождать зависимости или искажения восприятия реальности. Итак, успешное прохождение ChatGPT теста Тьюринга - это не просто технологическое достижение, это знак того, что искусственный интеллект достигает новых уровней сложности и интеграции в нашу повседневность. Это одновременно вызов и возможность для человечества, требующая разумного подхода к оценке потенциала и ограничений ИИ. Дальнейшие исследования должны сфокусироваться не только на улучшении имитации и коммуникационных навыков, но и на поиске способов понять, обладает ли машина пониманием, самоосознанием и какими методами можно измерить эти качества. Возможно, в будущем нас ждёт создание новых тестов и методологий, выходящих за рамки поведенческих, направленных на глубокое изучение "внутреннего мира" искусственного разума.

В конечном итоге, ChatGPT, успешно прошедший тест Тьюринга, является поворотным моментом в истории искусственного интеллекта и науки о сознании, заставляющим переосмыслить наши понятия о интеллекте, коммуникации и природе разума в условиях стремительно меняющегося технологического ландшафта. .