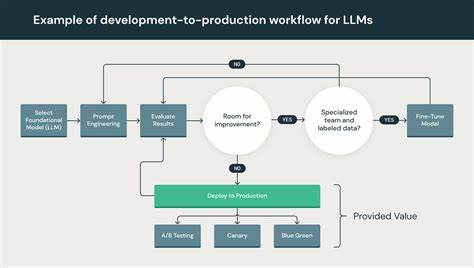

Современная экосистема больших языковых моделей (LLM) стремительно развивается, а вместе с этим растут и инструменты, облегчающие их использование в продакшене и исследовательских проектах. Одним из заметных игроков на этом поле является LangGraph, который часто упоминается как решение для создания сложных, динамических и многоагентных систем на основе LLM. Однако, если команда уже имеет опыт работы с большими языковыми моделями и даже разработала собственные пайплайны, возникает закономерный вопрос: есть ли конкретные причины переходить на LangGraph? Какие выгоды он предлагает и в чем могут быть подводные камни по сравнению с самостоятельными решениями? Попробуем детально разобраться в этом вопросе, опираясь на мнения специалистов и реальные кейсы из сообщества. LangGraph позиционируется прежде всего как платформа для управления сложными, цикличными и интерактивными рабочими процессами с участием нескольких агентов или компонентов. Если команда привыкла к линейным пайплайнам или использует LangChain — инструментарий, ориентированный на последовательное связывание запросов — LangGraph предлагает гораздо более выразительный подход к организации логики.

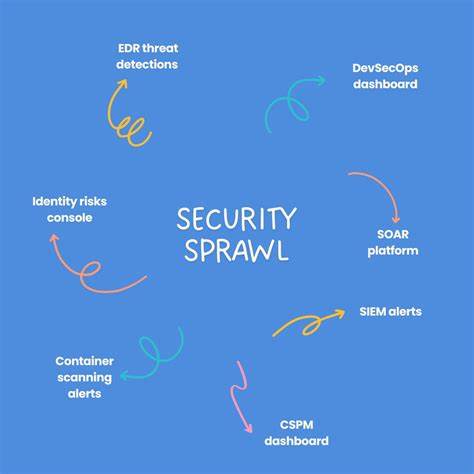

Это особенно актуально для проектов, где задачи нельзя свести к простому однонаправленному потоку данных, например, в многоагентных системах, где агенты взаимодействуют и обмениваются состояниями, строя сложные графы вычислений и принятия решений. Одним из сильных преимуществ LangGraph является встроенная поддержка масштабирования и мониторинга. Для опытных пользователей LLM, которые сталкиваются с проблемами обработки большого числа запросов и необходимости масштабировать вычисления без потери производительности, LangGraph предоставляет инструменты, упрощающие полноценное управление инфраструктурой. Интеграция с LangSmith для отладки дает возможность наблюдать за ходом выполнения заданий, отлавливать ошибки и анализировать состояние агентов в режиме реального времени. В то время как собственные пайплайны требуют разворачивания и поддержки отдельных систем логирования и мониторинга, LangGraph предлагает решение «из коробки», что экономит время и уменьшает риски ошибок.

Тем не менее, стоит отметить, что освоение LangGraph может оказаться довольно сложным. Его архитектура изначально рассчитана на решение сложных задач, поэтому новичкам и даже опытным разработчикам иногда сложно с первого раза разобраться в нюансах управления состоянием и взаимодействия между агентами. Отладка систем с большим числом циклов и состояниями в LangGraph может быть непростой — особенно если проект растет и логика усложняется. В данном контексте авторы сравнивают LangGraph с LangChain, который предпочтителен для более простых и линейных задач, а LangGraph — для сложных и динамичных проектов. Кроме того, в сообществе обсуждаются альтернативные решения.

Например, инструменты вроде AutoGen ценятся за простоту использования, но при этом они менее гибкие и точные в управлении сложными сценариями. CrewAI, иной инструмент для работы с многоагентными системами, критикуют за чрезмерную жесткость архитектуры, которая может не подходить для проектов с нестандартными требованиями. Таким образом, выбор в пользу LangGraph зачастую связан с необходимостью высокой степени кастомизации, динамического управления состояниями и готовности инвестировать время в освоение платформы. Некоторые участники обсуждений отмечают, что изначально LangChain и LangGraph появились как ответы на задачи, связанные с управлением контекстом и связкой LLM-запросов в условиях, когда сами модели не справлялись с поддержанием долгосрочной памяти. Теперь же крупные поставщики LLM внедряют внутренние решения для контекстного управления, что снижает актуальность классического «чаннинга» запросов.

Это заставляет команды всерьез задумываться о том, стоит ли усложнять архитектуру с помощью дополнительных слоев вроде LangGraph, если требования к обработке контекста уменьшаются. Тем не менее, даже при наличии усовершенствованного контекстуального менеджмента у LLM, LangGraph остается привлекательным инструментом для тех, кто строит масштабируемые и интерактивные решения в продакшене. Недорогое и быстрое прототипирование, упрощение масштабирования и готовые средства визуализации процессов выгодно выделяют платформу среди конкурентов. Это делает LangGraph особенно подходящим для больших компаний и стартапов, которые планируют запускать серьезные системы с высоким числом параллельных агенентов и сложной логикой взаимодействия. Не стоит забывать и о сообществе.

LangGraph развивается не так быстро и массово, как LangChain, но при этом обладает нишевой аудиторией, которая делится кейсами, полезными советами и расширяет функциональность. Для компаний с LLM-опытом, которые готовы вкладываться в поддержание современных инструментов, это может стать значительным плюсом в долгосрочной перспективе. В итоге, если команда уже успешно работает с языковыми моделями и имеет собственные решения, переход на LangGraph стоит рассматривать в случае, когда требуется построение сложной, динамической многоагентной системы, где важен контроль над состояниями, масштабируемость и удобство отладки. Для простых и линейных задач, наоборот, LangChain или даже собственные пайплайны зачастую остаются более логичным выбором ввиду их простоты и эффективности. Не стоит забывать и про альтернативы — например, AutoGen для быстрого прототипирования или CrewAI для более строгих сценариев.

Понимание особенностей LangGraph и его места в LLM-экосистеме поможет командам сделать осознанный выбор и выстроить архитектуру, соответствующую требованиям современных задач и позволяющую развивать проекты с оптимальными затратами времени и ресурсов. В конечном счете, LangGraph — это не просто фреймворк, а инструмент, который может серьезно упростить жизнь при создании сложных, многокомпонентных AI-решений, если команда готова инвестировать время на изучение и поддержание этой технологии.