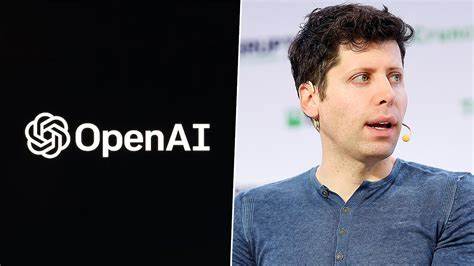

Сам Альтман покинул комиссию по безопасности OpenAI: новые горизонты для компании 16 сентября 2024 года, Лос-Анджелес — Глава компании OpenAI Сам Альтман объявил о своем уходе из внутренней комиссии, созданной для надзора за критически важными решениями в сфере безопасности, связанного с проектами и операциями компании. Это решение стало значимым шагом для OpenAI, поскольку компания все больше сосредоточена на инновациях в области искусственного интеллекта, привлекая внимание общественности и регулирующих органов. OpenAI, которая была основана с целью разработки безопасного и полезного искусственного интеллекта, создала комиссию по безопасности и охране в мае 2024 года. Основной задачей комиссии было проведение независимого анализа и оценка безопасности новых продуктов и моделей ИИ, разрабатываемых компанией. Однако теперь, после ухода Альтмана, комиссия будет преобразована в независимую группу надзора, возглавляемую профессором Карнеги-Меллон Зико Колтером.

В составе нового совета также будут такие известные личности, как генеральный директор Quora Адам Д’Анджело и бывший генерал армии США Пол Накосоне. Несмотря на уход Альтмана, комиссия продолжит свою работу и будет регулярно получать обновления от команд безопасности и охраны OpenAI. В своем сообщении компания подчеркнула, что группа сохраняет возможность задерживать релизы до тех пор, пока не будут решены вопросы безопасности. Это свидетельствует о стремлении OpenAI поддерживать высокие стандарты безопасности и прозрачности в своей деятельности. Уход Альтмана из комиссии по безопасности вызван рядом факторов, в том числе недовольством со стороны некоторых сенаторов США, которые выразили обеспокоенность по поводу политики OpenAI.

Летним письмом группа из пяти сенаторов обратилась к Альтману с просьбой разъяснить подходы компании к обеспечению безопасного и этичного использования искусственного интеллекта. Кроме того, поступила информация о том, что почти половина сотрудников OpenAI, занимающихся долгосрочными рисками ИИ, ушли из компании, что поднимает вопросы о том, как OpenAI справляется с этими вызовами в условиях растущей конкурентной среды. Критика в адрес Альтмана не ограничивается только его деятельностью в OpenAI. Ранее в этом году он также вошел в Попечительский совет Министерства внутренней безопасности США по вопросам безопасности и охраны искусственного интеллекта, что подразумевает его активное участие в разработке рекомендаций по внедрению ИИ в критическую инфраструктуру страны. В то же время OpenAI значительно увеличила свои расходы на лоббирование, планируя потратить 800 000 долларов в первой половине 2024 года — в три раза больше, чем за весь прошлый год.

Неопределенности и критики вокруг компании также усиливаются на фоне ее амбициозных планов по привлечению новых инвестиций. OpenAI, по слухам, находится на стадии сбора средств в размере более 6,5 миллиарда долларов, что позволит компании достичь оценки в более 150 миллиардов долларов. Ожидается, что для завершения этой сделки OpenAI может отказаться от своей гибридной некоммерческой структуры, что поднимает дополнительные вопросы о стремлении компании следовать своей изначальной миссии — разработке универсального искусственного интеллекта, который «приносит пользу всему человечеству». В то время как новые члены комиссии по безопасности и охране намерены продолжать работу, направленную на решение проблем безопасности, эксперты и прежние члены правления OpenAI выражают сомнения относительно того, сможет ли компания действительно придерживаться своих же стандартов самообследования. Экс-члены правления Хелен Тонер и Таша Макаули в редакционной статье для The Economist подчеркивают, что «саморегулирование не может надежно противостоять давлению стимулирования прибыли».

Тем временем OpenAI продолжает привлекать внимание к своим достижениям в области ИИ. С момента своего запуска компания продолжает разрабатывать новые модели и улучшать старые, опираясь на современные технологии и методы исследований. Продукты OpenAI, такие как ChatGPT и DALL-E, стали настоящими бестселлерами, привлекая как частных пользователей, так и бизнес-клиентов. Тем не менее, вопросы безопасности и этического использования технологий остаются на первом месте в общественном обсуждении. В условиях растущей конкурентной борьбы в индустрии искусственного интеллекта, компании имеют все большее давление не только со стороны потребителей, но и регулирующих органов.