Введение Современный мир стремительно меняется под влиянием технологий, и искусственный интеллект (ИИ) занимает все более важное место в этом процессе. Однако с увеличением применения ИИ растут и риски, связанные с его использованием. Поэтому одним из ключевых шагов по обеспечению безопасности ИИ стало введение новой рамочной программы, призванной управлять аспектами безопасности ИИ. Этот документ стал результатом работы Национального технического комитета 260 по кибербезопасности и стандартизации в Китае. Новая рамочная программа Недавно в Гуанчжоу была представлена первая версия О框架у безопасности ИИ, которая была разработана в рамках Глобальной инициативы по управлению искусственным интеллектом.

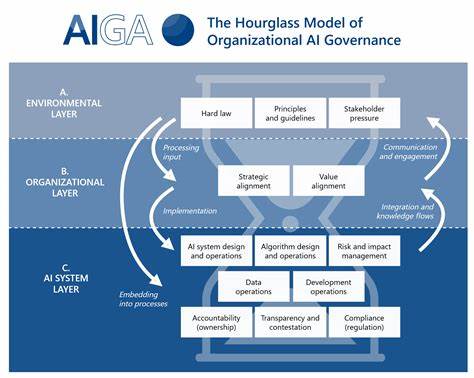

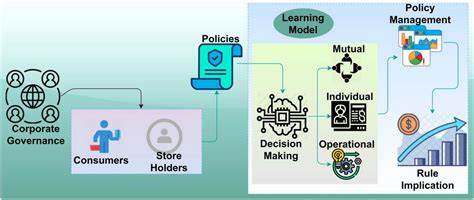

Эта программа разработана для того, чтобы обеспечить сотрудничество всех заинтересованных сторон в области безопасности ИИ и предоставить основные технические рекомендации для создания безопасной, надежной, справедливой и прозрачной экосистемы для исследований и применения ИИ. Одной из основных целей данной рамочной программы является поощрение инноваций в разработке ИИ, при этом приоритетом остается предотвращение и смягчение рисков безопасности, связанных с ИИ. Рамочная программа определяет ключевые принципы управления безопасностью ИИ, такие как инклюзивность, ориентация на риски, интеграция технологий и управления, совместные усилия и открытое сотрудничество. Анализ рисков Для успешного внедрения рамочной программы необходим анализ связанных с ИИ рисков. В рамках программы предусмотрен риск-ориентированный подход, который позволяет идентифицировать и анализировать источники рисков, связанных с данными, системами и приложениями.

Упор делается на такие области, как безопасность сетей, реальных операций и этика. Данная программа предлагает соответствующие технические ответы и превентивные меры, которые помогут обеспечить безопасное развитие и применение ИИ-технологий. Такой подход не только способствует созданию безопасной среды для разработки ИИ, но и позволяет минимизировать потенциальные угрозы. Международное сотрудничество Важным аспектом рамочной программы является содействие международному сотрудничеству в области управления безопасностью ИИ. Установление глобально признанной системы управления ИИ поможет обеспечить, чтобы технологии использовались во благо человечества и способствовали безопасному и стабильному развитию мировой экономики.

Эксперт в области кибербезопасности Лю Хуэй, вице-президент компании Topsec Technologies Group, отметил, что ИИ-технологии могут значительно повысить уровень обнаружения вредоносных и неизвестных киберугроз. Эти технологии уменьшают зависимость от человеческого фактора в операциях безопасности и улучшают качество и эффективность киберзащиты. Заключение Введение рамочной программы безопасности ИИ является важным шагом на пути к созданию более безопасной и защищенной технологической среды. Эффективное управление безопасностью ИИ требует совместных усилий всех заинтересованных сторон, включая правительство, частный сектор и научное сообщество. Только путем совместной работы можно обеспечить, чтобы ИИ развивался безопасно и этично, принося пользу всему человечеству.

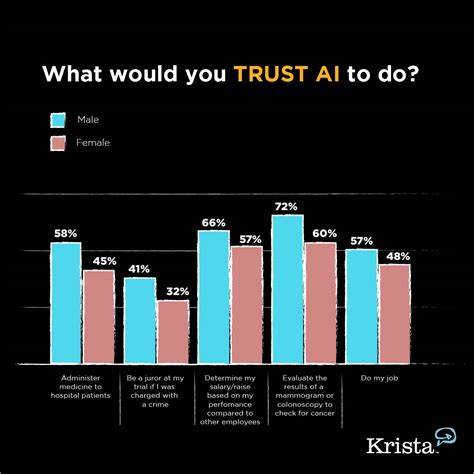

Применение ИИ в различных сферах, от здравоохранения до финансовых технологий, открывает новые горизонты для развития. Однако без должного внимания к вопросам безопасности эти возможности могут обернуться серьезными рисками. Рамочная программа безопасности ИИ закладывает основы для того, чтобы минимизировать эти риски и обеспечить успешное внедрение ИИ в нашем обществе. В заключение, можно сказать, что безопасность ИИ — это не только техническая задача, но и стратегический приоритет для всех стран, и новую рамочную программу следует рассматривать как важный шаг в глобальной гонке за безопасным и этичным развитием искусственного интеллекта.