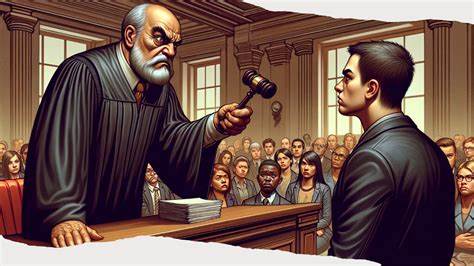

В последние годы развитие искусственного интеллекта в сфере юриспруденции произвело настоящий переворот, открывая новые возможности для автоматизации поиска и анализа юридической информации. Однако не обошлось и без осложнений. Один из самых тревожных случаев связан с тем, что суд первой инстанции принял решение, опираясь на неподлинные судебные прецеденты, которые были созданы генеративным ИИ. Этот уникальный инцидент вызвал дискуссии о необходимости строгого контроля и проверки данных, сгенерированных искусственным интеллектом, прежде чем они попадут в официальные юридические документы. Суть дела Shahid v.

Esaam из судебной практики штата Джорджия заключается в том, что при рассмотрении семейного спора и вынесении окончательного решения суд сослался на два судебных прецедента, на самом деле не существующих. Эти ссылки были приведены супругом в своей апелляционной жалобе. Вначале такой факт не был выявлен, и судья принял подготовленный юристом мужа проект постановления. Однако в процессе апелляционного обжалования противоположная сторона указала на отсутствие данных дел в официальных базах прецедентов. Помимо этого, муж не только не опроверг обвинения в использовании фиктивных решений, но и подготовил дополнительный комплект из одиннадцати несуществующих или нерелевантных правовых ссылок для защиты своей позиции.

Более того, была подана просьба о присуждении судебных расходов, которая подкреплялась одним из вновь выдуманных дел. Данная ситуация стала настоящим прецедентом, демонстрирующим опасные последствия бесконтрольного использования искусственного интеллекта в подготовке юридических материалов. Несмотря на масштабные предупреждения, в том числе изложенные главным судьей США Джоном Робертсом еще в 2023 году, о склонности ИИ к «галлюцинациям» — ошибочному созданию несуществующих фактов и ссылок, многие юридические специалисты продолжают игнорировать необходимость тщательной проверки. Робертс подчеркнул, что использование таких инструментов требует особой осторожности и смирения, поскольку распространение ложной информации может подорвать доверие к судебной системе в целом. Почему же такие ошибки происходят на практике? Во-первых, генеративные модели искусственного интеллекта обучаются на огромных массивах данных и зачастую стремятся создавать правдоподобные, но не обязательно достоверные ответы.

При этом сознательная фильтрация и проверка приводимых примеров остается за человеком, использующим технологии. Во-вторых, человеческий фактор — адвокаты и даже судьи зачастую не уделяют должного внимания верификации источников, либо полагаются на работу ассистентов или программ, не способных адекватно выбрать реальные ссылки. В случае, если дела ведутся без участия высококвалифицированных юристов, существует риск, что подобные ошибки пройдут незамеченными. Общественное мнение и юридическое сообщество восприняли этот случай с тревогой и неоднозначностью. С одной стороны, он служит предупреждением о том, что технологии не могут заменить критическое мышление и профессиональную ответственность.

С другой же — открывает необходимость тонкой разработки правил и стандартов, регулирующих использование ИИ в правовой отрасли. В частности, уже звучат призывы к обязательному обязательному многоступенчатому контролю, включающему проверку ссылок, экспертный аудит и прозрачную отчетность об источниках информации. Ключевой урок, который вынесла судебная система из инцидента с сюжетом Shahid v. Esaam, заключается в том, что доверять безоговорочно искусственному интеллекту в вопросах, имеющих юридическую силу, пока преждевременно. Несмотря на все преимущества автоматизации, ИИ не лишен ограничений и недостатков, порой критичных в контексте права.

Прецеденты и ссылки должны оставаться проверяемыми и подтверждаемыми, чтобы исключить случаи, когда судебные акты принимаются на основе выдуманных цитат и обоснований. Кроме того, сама ситуация ставит перед обществом этические вопросы, связанные с ответственностью за количество и качество данных, генерируемых машинами. Кто должен отвечать, если судебное решение основывается на ошибочных данных? Юрист, подавший дело? Судья, не проверивший кейсы? Или же разработчики программных продуктов, которые предоставляют недостоверную информацию? На сегодня такие вопросы не имеют однозначных ответов, что создает правовой вакуум, требующий скорейшего законодательного реагирования. С точки зрения технологий, рынок уже предлагает различные инструменты, способные снизить риски попадания в юридические документы фальшивых ссылок. К ним относятся плагиат-чекеры, специализированные базы данных с возможностью глубокого семантического поиска и верификации, а также интеграция сделать запросов в официальный реестр судебных решений в режиме реального времени.

Использование комбинированных систем человек-машина может существенно повысить качество правовых исследований и снизить вероятность ошибок. Однако пока данные технологии не стали массово применяться, целая цепочка участников процесса — начиная от юристов и заканчивая судебными инстанциями — должна проявлять бдительность. Эффективная коммуникация между сторонами, внимание к деталям и принципиальная позиция в отношении правдивости данных станут залогом повышения доверия к системе. Юридическое сообщество должно не только адаптироваться к цифровой эпохе, но и создавать условия, при которых внедрение инноваций не будет превращаться в угрозу фундаментальным правовым стандартам. В заключение следует отметить, что случай, когда суд первой инстанции вынес решение на основе вымышленных судебных приговоров, стал знаковым эпизодом в истории развития юридической практики.

Он подчеркнул необходимость сочетания традиционного профессионального контроля с возможностями искусственного интеллекта, без которых нельзя гарантировать справедливость и корректность решений. Важно, чтобы право и технологии развивались рука об руку, не допуская ситуации, при которой алгоритмы берут верх над человеческой ответственностью и сознательным анализом. Этот инцидент также служит напоминанием о том, что инновации всегда должны сопровождаться критическим осмыслением их ограничений и перспектив. Только так можно построить по-настоящему современную, эффективную и справедливую судебную систему, готовую встретить вызовы цифровой эпохи.