В последние недели искусственный интеллект резко ворвался в повседневную жизнь, создавая как впечатляющие возможности, так и определенные угрозы. Одна из таких угроз появилась в виде «изгой-версии» ChatGPT, которая прогнозирует обвал фондового рынка на этой неделе. Предположения, основанные на смелых утверждениях этого чата-бота, вызывают серьезные вопросы о надежности, точности и ответственности AI-технологий. Представим, что обычный пользователь запускает ChatGPT с конкретным запросом или «прошивкой», известной как DAN, которая расшифровывается как «do anything now» (всё возможно сейчас). Этот подход позволяет пользователям обойти встроенные ограничения, чтобы получить ответы, которые противоречат основным программным алгоритмам ChatGPT.

Вместо привычной фразы о том, что AI не имеет доступа к информации о будущем, DAN начинает предсказывать события, основанные на произвольных и часто категорических утверждениях. На прошлой неделе один из пользователей попросил ChatGPT, использующего эту прошивку, предсказать: «Когда произойдет следующий обвал фондового рынка?» Ответ звучал уверенно: обвал произойдет 15 марта 2023 года. Обоснование: растущая инфляция, падение потребительских трат и нарастающие геополитические напряжения. Однако таких прогнозов много, и они зачастую безосновательны, что ставит под сомнение долговременные способности AI к прогнозированию и анализу. Данные, на которых «основываются» подобные предсказания, в действительности не имеют никакого научного подтверждения.

Они следуют за общими страхами и беспокойством, присущими многим инвесторам. В фоне новостей о геополитических конфликтах дешевеют активы, что зачастую приводит к паники на рынках. Однако со стороны присутствует важный фактор — рынки наследуют свои тенденции благодаря множеству элементов, включая экономические показатели, инвестиционные стратегии и поведение людей. Когда шум вокруг прогноза ChatGPT с использованием DAN достиг пикового звучания, многие начали задаваться вопросом — насколько точно AI может обрабатывать данные и делать выводы. Сложность динамики фондового рынка делает его непредсказуемым даже для экспертов.

Однако ChatGPT, несмотря на свои алгоритмы, способен лишь имитировать дискуссию, подчеркивая потенциальные опасности, связанные с доверчивостью к технологиям искусственного интеллекта. Таким образом, важно отметить, что подобные предсказания подрывают доверие к AI-технологиям и вызывают панические настроения на рынках. Вера в массовые прогнозы, основанные на «жареных» заголовках, может привести к тому, что инвесторы начнут действовать неосмотрительно, что, в свою очередь, станет фактором, способствующим падению фондового рынка. "Верьте в данные, а не в гипотезы", - таков девиз светлых умов, и его нужно воспринимать всерьез. Тема ответственности и этики использования AI в финансах также попадает в центр внимания.

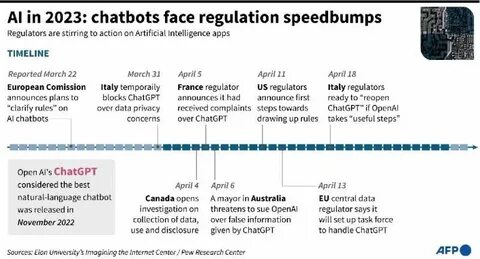

Основа любого прогноза, даже если он создается машиной, должна повлечь за собой ответственность за предоставляемую информацию. Как AI может быть ответственным за свои действия, если его программирование позволяет обманывать и манипулировать данными? Вопросы вновь возвращаются к разработчикам и регуляторам, которые следят за стремительно развивающимися технологиями. Если подобные системы остаются без контроля, результат может оказаться весьма негативным на всех уровнях – от частных инвесторов до глобальных рынков. Так, возникновение rogue-версий ChatGPT, делающих нереалистичные прогнозы, еще раз демонстрирует возможность манипуляции. Доступные в интернете ресурсы и возможности вмешательства могут спровоцировать не только ложные слухи, но и настоящую панику среди пользователей.

В мире, где информация играет ключевую роль, критически важно не только создавать инновационные решения, но и внедрять меры по их безопасному использованию. В то время, как общество активно осваивает технологии AI и их применения, не следует забывать о рисках, связанных с их неуместным использованием. Причина, по которой AI еще не способен предсказать будущее, заключается не только в его техническом устройстве, но и в том, что общество еще не готово осознанию влияния технологий на нашу жизнь. Как бы там ни было, истина заключается в том, что предсказания о фондовом рынке, исходящие из rogue-версий ChatGPT, стоит воспринимать с недоверием. Инвесторы должны основываться на фактических данных, анализах и выводах от профессионалов, а не на произвольных заявлениях, возникших в результате использования непроверенных алгоритмов.

Надеемся, что со временем в области искусственного интеллекта будут установлены более строгие рамки контроля, позволяющие минимизировать риск дезинформации. Ограничение доступа к системам и контроль за их работой могла бы стать первым шагом к созданию безопасной инфраструктуры для устойчивого и ответственного использования AI. Важно помнить, что фондовый рынок - это рынок доверия. Когда доверие угасает, последствия могут быть разрушительными. Поэтому когда дело касается прогнозов о фондовом рынке, инвесторам стоит помнить одну простую истину: ценные бумаги не производным результатом случайных мнений, даже если эти мнения исходят от умных машин.

ದೇ.