В последние годы искусственный интеллект (ИИ) стал одной из самых обсуждаемых тем в технологиях, привлекая внимание как специалистов, так и широкой публики. Компании из разных секторов активно внедряют ИИ, обещая революционные изменения в продуктах и услугах. Несмотря на это, реальность разработки и внедрения ИИ-продуктов далеко не всегда совпадает с ожиданиями. Пример Apple Intelligence ярко иллюстрирует основные вызовы, с которыми сталкиваются разработчики в эпоху больших языковых моделей и генеративного ИИ, и раскрывает феномен, известный как AI 80/20. Понимание этого феномена критически важно для всех, кто работает с ИИ, будь то крупные корпорации или стартапы, поскольку именно он определяет границы возможностей современных ИИ-продуктов и объясняет многочисленные неудачи в отрасли.

Современные технологии искусственного интеллекта, особенно большие языковые модели (LLM), способны демонстрировать впечатляющие результаты на уровне прототипов. Эти системы умеют генерировать связный и при этом контекстуально релевантный текст, отвечать на сложные вопросы и выполнять творческие задачи, которые раньше считались прерогативой человека. На фоне этого возникает иллюзия, что для конечного продукта осталось совсем немного — необходимо лишь доработать интерфейс, улучшить производительность и устранить мелкие баги. Однако практика показывает, что именно этот «оставшийся небольшой кусочек работы» на деле оказывается наиболее сложным и ресурсозатратным. Проект Apple Intelligence, в частности обновление голосового помощника Siri с персонализированной поддержкой контекста, стал своеобразным символом проблемы AI 80/20.

В 2024 году компания объявила о новых функциях, включая возможность Siri распознавать запросы с учетом персональной информации, например: когда прибывает рейс мамы. Несмотря на громкие анонсы и привлекательные демонстрации, реальный запуск и внедрение этих функций столкнулись с серьезными проблемами. Многие из обещанных усовершенствований так и не появились в финальной версии, что вызвало волну критики и разочарования у пользователей. Почему же произошел такой разрыв между демонстрацией и реальной жизнью продукта? Как объясняет эксперт Дейв Фельдман, ключ к пониманию кроется в изменении классической парадигмы «прототипа» и «финишного продукта». В традиционном программировании прототип или доказательство концепции занимают примерно 20% усилий и дают 80% уверенности, что проект будет успешен.

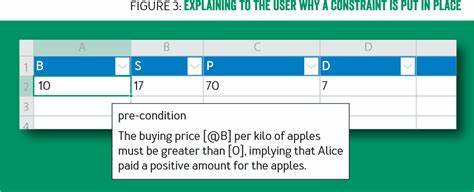

С ИИ все наоборот: первые 20% усилий дают парадоксальные 80% визуального или демонстрационного эффекта, который воспринимается как почти готовый продукт, но оставшиеся 80% работы требуют непропорционально больших затрат времени, ресурсов и инженерного мастерства. Это связано с внутренней природой больших языковых моделей. Они работают по вероятностным алгоритмам, генерируя ответы на основе статистических паттернов в обучающих данных. Их предсказания не всегда детерминированы, а значит система может «галлюцинировать» — выдавать неправдивую или некорректную информацию. В прототипах такие ошибки не видны или списываются на исключения, а на этапе реального использования, особенно среди тысяч и миллионов пользователей, такие недостатки становятся явными.

Именно это и приводит к краху многих оммажируемых в начале проектов. Похожая ситуация была замечена и у других крупных игроков, что свидетельствует о системной природе проблемы. Так, Figma, платформенный инструмент для дизайна, тестировала функцию генерации макетов интерфейсов на основе текстовых запросов, но столкнулась с ситуацией, когда ИИ копировал уже существующие продукты, что противоречило ожиданиям пользователей и этическим нормам. Google с генератором изображений Gemini подверглась критике за неспособность корректно учитывать контекст и исторические реалии, что в итоге порождало спорные и недостоверные визуальные интерпретации. А финтех-компания Klarna, сделав ставку на поддержку клиентов через чатботов с ИИ, была вынуждена отменить эту инициативу из-за ухудшения качества сервиса и увеличенного числа жалоб.

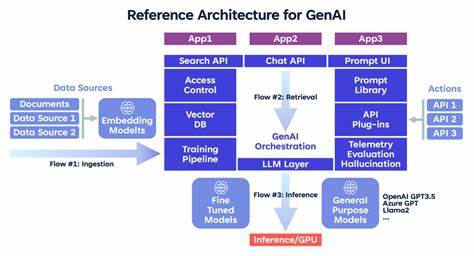

Все эти примеры подчеркивают, что технологический прогресс и маркетинговый хайп не всегда отражают истинную готовность продукта к реальным задачам и высокому трафику. Ключевая причина — непреодолимые пока ограничения модели, которые касаются не только технических аспектов, но и таких граней, как UX, безопасность, устойчивость к манипуляциям и соответствие этическим стандартам. Чтобы успешно реализовать потенциал ИИ и преодолеть проблему AI 80/20, необходим четкий и приземленный подход к разработке. Важно признать текущие ограничения языковых моделей и сфокусироваться на создании продуктов, которые преимущественно используют сильные стороны алгоритмов, при этом минимизируя уязвимости. Речь идет не о поиске сверхгениального решения или о слепом доверии к ИИ, а о разумном смешивании традиционных программных техник с возможностями машинного обучения.

К примеру, практики, называемые «структурированный вывод», «вызов функций» и «гибридные пайплайны», позволяют контролировать и направлять работу ИИ, частично обезопасить от галлюцинаций и корректно интегрировать AI-механизмы в продуктовую логику. Тестирование ИИ-решений требует новых методик, которые учитывают изменчивость и непредсказуемость ответов. Одновременно важна готовность отказаться от идей, которые при нынешнем уровне технологий не могут быть реализованы без серьезных компромиссов. Обсуждение и обмен опытом среди специалистов играют ключевую роль в эволюции понимания и создания успешных AI-продуктов. Однако массовое внимание часто затмевают громкие обещания и инфоповоды о мистической «сверхинтеллектуальности».

Это создает разрыв между реальными рабочими процессами и восприятием широкой аудитории, что затрудняет формирование адекватных ожиданий и поддерживает у пользователей усталость от часто нестабильных и ошибочных продуктов. Решение проблемы AI 80/20 означает продвижение в области культуры разработки ИИ — от маркетинговых лозунгов к глубокой технической честности и прагматизму. Лишь так можно обеспечить не только впечатляющие демо, но и устойчивые в реальном мире сервисы, способные выдержать испытание масштабом и разнообразием пользовательских сценариев. Итогом этой трансформации станет появление более зрелых, надежных и полезных ИИ-решений, которые будут действительно улучшать жизнь пользователей, а не становиться источником разочарований и скепсиса. Apple Intelligence и другие крупные примеры показывают, что современный ИИ не является магическим решением.

Это сложная технология, которая требует от нас не только технической изобретательности, но и глубокого уважения к ее ограничениям и ответственности за конечный продукт. Понимание и признание феномена AI 80/20 поможет разработчикам и компаниям найти баланс между инновациями и реализмом, что в конечном итоге приведет к созданию действительно эффективных и востребованных продуктов. Только так на основе искусственного интеллекта можно построить устойчивую экосистему, в которой работа ИИ будет приносить реальную пользу без дорогостоящих провалов и потери доверия со стороны пользователей.