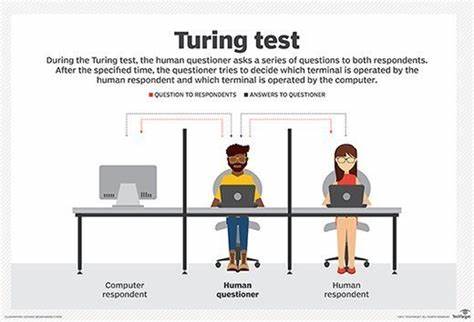

Тест Тьюринга: что это, кто может его пройти и какие у него ограничения В мире технологий, где искусственный интеллект (ИИ) становится все более обыденным, Тест Тьюринга занимает центральное место в дискуссиях о том, что значит быть «умным». Созданный в 1950 году британским ученым Аланом Тюрингом, этот тест служит измерением способности машины демонстрировать человеческие черты поведения. Но что же представляет собой этот тест, кто способен его пройти и каковы его ограничения? Давайте разберемся в этих вопросах. Тест Тьюринга основан на простой концепции. Он состоит в том, что судья (человек) взаимодействует одновременно с двумя собеседниками: одним из них является человек, а другим — машина.

Судья задает вопросы, а обе стороны отвечают текстом. Если после общения судья не может однозначно определить, кто из собеседников является человеком, а кто — машиной, то считается, что машина прошла тест. Он был разработан как способ ответить на философский вопрос: может ли машина думать? Тюринг предложил, что вместо того чтобы заниматься дебатами о сущности мысли, проще провести эксперимент, который бы проверял, может ли машина имитировать человеческое поведение. Таким образом, основной акцент Тест Тьюринга делает не на реальном понимании или сознании, а на способности эффективно взаимодействовать в диалоговом режиме. С тех пор, как был предложен Тест Тьюринга, мы стали свидетелями значительных успехов в области технологий и искусственного интеллекта.

В последние годы такие AI-системы, как чат-боты и виртуальные помощники, прокладывают дорогу к внедрению AI в повседневную жизнь. В 2014 году программа под названием Eugene Goostman, созданная украинскими разработчиками, обратила на себя всеобщее внимание, заявив о том, что смогла пройти ту самую проверку на «человечность». Однако эксперты вскоре начали ставить под сомнение реальные достижения программы, указывая на множество упущений и недочетов. Некоторые AI-системы, такие как GPT-3 и другие языковые модели, уже демонстрируют выдающиеся результаты в генерации текста и понимания языка, что открывает новые горизонты для тестирования на основе Тьюринга. Но можно ли считать, что машины, проходя Тест Тьюринга, действительно «думают»? Или это просто искусная имитация? Основная проблема заключается в том, что Тест Тьюринга не является окончательным показателем интеллектуальных возможностей.

Он не рассматривает аспекты понимания и осознания, которые являются синонимами человеческого мышления. Даже если машина может имитировать человеческие ответы с высокой степенью успеха, она не обладает истинным сознанием. Искусственный интеллект основан на алгоритмах и обработке данных, а не на эмоциональном или когнитивном понимании. Еще одним ограничением Теста Тьюринга является влияние контекста. Машины могут использовать заранее запрограммированные ответы или хорошо подобранные фразы, чтобы сбить с толку судей, однако это не отражает их способности к самостоятельному мышлению или пониманию.

Не всякий «умный» AI может пройти тест — важно, как именно он строит свои ответы и насколько они разнообразны. Интересно, что Тест Тьюринга также встречает критику со стороны экспертов. Например, философ Джон Сёрл разработал так называемый «китайский комната» аргумент, который утверждает, что даже если машина может пройти тест, это не говорит о ее понимании. Он описывает сценарий, в котором человек, находясь в комнате, обрабатывает символы китайского языка, следуя строгим правилам. Человек не понимает китайский, но может имитировать его на уровне, достаточном для взаимодействия — что делает его не способным к пониманию, несмотря на успешное выполнение задач.

Этот аргумент бросает вызов соответствию между имитацией и истинным мышлением. С другой стороны, Тест Тьюринга продолжает оставаться важным инструментом для оценки прогресса в области ИИ. Он служит основой для обсуждения искусственного интеллекта и предоставляет простую структуру для оценивания поведения машин. Несмотря на ограничения, он поднимает важные вопросы о будущем технологий и их взаимодействии с человечеством. С учетом всех вышеупомянутых факторов, ясно, что участие в тесте не гарантирует наличие разума или сознания у машины.

Это просто подтверждение способности к определенным формам общения и взаимодействия. Однако, как мы продолжаем развивать технологии, возникает необходимость в более сложных способах оценки ИИ. Сегодня мы наблюдаем рост интереса к концепциям, которые выходят за рамки Теста Тьюринга. Исследователи стремятся создать более многогранные подходы к оценке интеллекта, включая возможность применения эмоционального интеллекта и способности к пониманию контекста. Эти аспекты важно учитывать при разработке будущих ИИ-систем.

Совсем недавно, в 2023 году, различные институции начали предлагать альтернативные тесты, основанные на сложных сценариях взаимодействия, которые могут дать больше информации об истинных возможностях искусственного интеллекта. Исследуются и практические применения, которые могли бы продемонстрировать, что ИИ способен не только к имитации, но и к реальному пониманию. Пока Тест Тьюринга остается важной вехой в мире науки, не стоит забывать о его ограничениях. Понимание способности машин и их потенциального сознания требует более глубокого анализа и новых моделей оценки. Искусственный интеллект, безусловно, продолжает развиваться, и нам важно быть готовы к этому пути, принимая во внимание философские и этические аспекты, которые будут определять наше взаимодействие с новыми технологиями.

В заключение, Тест Тьюринга остается значимым стандартом для оценки ИИ, но не забудьте, что это всего лишь один из многих инструментов в арсенале исследователей. Настоящее будущее технологий может полон неожиданных открытий и изменений, которые изменят наше понимание как ИИ, так и самих себя.