Искусственный интеллект (ИИ) стал неотъемлемой частью нашей повседневной жизни. От умных технологий в наших домах до алгоритмов, которые формируют наши новостные ленты, влияние ИИ растет с каждой минутой. Однако вместе с этим увеличивается и беспокойство по поводу конфиденциальности. В данной статье мы обсудим проблемы, связанные с конфиденциальностью, возникающие в результате использования ИИ, а также его потенциальное влияние на личные данные. Первое, что стоит отметить, это то, что технологии ИИ требуют больших объемов данных для обучения и функционирования.

Большие данные (Big Data) – это именно то, что движет ИИ. Однако, чем больше данных собирается, тем выше риск утечек и неправомерного использования личной информации. Многие компании собирают данные без явного согласия пользователей или недостаточно информируют их о том, как именно будет использоваться их информация. Нарушение конфиденциальности также может происходить из-за неправомерного доступа к данным. Хакеры часто нацеливаются на компании, обладающие большими объемами информации о клиентах.

В 2021 году в результате крупнейшей утечки данных были скомпрометированы миллионы учетных записей пользователей. Такого рода инциденты усугубляют общественное беспокойство. Пользователи начинают задаваться вопросами: как долго хранятся мои данные? Кто имеет доступ к этой информации? И, что самое важное, насколько безопасно ее хранение? Однако конфиденциальность не является единственной проблемой. Этические вопросы тоже занимают важное место в обсуждении ИИ и его воздействия на общество. Например, алгоритмы ИИ могут быть предвзятыми и дискриминирующими.

Если данные, на которых обучается модель, содержат предвзятости (например, расовые или половые), то и результаты, которые она генерирует, могут отражать эти предвзятости. Это может привести к неравному обращению с различными группами населения – например, в сфере трудоустройства или кредитования. Одна из ярких иллюстраций такого сценария – это использование алгоритмов в системах правосудия. В некоторых странах ИИ используется для оценки риска рецидива осужденных. Однако если алгоритм основан на ненадежных данных, это может привести к тому, что невиновные люди окажутся под угрозой.

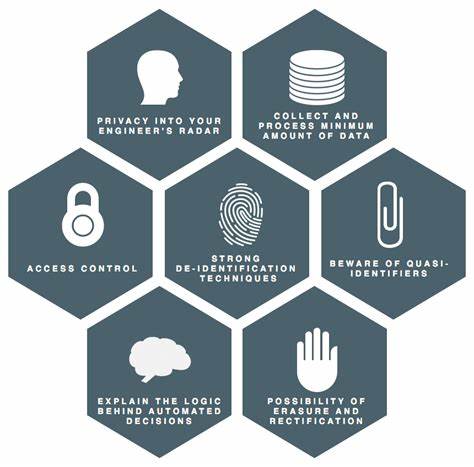

Этические последствия использования таких технологи требуют серьезного обсуждения и регулирования. Справедливость и прозрачность алгоритмов должны стать приоритетами в разработке новых систем на основе ИИ. Важным шагом на этом пути является внедрение принципов ответственного использования ИИ и создание четких регуляторных рамок, защищающих персональные данные. Существующие законы о защите данных, такие как Общий регламент о защите данных (GDPR) в Европейском Союзе, предоставляют определенные права пользователям, такие как право на доступ к своим данным и право на их удаление. Однако эти законы необходимо адаптировать к меняющимся технологиям и повышению уровня угроз.

Большие компании в области технологий должны взять на себя ответственность за разработку более защищенных и проверяемых методов обработки данных. Важным шагом в обеспечении конфиденциальности является также улучшение осведомленности пользователей о том, какие данные собираются. Компании должны предоставлять более четкую информацию о том, как они используют данные, а также позволять пользователям управлять своими настройками конфиденциальности. Кроме того, пользователи должны быть более осторожными при взаимодействии с сервисами, основанными на ИИ. Регулярная проверка настроек конфиденциальности и внимательное изучение условий использования может помочь избежать ряда угроз.

Пользователи должны понимать, какие данные они предоставляют, и какой именно риску подвергаются в результате этого. В заключение, искусственный интеллект предоставляет множество возможностей, но также порождает значительные угрозы для конфиденциальности и защиты персональных данных. Эффективное регулирование, ответственный подход к разработке технологий и информированность пользователей — ключевые аспекты, которые должны быть в центре обсуждения, чтобы максимально защитить людей от возможных рисков. Искусственный интеллект может служить на благо общества только в том случае, если мы научимся грамотно управлять им и регулировать его использование.