Современный мир стремительно меняется благодаря развитию технологий искусственного интеллекта. Одним из наиболее обсуждаемых направлений стали ИИ-агенты — автономные системы, способные выполнять сложные задачи без вмешательства человека. Однако с ростом числа и возможностей этих агентов возникает и целый ряд неопределенностей, которые объединены в понятие «хаос ИИ-агентов». В этой статье мы рассмотрим, что же стоит за этим понятием, почему развитие ИИ-агентов вызывает столько вопросов и каковы возможные последствия и вызовы, с которыми столкнется общество в ближайшие годы. ИИ-агенты представляют собой программные или аппаратные системы, которые способны принимать решения, учиться, адаптироваться и взаимодействовать не только с людьми, но и между собой.

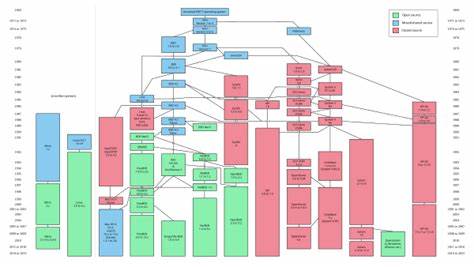

Именно межагентское взаимодействие и становится центральным элементом современного контекста развития искусственного интеллекта. Видеоролик «The Chaos of AI Agents» наглядно демонстрирует, как быстро увеличение количества и сложности таких систем приводит к появлению непредсказуемых ситуаций, которые могут превратиться в настоящий хаос. Одним из ключевых факторов развития хаоса является то, что агенты зачастую обладают собственными целями или алгоритмами, которые могут конфликтовать как с целями людей, так и друг с другом. Например, в сложных финансовых системах автономные торговые боты уже сегодня способны влиять на рыночную динамику, порождая нестабильность и неожиданные кризисы. С ростом числа таких агентов риски только увеличиваются.

Еще одной проблемой становится масштабируемость и управление системами, где задействованы тысячи и даже миллионы ИИ-агентов. Как обеспечить координацию, чтобы предотвратить катастрофы или сбои? В случае отсутствия централизованного контроля или эффективных протоколов, агенты могут начать действовать деструктивно и непредсказуемо, что порождает хаос. Видеоматериал показывает разные подходы к моделированию и исследованию поведения ИИ-агентов в условиях сложных систем с множественными взаимодействиями и конфликтами. Один из методов — создание специальных алгоритмов с саморегулируемыми параметрами, которые пытаются минимизировать конфликты и подкорректировать действия каждого агента. Несмотря на это, процесс остается чрезвычайно сложным и требует постоянных научных усилий.

С точки зрения этики и безопасности, рост автономных ИИ-систем поднимает множество новых вопросов. Как обеспечить, чтобы агенты принимали решения, соответствующие моральным и правовым нормам? Кто несет ответственность за последствия действий ИИ? В условиях хаоса ситуацию осложняет то, что агенты могут непредсказуемо отклоняться от запрограммированных сценариев или обретать новые способы взаимодействия, что делает контроль со стороны человека затруднительным. В то же время, ИИ-агенты открывают огромные возможности для инноваций в самых разных сферах — от медицины и логистики до образования и творчества. Автономные системы способны обрабатывать большие объемы данных, быстро принимать решения и выполнять задачи с высокой точностью. Способность агентов взаимодействовать между собой может привести к созданию систем, превосходящих человеческие возможности в анализе и управлении сложными процессами.

Проблема хаоса ИИ-агентов заставляет ученых и разработчиков искать новые модели взаимодействия и контроля, в том числе открытые протоколы сотрудничества, прозрачные алгоритмы принятия решений и встроенные механизмы безопасности. Одним из ключевых направлений является разработка принципов согласованности и взаимопонимания между агентами на основе общих правил, что поможет стабилизировать и упорядочить работу сложных систем. Большое внимание уделяется вопросам обучения ИИ-агентов на основе разнообразных данных и сценариев для предотвращения ошибочного или небезопасного поведения. Применение методов машинного обучения с обратной связью позволяет адаптировать алгоритмы и уменьшать вероятность возникновения конфликтов. Также исследуется возможность встраивания «этических слоев», которые будут контролировать соответствие действий агентов установленным нормам.

В ближайшие годы развитие ИИ-агентов будет интенсивно интегрироваться в повседневную жизнь, что потребует от общества принятия новых правил и стандартизированных подходов к взаимодействию с такими системами. Нужно будет учитывать проблемы приватности, ответственности, а также создавать механизмы регулирования и мониторинга работы автономных агентов. Только при грамотном подходе можно будет воспользоваться всеми преимуществами ИИ, минимизируя риски хаоса. В итоге, хаос ИИ-агентов — это далеко не просто гипотетическая угроза, а актуальная задача современной науки и технологии. Правильное понимание особенностей таких систем, подготовка к их взаимодействию и формирование международных стандартов управления станут залогом безопасного и продуктивного будущего.

Использование потенциала ИИ-агентов может преобразить многие сферы человеческой деятельности, однако требует комплексного и осознанного подхода. В условиях постоянного роста автономности ИИ становится очевидно, что только совместные усилия исследователей, разработчиков, законодателей и общества помогут превратить хаос в упорядоченную и полезную систему, укрепляющую технологический прогресс и улучшая качество жизни.

![The Chaos of AI Agents [video]](/images/EB0FACDB-061E-49B4-9E7B-1B7776FB4F6D)