Искусственный интеллект (ИИ) стремительно меняет наш мир, внедряясь во все сферы жизни — от медицины и образования до производства и развлечений. Однако в последние годы становится очевидным, что технологии ИИ также оказывают значительное влияние на демократические процессы в разных странах. Использование ИИ для генерации поддельного контента, манипуляций на выборах и распространения дезинформации постепенно подрывает доверие к принципам демократии и ставит под угрозу политическую стабильность во многих странах мира. Сегодня сложно игнорировать тот факт, что искусственный интеллект становится не только мощным инструментом для прогресса, но и средством дестабилизации демократических институтов.По всему миру отмечаются случаи вмешательства в выборы посредством АИ-сгенерированного фальшивого контента, который поражает своей реалистичностью и распространением.

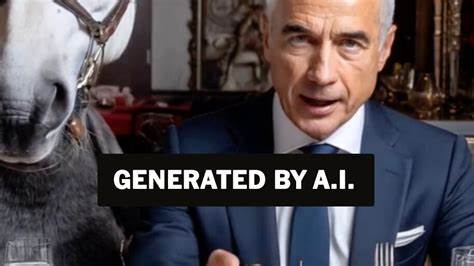

Подделанные фотографии и видеозаписи известных политиков и кандидатов в предвыборных кампаниях растут в геометрической прогрессии, создавая ложное восприятие и дезориентируя избирателей. Так, перед выборами в Канаде в 2024 году появилась фальшивая фотография кандидата в премьер-министры Марка Карни с одним из самых спорных финансовых деятелей в истории — Джеффри Эпшайном. Подобные случаи происходят и в других странах, например, в Польше и Румынии, где применялись поддельные новости и видео, вызывая серьезные политические кризисы и даже отмену результатов голосований.Технологическая доступность и простота использования программ, генерирующих контент при помощи ИИ, значительно увеличили масштабы распространения фейковых новостей. Эти инструменты позволяют создавать глубокие подделки (deepfakes) — видео и аудио, в которых на самом деле может говорить и действовать кто угодно, что резко уменьшает возможности для контроля и верификации информации.

Нарушители могут в течение считанных минут запустить мощную кампанию по манипулированию общественным мнением, в отличие от прежних времен, когда для подобных действий требовались массивные усилия и ресурсы. В результате социальные и партийные разногласия лишь усиливаются, а доверие к избирательным процессам существенно падает.Особую тревогу вызывает использование ИИ в интересах автократических режимов, стремящихся оказывать влияние на выборы за рубежом. Россия, Китай, Иран — эти страны применяют ИИ для создания ложного контента, направленного на дискредитацию демократических процессов или поддержку политиков, лояльных их интересам. Именно они создают вирусные фейковые видео, подделки и фальшивые новости, которые распространяются на популярных в мире социальных платформах и вызывают напряжение в обществах.

Такой подход позволяет дестабилизировать политическую ситуацию, сеять вражду между различными группами населения и подрывать легитимность власти.Сложность борьбы с этим явлением усугубляется тем, что социальные сети, крупнейшие медиаплатформы и технологические гиганты оказываются в центре противоречий. С одной стороны, они принимают меры против неправдивого контента и обещают бороться с его распространением, внедряют системы пометки и проверки источников информации. С другой стороны, алгоритмы соцсетей часто делают акцент на вовлечённости пользователей и максимизации времени, проведённого на платформе, что на деле способствует распространению сенсационного, зачастую ложного контента. Это создает замкнутый круг, где борьба с дезинформацией оказывается лишь частичной и малоэффективной.

Кроме прямого генерирования поддельных видеороликов и аудио, ИИ используется для создания масштабных вбросов ложной информации с помощью автоматизированных ботов и фальшивых аккаунтов. Исследования показывают, что множество таких аккаунтов, созданных при помощи ИИ, способны обходить современные методы обнаружения и модерации в социальных сетях. Таким образом, влияние фальшивых новостей и спровоцированных ими конфликтов может появляться там, где аудитория даже не подозревает о масштабе и искусственности кампаний.Влияние ИИ на демократию становится особенно болезненным в новых и развивающихся демократиях, где институциональная устойчивость еще недостаточно сильна. Так в Румынии в 2024 году через применение ИИ были сгенерированы манипулированные видео и аккаунты, которые серьезно исказили ход президентских выборов и вынудили суд аннулировать первый тур голосования.

Подобные события подрывают доверие граждан к процессу выборов, и это может привести к политической апатии или радикализации общества.В то же время нельзя забывать и о положительных сторонах использования искусственного интеллекта в избирательных кампаниях. Многие политики и партии применяют ИИ для улучшения коммуникации с избирателями: переводят речи на местные диалекты, анализируют предпочтения различных электоральных групп, персонализируют обращения. В некоторых случаях ИИ помогает повысить информированность населения и обеспечить более тесное взаимодействие политиков с гражданами. Однако эти возможности остаются в тени масштабного негативного влияния технологии, которое требует пристального внимания и регулирования.

Мировое сообщество сталкивается с необходимостью формирования новых подходов к борьбе с вызовами, связанными с ИИ в политике. Требуются международные рамочные соглашения, усилия для повышения медийной грамотности населения, совершенствование технологий обнаружения поддельного контента, а также повышение ответственности социальных платформ. Без комплексного подхода демократические процессы будут становиться все более уязвимыми перед лицом быстрого развития цифровых технологий.Эксперты предупреждают, что возможности, создаваемые искусственным интеллектом, будут лишь расти, а методы манипуляций — становиться все более изощренными. Публичное доверие к институтам власти и медиа продолжит снижаться, если не будут предприняты эффективные меры для борьбы с этим явлением.