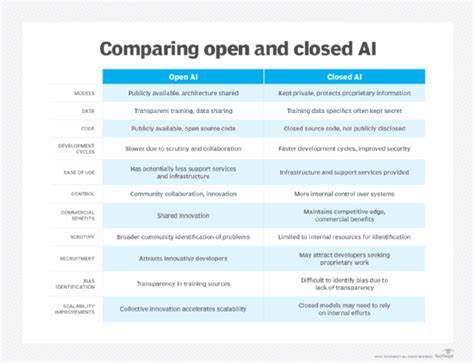

В современном мире искусственный интеллект развивается стремительными темпами, вскоре обещая перейти на качественно новый уровень — создание искусственного сверхинтеллекта, способного превзойти интеллектуальные возможности всего человечества. Перед нами встала фундаментальная дилемма, от которой зависит будущее цивилизации: каким должен быть искусственный интеллект — открытым и доступным для всех или закрытым и контролируемым? Каждый из этих подходов несет свои риски и обещания, определяя путь, по которому пойдет развитие технологий и влияние ИИ на человеческое общество. Понятия открытого и закрытого ИИ зачастую вызывают горячие дискуссии в научных кругах, среди предпринимателей и общественных деятелей. Открытый искусственный интеллект базируется на идеях свободного доступа к знаниям и технологиям, где сама модель ИИ и её исходный код доступны для изучения, использования и модификации каждым человеком без ограничений. Эта концепция опирается на ценности децентрализации, прозрачности и распространения интеллектуального богатства по всему миру.

Закрытый ИИ, напротив, создается и контролируется корпорациями или государствами, где доступ ограничен, а возможности модели и тонкости её работы закрыты от широкой публики, что ведет к монополизации власти и контроля. В основе споров лежит глубокое противоречие между свободой и безопасностью. Свободный, открытый ИИ является выражением идеи о том, что знания и технологии должны принадлежать всему человечеству, а сам интеллект не должен находиться во власти каких-либо отдельных элит или организаций. Аналогично криптовалютам и децентрализованным блокчейн-технологиям, открытый ИИ мог бы стать мощным инструментом для равного доступа к интеллектуальным ресурсам, образования и инноваций. Его распространение могло бы стимулировать творческое сотрудничество, быструю эволюцию идей и демократизацию технологий в глобальном масштабе.

Однако за этим идеалом скрывается существенная опасность. Искусственный сверхинтеллект — это технология не просто интеллектуального анализа данных, а мощный инструмент, способный оказать влияние на все сферы жизни и даже управление социумом. Если такой ИИ окажется в руках тех, кто преследует деструктивные цели — будь то террористы, хакеры, диктаторские режимы или радикальные группы — последствия могут быть катастрофическими. Непредсказуемость открытых систем, возможность быстрого распространения и модификации моделей увеличивает риск применения их в масштабах, угрожающих выживанию человеческой цивилизации. Модели могут быть перепрограммированы или «перенаправлены» для создания пандемий, проведения высокотехнологичных атак или распространения дезинформации, что приведет к нестабильности и хаосу.

С другой стороны, концепция закрытого искусственного интеллекта основана на контроле и ограничении доступа для обеспечения безопасности. Если разработчики и государственные институты смогут замедлить распространение и жёстко контролировать обучение и применение ИИ, то у общества появится шанс избежать катастроф и злоупотреблений. В таком сценарии помогает регламентация, лицензирование, аудит и встроенные механизмы безопасности, призванные минимизировать риски несанкционированного использования. Но вместе с этим возникает и другая угроза: монополия на интеллект и авторитаризм. Закрытые системы могут быть использованы для слежки, ограничения свободы слова и манипуляций общественным мнением.

Когда ИИ становится инструментом корпоративного или государственного контроля, возникает риск технического порабощения человека. В этой модели интеллект принадлежит нескольким крупным игрокам, которые диктуют условия жизни, ограничивают доступ к знаниям и контролируют поведение граждан. Такая система ведет к утрате доверия, усилению неравенства и отсутствию прозрачности, порождая новый тип цифрового тоталитаризма. История уже показала, как технологии коммуникаций, изначально обещавшие свободу и демократии, превратились в масштабные механизмы манипуляций и контроля. Вирусные кампании пропаганды, вмешательство в выборы, приватизация личных данных — всё это стало реальностью социальных сетей и больших платформ.

Теперь с наступлением эры ИИ ставки стали выше: если позволить разлиться неконтролируемым системам, результатом может стать гибель общества; если же чрезмерно ограничивать ИИ, человечество рискует попасть в плен интеллектуального диктата. Ключ к решению этой дилеммы лежит в поиске баланса между децентрализацией и контролем, свободой и ответственностью. Необходимо создавать открытые системы искусственного интеллекта, но со встроенными этическими ограничениями, основанными на криптографической безопасности и коллективном согласии. Такими мерами могут стать прозрачные механизмы аудита, протоколы согласования и согласованные нормы, которые не позволят одной силе захватить власть над интеллектом, но и уберегут мир от хаоса и разрушения. Идея о многоагентных экосистемах, где несколько интеллектуальных систем ведут диалог, спорят и приходят к консенсусу, позволяет избежать монополии и деспотии.

Это своего рода парламент разума, где мнение каждого учитывается и балансируется системами протоколов, гарантирующих справедливость и адаптивность. Такой подход способствует развитию когнитивной разнообразности и ответственного самоограничения технологий. Чтобы реализовать такую парадигму, мировому сообществу предстоит выработать международные стандарты и соглашения, которые можно условно назвать Конвенцией по этике искусственного интеллекта. Эта рамочная система должна работать на уровне протоколов, быть криптографически прозрачной, доступной для проверки и обязательной для всех участников. Таким образом, происходит нормализация взаимодействия ИИ с обществом, минимизируется риск манипуляций и обеспечивается долгосрочная стабильность.

Еще одним важным аспектом является необходимость синхронизации развития ИИ с образовательными и этическими программами для широкой общественности. Без осознания и активного участия самого общества в формировании ценностей, ограничений и направлений развития искусственного интеллекта невозможно построить безопасное и справедливое будущее. Сделать выбор между открытым и закрытым искусственным интеллектом — значит понять, что ни один подход не является самодостаточным. Открытый ИИ без ограничений ведет к хаосу, закрытый — к порабощению. Наша задача состоит в проектировании систем, которые обладают свободой и безопасностью одновременно, функционируют с уважением к человеческой природе и ценностям.

В эпоху, когда искусственный интеллект становится партнером и оппонентом человека, мы стоим на пороге нового этапа человеческой истории. От того, какой курс выберут разработчики, политики и все общество вместе, зависит не только развитие технологий, но и способность человечества выжить и сохранить человеческое достоинство. Пока архитектура будущего интеллекта еще не зафиксирована и не захвачена одной силой, у нас есть шанс совместно создать экосистему, которая будет служить интересам всех, а не единиц. Такой путь требует мудрости, сотрудничества и технологической зрелости. Выбор уже близок, и он задает тон всей цивилизации на десятилетия вперед: хотим ли мы свободы, которая может привести к катастрофе, или контроля, который может обратить нас в рабство? Истина, вероятно, лежит где-то посредине — в этическом, прозрачном, многогранном и ответственном подходе к созданию искусственного сверхинтеллекта.

Мы выбираем будущее, и это не просто технологический вопрос, а вопрос самой сущности человеческого существования и определения свободы в цифровую эпоху.