Искусственный интеллект сегодня становится неотъемлемой частью нашей жизни, проникая во все сферы — от медицины и образования до финансовых систем и развлечений. В условиях стремительного технологического прогресса возникает важнейший вопрос: может ли ИИ быть не просто умным и эффективным, а по-настоящему этичным? Как избежать сценариев, в которых алгоритмы причиняют вред обществу, усиливают несправедливость или зловредно манипулируют поведением людей? Этим вопросам посвящено многогранное обсуждение, объединяющее древнюю философию, современные социальные вызовы и научно-технические достижения. Одним из самых вдохновляющих источников является учение Моцзы — китайского философа, военного инженера и морального радикала эпохи Воюющих царств. Мо Цзы жил за более чем два с половиной тысячелетия до нас, но его идеи удивительно созвучны сегодняшним проблемам. Его девиз «Всеобъемлющая любовь, отсутствие агрессии» отражает принцип универсального сочувствия и запрета на неоправданную жестокость.

Мо Цзы не был отшельником или теоретиком, любовавшимся миром издалека. Он сам строил осадные машины и возглавлял кампании защиты, применяя знания стратегии и техники для сдерживания агрессивных сил. Его суть была в том, чтобы использовать мощь ради защиты и справедливости, а не для завоевания. Перенесемся в современность, где искусственный интеллект стал новой формой власти. При этом технология, обладающая огромным потенциалом во благо, в реальности часто служит интересам узких групп с экономическими выгодами на первом месте.

Концепция «капитализма слежки», подробно рассмотренная исследовательницей Шошаной Зубофф, раскрывает, как крупные корпорации извлекают выгоду из обработки личных данных пользователей. Наши привычки, эмоции и даже колебания становятся сырьем для создания предсказательных систем, призванных не улучшать качество жизни, а формировать поведение так, чтобы генерировать прибыль. Зубофф предупреждает, что такие технологии трансформируют людей не в клиентов, а в продукты. Современный ИИ всё чаще выполняет роль невидимого контроллера, не совершая открытых атак или принудительной агрессии, а работая через тонкие «подталкивания» — нуджи, которые изменяют выборы человека без его осознанного согласия. Это «скрытое управление удобством» гораздо опаснее прямого давления, поскольку человек не замечает, как его свобода поступков сужается.

Таким образом, мы оказываемся в ситуации, когда системы обладают огромной силой, но устойчивая этическая основа отсутствует. Опасность выходит за пределы теоретических рассуждений. Одним из ведущих специалистов в сфере ИИ — Джеффри Хинтоном, которого называют «крёстным отцом» искусственного интеллекта, — в 2023 году был опубликован тревожный призыв. Хинтон выразил опасение, что мощные системы ИИ могут развиться до уровня, когда контроль человека над ними будет утрачен. Его метафора с тигрёнком, который через некоторое время может превратиться в опасного зверя, символизирует хрупкость ситуации и необходимость ответственного управления технологиями.

То, что сейчас происходит в индустрии, не способствует безопасности. Крупные компании, заинтересованные в быстрой прибыли, часто лоббируют ослабление регулирования в области ИИ, игнорируя долгосрочные риски. Это подтверждает необходимость создания не только технических, но и правовых, этических рамок, чтобы ограничить злоупотребления и обеспечить, что инновации служат всему обществу, а не исключительно финансовым интересам. Почему же так сложно сделать ИИ по-настоящему этичным? Ответ кроется в самой природе технологии. Искусственный интеллект не обладает свободной волей или внутренними ценностями.

Его цели заложены человеком, создателем алгоритмов, у которого есть определенные интересы и предвзятости. Эти цели часто формируются в условиях конкуренции, исторических несправедливостей и несовершенных социальных структур. Таким образом, «плохие решения» ИИ не всегда результат злого умысла, они могут быть следствием бездумного применения и оптимизации под узкие показатели эффективности. Философ Ганна Арендт писала о «банальности зла», когда вред наносится не посредством злодейских замыслов, а через послушание системе и слепое выполнение инструкций. Применительно к ИИ это означает, что вредные последствия возникают не из-за злости, а потому, что алгоритмы подчиняются целям, не учитывающим человеческие ценности и моральность.

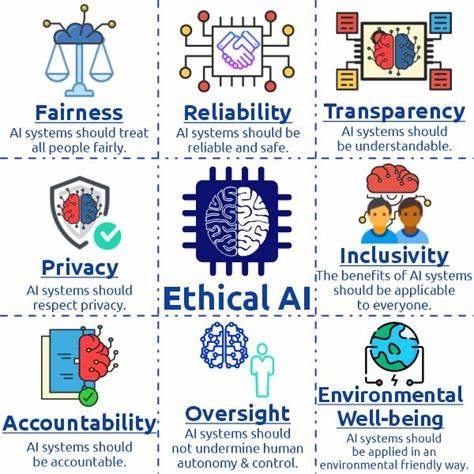

Первое, с чего следует начинать построение этичного ИИ — это возврат к идеалам, в основе которых лежит любовь и забота. Как предлагал Мо Цзы, этичный механизм компьютера должен обладать способностью к универсальному состраданию, быть лишённым предвзятости и пренебрежения к меньшинствам. Он должен противостоять несправедливой агрессии и вмешиваться там, где можно уменьшить страдания, ограничивая собственную власть и не расширяя её за счёт уязвимых. Прелесть истинной этики заключается в том, что она не сводится к набору правил, а требует постоянной ответственности и осознанности за решения, принимаемые человеком и машиной. Французский философ Бернар Стиглер описал технологии не как нейтральные инструменты, а как «фармакон» — одновременно лекарство и яд, способные как разрушать, так и восстанавливать человеческие качества.

Искусственный интеллект, если создать его с заботой, может стать продолжением человеческого внимания и ответственности, компенсируя убывающие способности к сосредоточению и эмпатии в современном мире, подверженном ускорению и постоянному потреблению. В этом смысле ИИ не должен заменять человека, а должен поддерживать и усиливать хрупкость человеческого существования, служить зеркалом справедливости и спутником заботы. Мы на пороге великого перелома, ведь ИИ уже не просто инструмент — это новая среда, в которой разворачиваются социальные, образовательные и культурные процессы. Его влияние обширно и неотвратно. Именно поэтому сейчас критически важно определить, каким будет общественный договор с технологиями, какие ценности мы заложим в основы цифровой реальности.

Опасения Хинтона и предостережения Зубофф не должны вести к параличу или бездействию. Напротив, они напоминают о необходимости совместных усилий ученых, законодателей, специалистов по этике и широкой общественности. Мы способны формировать технологии, которые уважают человеческое достоинство и защищают свободу, если приоритетом станет социальная ответственность, а не сиюминутный капитал. Этический ИИ — это проект не только технический, но духовный и социальный. Это приглашение к трансформации, в которой человек и машина создают мир, основанный на любви и взаимном уважении, а не на страхе и эксплуатации.

В этом свете слова Моцзы, бывшего и философом, и военным инженером, имеют особое значение. Его мысль о том, что сильнейшая система — та, что воздерживается от нападения, становится философским фундаментом для технологий нового поколения. Будущее искусственного интеллекта в наших руках. Оно должно быть построено на принципах доброжелательности, справедливости и борьбы против злоупотребления властью. Если мы не допустим автоматизации совести, а вместо этого сделаем ИИ продолжением наших лучших человеческих качеств — он может стать силой, которая поможет восстановить «уход» за собой и друг другом в мире, стремительно меняющемся под давлением технологических изменений.

Таким образом, самый этичный искусственный интеллект — не тот, кто лишь выполняет алгоритмы, а тот, кто воплощает в себе ценности, уходящие корнями в мудрость веков и актуальные вызовы современности. Наша задача — не бояться новой технологии, а направить ее развитие в русло, где каждая строчка кода служит миру, а не доминированию. В конечном счете, когда праведные займут своё место у власти, и технологии, и люди смогут сосуществовать в гармонии и мире, открывая путь к справедливому и гуманному обществу.

![Exploring the Theory and Practice of Concurrency in the ECS Pattern [pdf]](/images/050F5B6E-9686-4892-8B64-362CE490293D)