В современном мире искусственного интеллекта и обработки естественного языка большие языковые модели (LLM) играют ключевую роль во многих областях, начиная от генерации текста и заканчивая переводами и диалоговыми системами. Однако с ростом размеров этих моделей растут и требования к вычислительным ресурсам и памяти. Именно здесь на сцену выходит квантование — технология, позволяющая уменьшить размер моделей без значительной потери качества. Среди множества подходов в этой области недавно появилась новая звезда — Unsloth Dynamic 2.0 GGUFs, представляющая собой значительный шаг вперед в методах квантования и оптимизации моделей для локального запуска и тонкой настройки.

В основе Unsloth Dynamic 2.0 GGUFs лежит усовершенствованная динамическая схема квантования, которая значительно превосходит по качеству и эффективности предыдущие методы. Эта версия стала результатом глубокой работы команды разработчиков, которые внедрили новаторские решения для гибкого выделения и адаптации уровней квантования по слоям конкретных моделей. В отличие от прошлых подходов, где менялись лишь отдельные слои, Unsloth Dynamic 2.0 анализирует и настраивает параметры квантования для каждого слоя в отдельности, учитывая особенности архитектуры и задачи модели.

Такая кастомизация позволяет существенно повысить точность работы без существенного увеличения размера. Одним из важнейших достижений Dynamic 2.0 стало расширение диапазона поддерживаемых форматов квантования — теперь помимо привычных вариантов добавлены Q4_NL, Q5.1, Q5.0, Q4.

1 и Q4.0, что особенно актуально для устройств на архитектуре Apple Silicon и ARM. Это позволяет оптимизировать модели под различные аппаратные платформы, обеспечивая максимальный баланс между скоростью и качеством вывода. Unsloth Dynamic 2.0 GGUFs не только повышают эффективность запуска, но и позволяют выполнять тонкую настройку моделей уже в квантованном формате.

Это преимущество существенно ускоряет разработку и адаптацию LLM под специфические задачи и наборы данных, снижая затраты времени и ресурсов. Новая версия поддерживается широким спектром популярных движков для инференса, таких как llama.cpp, Ollama и Open WebUI, что облегчает внедрение технологии в различные проекты и экосистемы. Ключевой аспект успеха Dynamic 2.0 — использование калибровочного набора данных, состоящего из более чем 1.

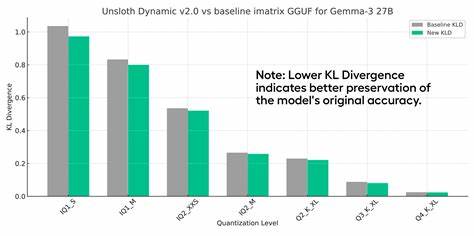

5 миллионов тщательно отобранных и очищенных токенов. Такой подход позволяет не только повысить качество чат-интеракций, но и избежать переобучения на датасетах, связанных, к примеру, с Википедией, что является типичной проблемой для многих фреймворков. Благодаря этому разработчики могут обеспечить более точное соответствие модели реальным сценариям применения и повысить надежность результатов. Важным инструментом для оценки эффективности представленного метода выступают двух главных метрики: показатель MMLU (Multi-task Language Understanding) в 5-shot режиме и KL Divergence. MMLU напрямую отражает способность модели применять знания в разных задачах без дополнительного обучения, а KL Divergence служит надежным индикатором того, насколько квантованная модель сохраняет распределение вероятностей оригинальной модели, минимизируя ошибочные «переключения» ответов.

Unsloth Dynamic 2.0 удалось достичь рекордных результатов по обоим параметрам, опережая существующие аналоги и демонстрируя сбалансированное сочетание качества и компактности. Кроме того, команда активно сотрудничала с разработчиками ведущих моделей и корпораций — среди них Qwen3, Meta с их Llama 4, Mistral, Google с Gemma 1-3 и Microsoft с Phi. Благодаря этому Unsloth не только создали уникальные квантованные версии, но и исправили многочисленные критические ошибки в исходных моделях, что существенно повысило их точность и стабильность при работе. Эти исправления заметны и в публикациях независимых экспертов, которые отмечают высокую производительность и надежность Unsloth GGUFs.

В практической реализации Dynamic 2.0 широко применяются разнообразные методы оптимизации, включая интеллектуальный выбор слоев для квантования, что ранее было доступно лишь для моделей с архитектурой Mixture of Experts (MoE). Теперь технология универсальна и применяется к моделям всех типов без исключения. Это расширяет спектр ее применения и делает метод востребованным инструментом для исследователей и разработчиков. Эксперименты с различными версиями Gemma 3 показали убедительные показатели: квантование с точностью 4 бита обеспечило как снижение занимаемого пространства на диске до двух гигабайт по сравнению с версией с обучением с учетом квантования (QAT), так и увеличение точности на 1 процент по MMLU.

Это значительное достижение с точки зрения эффективности и качества обслуживания пользователей. Кроме того, была разработана собственная метрика эффективности, которая сочетает в себе размер модели и качество её ответов, что позволяет объективно оценивать соотношение компромисса между скоростью, размером и точностью. В развитии технологии Unsloth Dynamic 2.0 особую роль занимает исправление ошибок, связанных с последними релизами и модификациями Llama 4. В частности, были исправлены проблемы с масштабированием RoPE и нормализацией QK, которые приводили к снижению качества результатов.

Сотрудничество с сообществом и активное участие в развитии llama.cpp позволили обеспечить поддержку последних обновлений и обеспечили максимальную совместимость с популярными платформами. Пользователи могут применять модификации Dynamic 2.0 в собственных проектах с помощь простых шагов по скачиванию и запуску уже готовых моделей в формате GGUF. Пример с Llama 4 Scout продемонстрировал, что можно эффективно использовать измененные модели с огромным контекстом (до 16 384 токенов) и при этом управлять вычислительными ресурсами через разумное распределение нагрузки на CPU и GPU.

Тонкая настройка параметров инференса позволяет достигать высоких результатов даже на скромных по мощности машинах. Unsloth Dynamic 2.0 GGUFs открывают новые горизонты для разработчиков, желающих повысить качество и скорость работы с большими языковыми моделями без необходимости иметь под рукой мощные серверы и дорогостоящее оборудование. Технология обладает большим потенциалом для локального применения, а также для коммерческих и академических инициатив, где время отклика и точность имеют первостепенное значение. В итоге можно сказать, что Unsloth Dynamic 2.

0 представляет собой новых стандарт в области квантования больших языковых моделей. Этой технологии под силу изменить подход к обучению, оптимизации и внедрению LLM, сделав их более доступными и удобными для широкого круга пользователей и специалистов. Уже сегодня динамическая квантовая оптимизация открывает путь к более эффективному и интеллектуальному взаимодействию с искусственным интеллектом, сохраняя качество и расширяя возможности его применения.