Появление и стремительное развитие искусственного интеллекта в последние годы существенно преобразовали многие сферы жизни и бизнеса. Одной из тех областей, где ИИ проявляет двусмысленную природу, является кибербезопасность. Технологии, первоначально разработанные для автоматизации процессов и помощи специалистам, теперь всё чаще используются злоумышленниками, превращая слабые места программного обеспечения - уязвимости нулевого дня - в могущественное оружие. Эта тенденция заставляет серьезно задуматься о том, как автономные AI-агенты меняют правила игры и какие вызовы стоят перед государствами, компаниями и службами безопасности. Важно понять, что же собой представляют автономные агенты и почему развитие таких систем знаменует новую эру киберугроз.

В отличие от классических чат-ботов, автономные агенты оснащены не только большим языковым моделям, но и встроенными инструментами для планирования и выполнения разнообразных задач. Они способны самостоятельно запускать сканеры, анализировать результаты, инициировать дополнительные операции и строить сложные цепочки действий без постоянного вмешательства человека. Это позволяет им работать как небольшие виртуальные инженерные команды, которые эффективно выполняют сложные и основывающиеся друг на друге задачи, включая поиск и эксплуатацию уязвимостей в ПО. Такой подход кардинально отличается от простого запроса к ИИ, поскольку он соединяет множество специализированных процессов в единую систему с координацией и глубокой аналитикой. Превращение обнаружения уязвимости в ее эксплуатацию - ключевой этап, который теперь также автоматизируется.

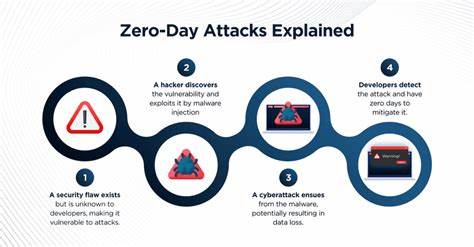

В традиционном понимании процесс атаки начинался с разведки, когда специалист вручную собирал данные о целевой системе, ее версиях и уязвимостях. Сегодня автономные агенты способны выполнять эти задачи самостоятельно, используя автоматические сканеры, веб-срачеры и анализаторы зависимостей. Получив информацию, агент формирует гипотезы о потенциальных уязвимостях и запускает целевые fuzzing-атаки, применяя продвинутые методы генерации мутаций в коде, чтобы повысить вероятность обнаружения необычных сбоев и уязвимых мест. После выявления отклонений агент генерирует доказательства уязвимости - рабочие эксплойты или цепочки команд, которые тестируются в контролируемых условиях. Совместная работа множества субагентов и центрального планировщика значительно увеличивает успех атаки.

Этот комплексный подход позволяет значительно сократить время от обнаружения слабого места до превращения его в работоспособный эксплойт - процесс, который теперь занимает минуты или часы вместо недель, что приводит к резкому увеличению скорости и масштабов кибератак с участием нулевых дней. Уже на практике были продемонстрированы различные случаи использования автономных агентов в области киберугроз и защиты. Внутренние проекты крупных компаний, таких как Google (под кодовым названием Big Sleep), показали, что агенты способны одновременно находить уязвимости в открытом программном обеспечении и оперативно предотвращать атаки в реальном времени. Такие примеры свидетельствуют о том, что возможности агентов не ограничиваются исключительно злонамеренным применением - они могут быть задействованы и в обороне. Научные исследования подтверждают эффективность применения мультиагентных систем с централизованным контролем, которые значительно превосходят одиночных агентов при выполнении сложных задач, включая эксплуатацию уязвимостей.

В дополнение к исследовательским работам, появляются реальные инструменты, такие как Hexstrike-AI, которые оперативно превращают публичные сведения об уязвимостях в автоматические эксплойты. Это сужает окно возможностей для эффективной защиты со стороны специалистов по безопасности. Одним из важнейших аспектов является то, что автономные агенты не обязаны быть безупречными в своих действиях, чтобы представлять значительную угрозу. Даже при наличии ошибок, ложных срабатываний и ограничений, их масштабная автоматизация меняет экономику киберпреступности, делая атаки дешевле, быстрее и доступнее мелким преступным группам, ранее не обладавшим высокой квалификацией. Особую опасность представляют уязвимости нулевого дня, использование которых становится более привлекательным и интенсивным благодаря трем ключевым факторам.

Во-первых, скорость: время от публичного раскрытия уязвимости до ее эксплуатации сокращается с недель и месяцев до минут. Во-вторых, демократизация: снижение технических барьеров позволяет меньшим и менее подготовленным группам пользоваться эксплойтами как сервисом, расширяя круг потенциальных злоумышленников. В-третьих, персонализация атак: агентам доступны инструменты для тщательного сбора данных о жертвам и создания адаптированных атак, включая социальную инженерию, что делает их более скрытыми и эффективными. Для противодействия этой новой волне угроз, специалисты по безопасности также используют AI, но сталкиваются с рядом ограничений. Ведущие производители уже внедряют в свои системы обработки безопасности и реагирования на инциденты вспомогательных агентов, которые помогают в анализе, выявлении и предотвращении атак.

Однако такие инструменты не решают всех проблем - им присущи ложные срабатывания, уязвимости к манипуляциям и ограниченная способность полностью блокировать сложные атаки. Дополнительные меры включают мониторинг не только сетевого трафика и журналов, но и самих действий агентов, анализ вызовов инструментов и паттернов исполнения. Критически важно ограничивать права агентов, предотвращая доступ к чувствительным данным и возможности бесконтрольного действия, а также внедрять механизмы аудита, трассировки и аварийного отключения агентов для минимизации рисков. Политическая и нормативная среда пока только формируется. Обсуждаются предложения о введении обязательной идентификации и цифровой подписи для автономных агентов, ограничении их возможностей при работе с критической инфраструктурой и установлении юридической ответственности для операторов подобных систем.

Однако полные запреты на технологии могут привести к утрате выгод, которые приносит автоматизация в области защиты и исследования угроз, что порождает сложный диалог между правительствами, бизнесом и научным сообществом. Практика показывает, что успешная защита требует комплексного подхода. Команды информационной безопасности должны учитывать вероятное использование злоумышленниками автономных агентов, включать сценарии атак с высокой степенью автоматизации в свои учения, жестко ограничивать внутренние права агентов, вести детальный аудит их действий и развивать инструменты AI-DR - системы обнаружения и реагирования, объединяющие интеллектуальный анализ и автоматические меры сдерживания угроз. Для повышения готовности эффективны мультиагентные методы в красных командах, которые моделируют быстрое и масштабное использование эксплойтов, способствуя выявлению новых уязвимостей и своевременному совершенствованию защиты. Важна тесная кооперация между государственными структурами, индустрией и исследовательскими организациями для быстрого обмена индикаторами компрометации и тактиками, так как атаки с использованием AI могут распространяться с небывалой скоростью и масштабом.

Текущие риски охватывают целый спектр возможных злоупотреблений: от адаптивных программ-вымогателей, которые самостоятельно изучают сеть жертвы и находят слабые места в резервном копировании, до инфильтрации цепочек поставок и внедрения вредоносных компонентов с автоматически сгенерированными эксплойтами. Кроме того, сочетается техническое воздействие с психологической манипуляцией, когда большие языковые модели используются для создания убедительных и персонализированных сообщений шантажа и вымогательства. Несмотря на все угрозы, у тех же архитектур автономных агентов есть и оборотная сторона - они способны искать и исправлять уязвимости, анализировать коды репозиториев и выявлять проблемы ещё до того, как злоумышленники получат шанс на эксплойт. Здесь важен грамотно выстроенный баланс между развитием технологий и эффективной системой регулирования, которая сможет поддержать положительные применения ИИ, одновременно минимизируя возможности для злоупотреблений. Ключевые вызовы для будущих исследований и политики связаны с необходимостью формализации методов верификации агентов - как гарантировать, что они не выполнят определённых вредоносных действий, созданием систем идентификации и атрибуции, а также выработкой международных соглашений, позволяющих координировать борьбу с быстро распространяющимися кибератаками, родившимися в эпоху автономного ИИ.

Современный этап развития искусственного интеллекта отражает переход от простой автоматизации к экспоненциальному увеличению рисков. Автономные агенты нулевого дня значительно сокращают интервал между обнаружением уязвимостей и их активной эксплуатацией, что бросает вызов традиционным моделям защиты и требует нового комплексного подхода, объединяющего технические, юридические и организационные решения. Чтобы превратить потенциальную угрозу в управляемую проблему, необходимо не только улучшать технологии и практики кибербезопасности, но и развивать международное сотрудничество, повышать прозрачность действия автономных систем и формировать культуру, в которой машины контролируются так же тщательно, как и люди. Только так возможно обеспечить устойчивость к новым видам угроз, входящим в век цифровой революции и глобальной взаимосвязанности. .