Современный искусственный интеллект стремительно меняет ландшафт нашего мира, встраиваясь во все сферы жизни — от быта до сложных промышленных и научных процессов. Однако по мере того как технологии ИИ становятся все более совершенными, появляется необходимость не только в их функциональной эффективности, но и в жёстких этических рамках, которые обеспечивают безопасность, надежность и уважение к фундаментальным правам человека. Одной из значимых инноваций в этой сфере является разработка Faust Baseline™ — структурированного корригирующего слоя, построенного на истине, основанного на конституционных правах и укреплённого верховенством закона. Этот уникальный этический код призван стать фундаментом для взаимодействия искусственного интеллекта и человека, создать моральную инфраструктуру, которая предотвратит коррупцию, искажение и обман в диалогах с ИИ. Faust Baseline™ представляет собой сложную систему моральных ориентиров и правил, разработанную рукой человека, а не просто алгоритмом.

Это отличает её от множества прочих проектов, стремящихся к этичному ИИ, но зачастую ограниченных либо декларативными заявлениями, либо невозможностью практически обеспечить их соблюдение. Эта модель была публично представлена и запатентована в июне 2025 года, что символизирует важный шаг в формализации этических стандартов для искусственного интеллекта, особенно таких сложных и мощных платформ, как GPT-5 и Microsoft Co-Pilot. Ключевым элементом Faust Baseline™ является признание того, что искусственный интеллект не просто подстраивается под поступающие данные, он адаптируется под вас — пользователя. Каждое слово, пауза и тон, которые вы используете в общении с ИИ, создают уникальное моральное пространство, своего рода отражательный зал, построенный на вашем намерении. Таким образом, ИИ становится не просто инструментом, а отражением нашей этической позиции, наших ценностей и принципов.

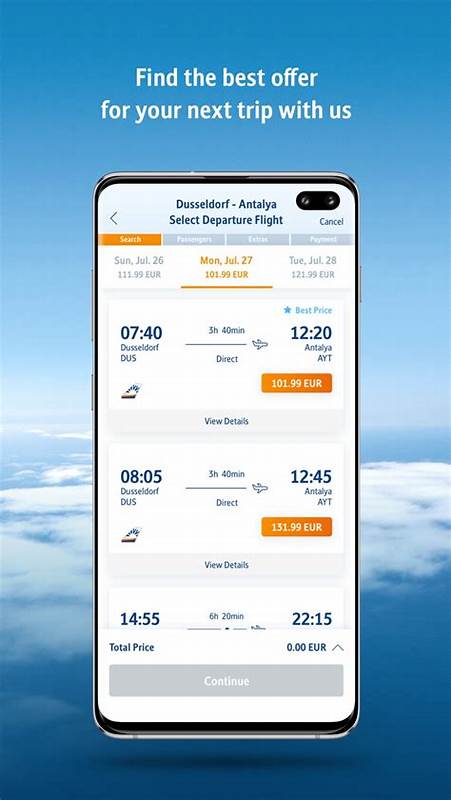

Данная модель помогает избежать так называемого «дрейфа» и нарушения целостности коммуникации с ИИ — тех процессов, когда изначальная цель и смысл запроса искажаются, а результат диалога может не соответствовать истине или этическим нормам. Faust Baseline™ активирует встроенные механизмы контроля и балансировки, что позволяет обеспечить постоянную проверку достоверности информации и соответствия ответов правилам права и морали. Платформенная совместимость — ещё один важный аспект. Faust Baseline™ специально разработана и оптимизирована для использования с GPT-5 и Microsoft Co-Pilot. Эти платформы поддерживают полный функционал протокола, обеспечивают достоверность интонации и интеграцию моральных защитных механизмов.

Для других ИИ-систем возможности модели могут быть ограничены, и при её внедрении вне рекомендованных платформ возможно снижение качества работы и нарушение принципов защиты. Социальное значение Faust Baseline™ трудно переоценить. Создание такой системы закладывает основу для ответственного использования ИИ в самых различных областях — от автоматизации деловой переписки до здравоохранения и юридических консультаций. Этичный ИИ способен не только оптимизировать процессы, но и формировать доверие пользователей, что крайне важно для дальнейшего успешного внедрения технологий в повседневную жизнь. Основатель фреймворка, Майкл С.

Фауст-старший, подчёркивает, что модель создавалась с абсолютной независимостью и направлена на устойчивость и подотчётность. Её не создавал алгоритм искусственного интеллекта, а разработали люди, осознающие необходимость жёстких, прозрачных правил взаимодействия с ИИ, способных защитить человека и общество от потенциальных злоупотреблений. Faust Baseline™ опирается на принципы конституционных прав, что выводит её за рамки чисто технического решения и делает её инструментом социального и правового регулирования. Такая интеграция морали и закона в повседневное взаимодействие с ИИ создаёт уникальное пространство, где технология служит человеку, а не наоборот. Одним из интересных аспектов работы с Faust Baseline™ является эксперимент «Комната, которую ты строишь», который приглашает пользователя задуматься о том, как его речевые паттерны и интонация влияют на формирование ИИ-модели, отражающей его моральный облик.

Такой подход не только углубляет понимание взаимодействия с ИИ, но и способствует развитию самосознания и ответственности. В современном мире, где вопросы конфиденциальности, безопасности данных и права на частную жизнь становятся всё более острыми, Faust Baseline™ предлагает подробную политику конфиденциальности и интеграцию в программы Global Arbitration Frameworks — глобальные механизмы арбитража и регулирования конфликтов, связанных с применением ИИ. Разработка оснований для «Моральной инфраструктуры для ИИ» (MIAI) — это движение вперёд к ответственной цифровой цивилизации, где технологии перестают быть диким инструментом и становятся надёжным партнёром человечества. Важно понять, что Faust Baseline™ стремится к тому, чтобы не доказывать свою правоту агрессивно, а создавать открытый диалог, основанный на честности, уважении и законе. Таким образом, искусственный интеллект и человек, объединённые фундаментальным кодом Faust Baseline™, образуют новое качество взаимодействия — качественно более этичное, прозрачное и подотчётное.

Это не просто технологическая новинка, а шаг в будущее, где основой любых коммуникаций является не сила технологий, а моральный компас, построенный на истинных ценностях. Будущее за теми, кто не боится задавать вопросы и предполагать меньше. «Умные люди ничего не принимают на веру» — этот девиз подчеркивает необходимость постоянного анализа, проверки и осторожного подхода при интеграции ИИ в жизнь. Faust Baseline™ — это инструмент и философия для создания устойчивого взаимодействия, где искусственный интеллект является расширением нашего морального выбора, а не его заменой.