В последние годы использование искусственного интеллекта (ИИ) стало неотъемлемой частью различных технологий и сервисов, предлагаемых на рынке. Один из таких примеров — чатбот Grok от компании Binance, который обещает улучшить взаимодействие пользователей с платформой. Однако недавние новости поднимают важные вопросы о конфиденциальности и закономерностях использования данных пользователей в этом контексте. Проблема использования данных пользователей для обучения ИИ-чатботов не новая. С каждым годом растут требования к защите персональной информации.

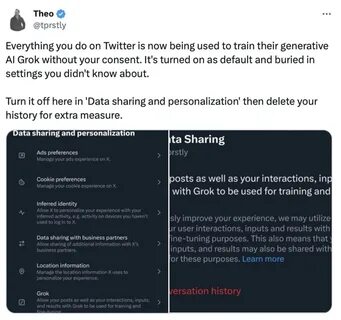

При этом компании, разрабатывающие ИИ, сталкиваются с необходимостью обучать свои модели на больших объемах данных, что часто требует использования информации о пользователях. Ситуация с Grok является ярким примером этой дилеммы. Согласно отчетам, Binance столкнулась с критикой после того, как стало известно, что данные пользователей могут быть использованы для обучения чатбота Grok. Это вызвало бурное обсуждение среди пользователей и экспертов в области конфиденциальности. Обеспокоенность вызывает не только использование данных, но и то, как именно они будут собираться и обрабатываться компанией.

Одним из основных вопросов является то, насколько прозрачными являются процессы сбора данных. Пользователи имеют право знать, какие данные собираются о них, как они будут использованы и кто к ним будет иметь доступ. Binance представила свои методы работы, но некоторые эксперты утверждают, что раскрытия недостаточно для полного понимания и оценки рисков. На фоне этого скандала многие пользователи задаются вопросом: как это повлияет на доверие к Binance и другим криптовалютным сервисам? В условиях, когда трейдинг и использование криптовалют становятся все более популярными, такие инциденты могут подорвать уверенность клиентов в безопасности своих данных. Важно отметить, что конфиденциальность данных — это не только юридическая, но и этическая проблема.

Какую ответственность несут компании за информацию, которой они управляют? Имеют ли они право использовать пользовательские данные для своей выгоды, не запрашивая согласия? Эти вопросы сегодня актуальны не только для Binance, но и для всей области разработки ИИ. В ответ на критику Binance попыталась успокоить пользователей, подчеркнув, что они принимают меры для защиты личных данных. Однако многие все еще сомневаются в том, что компания действительно обеспечивает высокий уровень конфиденциальности и безопасности. На фоне растущей обеспокоенности по поводу конфиденциальности данных, скорее всего, будут вводиться новые регуляции, направленные на защиту прав потребителей. Это может привести к необходимости пересмотра бизнес-моделей компаний, работающих с ИИ.

Некоторые эксперты предполагают, что самые строгие меры могут затруднить работу таких компаний и снизить их конкурентоспособность на рынке. Тем не менее, есть также и положительные моменты. Обсуждение конфиденциальности данных и этических норм вокруг использования ИИ становится все более актуальным. Это означает, что пользователи начинают осознавать важность своих данных и их защиты. Чем больше людей будет требовать прозрачности и ответственности от компаний, тем вероятнее, что компании начнут вести более ответственный бизнес.

Также стоит отметить, что помимо Binance, многие другие технологические и финансовые компании также используют модели ИИ для различных целей. Каждая из них сталкивается с аналогичными вызовами и должна стремиться к соблюдению этических норм работы с данными. Появление новых технологий должно сопровождаться ответственным подходом к их использованию, что включается в себя не только соблюдение законодательства, но и стремление к пониманию и принятию этических норм. В заключение, скандал вокруг использования данных пользователей для обучения ИИ-чатбота Grok от Binance открыл важные вопросы о конфиденциальности, безопасности данных и ответственности компаний. Этот инцидент может стать поворотным моментом в том, как компании работают с данными пользователей, и привести к более строгим стандартам в отношении защиты личной информации.

Пользователи, в свою очередь, должны оставаться бдительными и активно требовать прозрачности и уважения к своим правам на конфиденциальность. В дальнейшей перспективе такие обсуждения помогут формировать более этичное и безопасное пространство для пользователей и компаний, работающих с новыми технологиями.