Современный мир переживает настоящую революцию в области технологий искусственного интеллекта. Одной из самых впечатляющих и одновременно вызывающих озабоченность возможностей является создание видео с помощью алгоритмов ИИ, которые иногда невозможно отличить от настоящих записей. С развитием инструментов, таких как Google Veo и других генераторов видео на базе искусственного интеллекта, новые форматы контента заполняют интернет, затрудняя наше восприятие реальности. В связи с этим всегда актуальным остается вопрос: как надежно различать реальные и сгенерированные видео? Прежде всего необходимо понять, почему на сегодняшний день обнаружение видео, созданных ИИ, стало настолько сложной задачей. Современные модели обучаются на гигантских объемах данных, что позволяет им воссоздавать мельчайшие детали, движения и даже мимику с поразительной точностью.

Например, технология Stable Diffusion, изначально разработанная для генерации изображений, постоянно совершенствуется и применяется к созданию видео. В результате традиционные методы оценки подлинности – субъективное восприятие или анализ на глаз – уже не позволяют надежно распознать видеофейк. Важность разработки эффективных методов распознавания таких видео исходит не только из научного интереса, но и из необходимости борьбы с дезинформацией. В сети уже сейчас появляются ролики, предназначенные для манипуляции общественным мнением, создания ложного шума или дискредитации отдельных личностей и организаций. Это может повлиять на политику, экономику и повседневную жизнь миллионов людей.

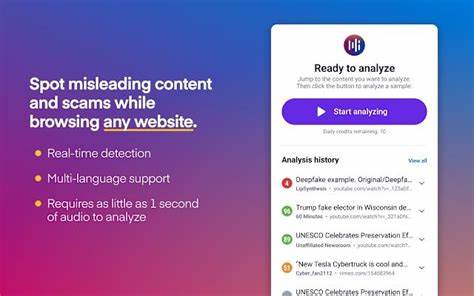

Одним из подходов к выявлению сгенерированных роликов является анализ технических характеристик видеофайла. При создании видео искусственным интеллектом зачастую остаются уникальные маркеры, которые сложно замаскировать. Например, структурные артефакты, несоответствия в освещении либо аномалии в движении объектов могут служить сигналами для экспертов и специальных программ, направленных на детектирование подделок. Существуют также специализированные программные решения, использующие методы машинного обучения для распознавания закономерностей, типичных для роликов, созданных ИИ. Такие системы обучены на больших наборах как настоящих, так и сгенерированных видео и умеют выявлять характерные отличия в текстуре изображения, степени шума, особенностях движения и синхронизации аудиодорожек.

Правда, эффективность этих инструментов пока не идеальна и постоянно требует обновления с учетом прогресса генеративных моделей. Важное значение имеет и человеческий фактор. Обучение пользователей навыкам критического восприятия видеоконтента может значительно снизить риск ошибочных суждений. При просмотре необычных или вызывающих сомнения роликов рекомендуется обращать внимание на источники публикации, проверки фактами и сопоставление с другими источниками информации. Многие эксперты также советуют использовать инструменты обратного поиска изображения для проверки ключевых кадров видео.

Это может помочь выяснить, не был ли фрагмент взят из реального ролика и повторно использован с изменениями. Подобные техники становятся особенно полезными в борьбе с дипфейками и видео, где лица подделаны с высокой точностью. В то же время исследователи предсказывают, что конкуренция между генерацией и детектированием видео будет только усиливаться. Именно поэтому важна поддержка научных инициатив и существование открытых баз данных с видеоданными для достаточного тренировочного материала алгоритмов распознавания. Безопасность цифрового пространства в эпоху искусственного интеллекта напрямую зависит от способности общества и технологий к своевременному распознаванию контента, который пытается ввести в заблуждение.

Возможно, в ближайшем будущем появятся новые стандарты маркировки или встроенные методы верификации, позволяющие с высокой степенью уверенности устанавливать подлинность видеоматериалов. Итогом является понимание, что надежное обнаружение видео, созданных с помощью ИИ, требует комплексного подхода, включающего технические инновации и повышение медийной грамотности. Только так можно сохранить доверие к видеоконтенту и предотвратить негативные последствия распространения искусственно сгенерированных материалов. Этот вызов является одним из ключевых для отрасли медиа и информационных технологий в ближайшие годы.