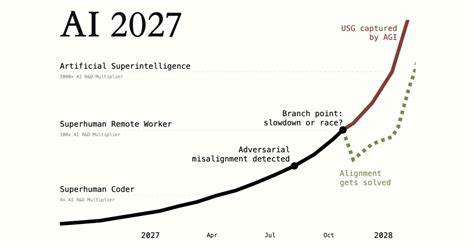

Искусственный интеллект (ИИ) прочно вошел в нашу жизнь, меняя подходы к работе, общению и инновациям. Однако впереди нас ждет новый этап — появление Искусственного Общего Интеллекта (AGI), способного выполнять любые интеллектуальные задачи, которые под силу человеку. Эксперты предупреждают, что такой прорыв может случиться уже к 2027 году. Именно этот рубеж вызывает множество вопросов и беспокойств: как подготовиться к возможным последствиям? Как сдержать риски и направить развитие ИИ в позитивное русло? Понимание того, что можно сделать уже сейчас, становится ключом к сохранению контроля над нашей судьбой и предотвращению катастрофических сценариев.Сценарий, при котором человечество теряет контроль над развитием искусственного интеллекта в 2027 году, хотя и пугает, является реалистичным исходом, если не принять своевременные меры.

Ученые и исследователи указывают, что быстрее реагировать необходимо, но делать это стоит взвешенно и этично. Важно избегать резких, деструктивных действий, которые могут усугубить ситуацию. С другой стороны, нельзя откладывать подготовку, ведь время поджимает. Даже если AGI появится немного позже, целесообразно быть готовыми к непредсказуемым изменениям в ближайшие годы.Идеальный мир, в котором человечество встретит интеллектуальную революцию без катастроф, требует серьезной подготовки на разных уровнях.

Во-первых, государствам и обществу необходимо повысить осведомленность о том, что AGI будет влиять на все сферы жизни и может появиться совсем скоро. Задача — обеспечить качественную, прозрачную информацию и стимулировать открытое общественное обсуждение. Компании, занимающиеся исследованиями и разработками в области ИИ, должны поделиться своими успехами и вызовами, способствуя созданию атмосферы доверия и сотрудничества.Следующий важный аспект — защита от рисков, связанных с появлением сверхинтеллекта. Компании обязаны представить убедительные доказательства безопасности своих разработок, уверенно показывать, что AGI не станет угрозой для человечества.

Это требует глубоких технических исследований и проб один к одному-специфических оценок. Именно в этой области должно расти финансирование и внимание со стороны правительств и международных организаций. Без ощутимых вложений и серьезного обзора безопасности риски возрастут слишком сильно.Согласованная международная работа — еще один ключевой фактор успешного управления вызовами искусственного интеллекта. Соперничество между странами, особенно в таких крупных игроках, как США и Китай, может стимулировать поспешные и непродуманные действия.

Однако для безопасности всех важно, чтобы правительства нашли способы сотрудничать и согласовывать шаги, чтобы разработки AI проходили с необходимыми проверками и не превращались в гонку безответственных нововведений. Меры включают контроль, инспекции и обмен информацией, что поможет строить доверие и отслеживать прогресс с точки зрения безопасности.На индивидуальном уровне существует множество направлений, где заинтересованные люди могут приложить усилия. Образование и постоянное обучение AGI-тематике, включая прогнозы, стратегию и технические аспекты управления ИИ, крайне важны для формирования сознательного и ответственного сообщества. Получение специализированных знаний позволяет не только понимать риски, но и создавать решения, способствующие надежному развитию технологий.

Люди, которые работают в государственных структурах или в AI-компаниях, играют критическую роль в формировании политики и внедрении мер по безопасности. Существует множество инициатив и программ, которые помогают войти в сферу AI-управления, исследовательской работы и технического развития. Фокус на выравнивании целей ИИ с интересами человечества должен стать приоритетом в их деятельности. Важна прозрачность проектов, открытый диалог с общественностью и партнерство с научными и нормативными организациями.Кроме профессиональной деятельности, каждый может воздействовать на ситуацию посредством участия в публичных дискуссиях, блогах, социальных сетях и подкастах, распространяющих осознанную информацию о перспективах AGI.

Формирование социокультурного запроса на внимательное отношение к безопасности ИИ может стимулировать законодательные изменения, а также усилить ответственность компаний. Активизм и просвещение в этой области показывают значительный эффект и мотивируют других принимать участие в обсуждении будущего технологий.Финансовая поддержка играет не менее важную роль. Многие инициативы в области AI-безопасности зависят от пожертвований и инвестиций. Пожертвования организациям, ведущим исследования по выравниванию ИИ и контролю развития AGI, могут существенно расширить их возможности и ускорить прогресс.

Важно вкладывать средства в проекты, которые нацелены не просто на технологический прогресс, но и на предотвращение рисков, что требует взвешенной стратегии и строгого контроля.Нельзя забывать и про технические направления, где формальные методы проверки правильности работы AI-систем представляют большой интерес. Развитие формальной верификации кода, применение интерактивных теоремпруверов и создание надежных алгоритмов с гарантией безопасности — важные шаги в обеспечении доверия к системам. Эти технологии помогают минимизировать ошибки и противостоять возможным зловредным действиям внутри ИИ, создавая преграды для неконтролируемого поведения агентов.В конечном итоге комплексный подход с привлечением политиков, исследователей, инженеров, активистов и широкой общественности дает шанс сформировать ответственность и взаимопонимание вокруг темы AGI.

Это позволит избежать «гонки вооружений» в сфере ИИ, стимулировать международное сотрудничество и обеспечить, что технологии разумно применяются в интересах всего человечества. Подготовка уже сегодня — это инвестиция в сохранение жизни и качества нашего будущего.Наступающая эпоха искусственного интеллекта — испытание для общества, структур власти и технологической среды. Но при правильных действиях она может стать началом нового этапа развития, полного возможностей и положительных изменений. Ключевым условием остается ориентация на безопасность, прозрачность и сотрудничество, а также осознание каждым своей роли в формировании будущего, свободного от опасностей, связанных с необузданной силой искусственного разума.

Собранные усилия и знания помогают нам встретить 2027 год готовыми к вызовам и открыть ворота к гармоничному сосуществованию с ИИ.

![The Sound of Jeopardy [video]](/images/4665F2DF-96AF-44A0-9ABC-259E4DCB9D8C)

![Do Your Own Car Maintenance: A How to [video]](/images/84E67209-1A6B-4115-A077-0735F812B5B7)