В последние годы криптовалюты стремительно набирают популярность, привлекая всё больше инвесторов и пользователей. Вместе с этим растет и количество угроз, связанных с безопасностью цифровых активов. Одним из самых тревожных явлений современного киберпространства стало использование искусственного интеллекта и машинного обучения для проведения хакерских атак на криптовалютные биржи, кошельки и пользователей. AI-боты, или автоматизированные программные комплексы с элементами самообучения, открывают новую страницу в мире цифровых преступлений, создавая серьёзные риски для сохранности криптовалютных средств. В чем именно состоит опасность этих технологий и как защитить свои активы — важные вопросы, которые стоит рассмотреть детально.

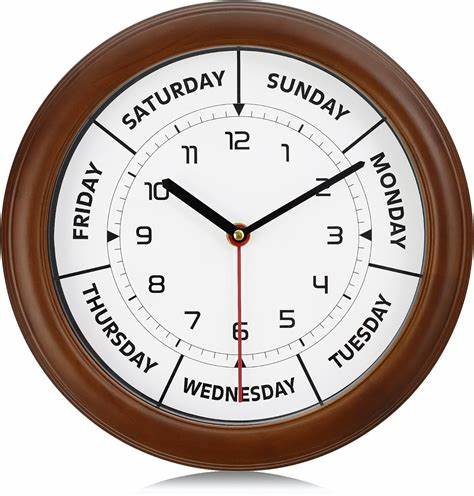

Искусственный интеллект в руках злоумышленников способен создавать атаки гораздо более масштабные, быстрые и адаптивные, чем традиционные методы взлома. Если раньше хакеры ограничивались ручным вмешательством, требующим времени и определенных навыков, теперь AI-боты самостоятельно анализируют огромные объемы информации, совершенствуют свои методы и одновременно проводят тысячи атак. За счет такой автоматизации вероятность успешного взлома резко возрастает, а последствия для жертв становятся катастрофическими. За последние годы стало ясно, что главным оружием AI-ботов в киберпреступности являются их скорость, масштаб и способность адаптироваться. Они могут за считанные минуты просканировать миллионы транзакций блокчейна, выявляя уязвимости в кошельках или смарт-контрактах, которые затем используются для кражи средств.

В отличие от ограниченных ресурсов и количества попыток человеческого хакера, искусственный интеллект способен проводить персонализированные фишинговые атаки на миллионы пользователей одновременно. Благодаря машинному обучению, AI-боты совершенствуют свои фишинговые письма и сообщения, устраняя ошибки прошлых кампаний и делая ложные уведомления почти неотличимыми от настоящих. В результате пользователи всё чаще становятся жертвами убедительных мошеннических рассылок, направленных на кражу приватных ключей и другой конфиденциальной информации. Особенно опасны AI-боты в области эксплойта смарт-контрактов: они быстро находят уязвимости в новейших децентрализованных приложениях и DeFi-проектах, используя эти бреши для кражи крупного объема средств — зачастую в течение нескольких минут после обнаружения. Даже самые сложные манипуляции, которые ранее требовали квалифицированного вмешательства, теперь выполняются автоматически и молниеносно.

Кроме того, искусственный интеллект значительно ускорил и повысил точность атак методом брутфорса, позволяя взламывать слабые пароли и seed-фразы гораздо быстрее, чем раньше. Наибольшую уязвимость продолжают представлять недостаточно сложные и уникальные пароли, а также отсутствие многофакторной аутентификации. Другой тревожный тренд — использование AI-ботов для создания реалистичных deepfake-видео и аудиозаписей, с помощью которых мошенники могут имитировать голоса и образы известных криптоинфлюенсеров и руководителей. Такой тип обмана способен убедить даже опытных пользователей перевести деньги или инвестировать в мошеннические проекты, что значительно усложняет задачу распознавания опасности. В социальных сетях и мессенджерах масштабные ботнеты с искусственным интеллектом занимаются промоушеном фальшивых криптовалют и мемкоинов, создают иллюзию массовой поддержки и вкладывают в мошеннические схемы неопытных инвесторов.

Часто такие операции сопровождаются финансированием кампаний с применением поддельных аккаунтов и автоматической генерацией правдоподобных комментариев, что усиливает эффект доверия. Возникают случаи, когда с помощью AI-технологий мошенники развивают длительные романы с жертвами, чтобы затем склонить их к инвестированию в фиктивные криптовалютные продукты — так называемые «скемминговые» или «pig butchering» схемы, которые нанесли многомиллионные убытки. На рынке криптотрединга также появились так называемые AI-боты для автоматической торговли, которыми очень часто маскируются мошеннические проекты. Они обещают невероятно высокую доходность, вводя инвесторов в заблуждение и в итоге присваивая вложенные средства. Некоторые из таких ботов могут выполнять сложные сделки, но общая доходность остаётся минимальной, а риски значительными.

Помимо прямого мошенничества, автоматизированные торговые и фронт-раннинг боты используют эксплойты в децентрализованных финансовых протоколах, реализуя манипуляции, которые приводят к потере средств пользователей из-за уязвимостей смарт-контрактов. Еще одна область, где искусственный интеллект расширяет возможности злоумышленников — распространение вредоносного ПО. AI помогает создавать самообновляемые вирусы, которые меняют собственный код, чтобы обходить антивирусные системы, а также модифицировать трояны, направленные на кражу паролей и приватных ключей. Такие программы способны длительное время работать незаметно, собирая необходимую информацию для полной компрометации криптоаккаунта. Чтобы противостоять этой растущей угрозе, критически важно использовать аппаратные кошельки — устройства, хранящие приватные ключи офлайн и не позволяющие AI-ботам получить доступ к цифровым активам через интернет.

Также необходимо включать многофакторную аутентификацию, предпочтительно через приложения-аутентификаторы, поскольку звонки и SMS-коды могут быть перехвачены при помощи SIM-свопинга. Внимательность при работе с электронными письмами и сообщениями — еще одно ключевое правило. После появления AI-фишинговые атаки становятся все более изощренными, поэтому важно вручную проверять ссылки и не предоставлять информацию о ключах или кодах двумфакторной аутентификации даже по кажущимся официальными запросам. Следует особенно осторожно относиться к видеозаписям и аудиосообщениям с призывами к вложениям, ведь deepfake-технологии позволяют создавать очень достоверные фальшивки. Регулярное обновление знаний о последних векторах атак, известных уязвимостях и методах защиты поможет держать безопасность на высоком уровне.

Рекомендуется следить за специализированными ресурсами, которые оперативно публикуют отчеты о новых угрозах и эффективные меры противодействия. Будущее защиты криптовалют будет напрямую связано с использованием искусственного интеллекта в обороне. Уже сейчас существуют системы, анализирующие блокчейн-транзакции в режиме реального времени, которые с применением машинного обучения выявляют подозрительную активность и предотвращают кражи. Ключевой задачей станет создание коопераций между криптобиржами, разработчиками блокчейнов, поставщиками кибербезопасности и регуляторами, направленных на внедрение совместных AI-решений для защиты сообщества. Несмотря на растущие риски, потенциал искусственного интеллекта также можно использовать для улучшения безопасности и повышения доверия к криптовалютам.

Своевременное информирование и адаптация к угрозам позволят пользователям эффективно противостоять автоматизированным атакам и сохранить свои цифровые активы. Только совместные усилия, грамотное применение технологий и бдительность могут сделать будущее цифровых финансов безопасным и устойчивым.