Современная эпоха искусственного интеллекта значительно преобразилась благодаря развитию глубокого обучения и архитектур трансформеров, которые доминируют в задачах обработки естественного языка и компьютерного зрения. Тем не менее, с ростом сложности и масштабов моделей возникает необходимость создавать системы, способные не только обучаться на огромных объемах данных, но и эффективно мыслить, приближаясь к человеческому уровню рассуждений. В этой связи энергоориентированные трансформеры (Energy-Based Transformers, EBT) представляют собой новый класс моделей, которые обещают радикально повысить масштабируемость и способности интеллект-систем за счет представления и оптимизации совместимости между входами и прогнозами в виде энергофункций. Их уникальные свойства уже демонстрируют впечатляющие успехи в разнообразных задачах – от языковой обработки до визуальной реконструкции – и меняют представления о том, как создаются и обучаются интеллектуальные алгоритмы. Исторически трансформеры стали популярными благодаря их способности обрабатывать последовательности и эффективно учитывать контексты с помощью механизма внимания.

Классические трансформеры, такие как Transformer++, добились заметных успехов во многих областях, но при этом сталкиваются с проблемами масштабируемости и ограничениями в постобработке выводов. Чаще всего они работают в «первой системе мышления» — быстрой, но поверхностной генерации ответов. Для усовершенствования моделей ученые стали внедрять техники, имитирующие «вторую систему мышления» по теории Даниэля Канемана, информируя модели проводить более глубокую проверку и оптимизацию своих предсказаний во время инференса. Однако большинство таких подходов было узкоспециализированным, требовало дополнительных супервайзерных данных или работало только с конкретными типами задач. Здесь на сцену выходят энергоориентированные трансформеры.

EBT строят свою работу на принципах энергоориентированных моделей (Energy-Based Models, EBM), которые назначают каждому сочетанию входа и кандидата в ответ определённое энергетическое значение. Чем ниже энергия, тем более согласованной и вероятной считается такая пара. Такой подход позволяет заменить классический прямой вывод оптимизацией, стремясь найти минимальное энергетическое состояние через градиентный спуск. Благодаря этому EBT способны не только генерировать предсказания, но и активно минимизировать энергетическую функцию, словно продуманно «рассуждая» над тем, насколько каждый ответ подходит.<br><br>Одним из главных преимуществ EBT является их универсальность.

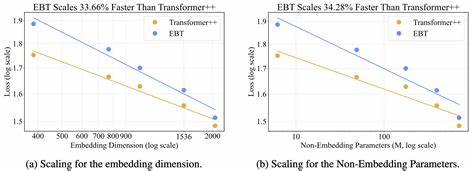

Они не ограничиваются одной модальностью информации — успешно работают как с дискретными данными (текстом), так и с непрерывными сигналами (изображениями). Такой кросс-модальный потенциал принципиально отличает их от традиционных систем, зачастую заточенных под узкие условия. Кроме того, эксперименты показывают, что EBT масштабируются быстрее и эффективнее классических трансформеров. Их скорость масштабирования достигает прироста до 35% по отношению к Transformer++ по различным метрикам, таким как объем данных, размер батчей, количество параметров, количество операций с плавающей запятой и глубина сети. Одной из интереснейших особенностей энергоориентированных трансформеров является улучшенное качество при выводе модели — за счет интеграции механизма System 2 Thinking.

Такое «вторичное мышление» во время инференса позволяет EBT еще сильнее превосходить классические трансформеры, демонстрируя преимущество в 29% при решении языковых задач. Это дает модели эффект самопроверки и уточнения, которого не хватает в обычных архитектурах, усиливая надежность и точность результатов без дополнительных затрат на отдельное обучение системы верификации. Помимо обработки естественного языка, энергоориентированные трансформеры находят применение в области компьютерного зрения. Особенно это касается задач, связанных с восстановлением и улучшением изображений, таких как денойзинг. В подобных задачах EBT превосходят диффузионные трансформеры, требуя при этом значительно меньшее количество проходов вперед по модели.

Это позволяет ускорить обработку и снизить вычислительные затраты, что особенно ценно при работе с большими объемами визуальных данных. Значимым индикатором потенциала EBT является их способность достигать более высоких результатов на downstream задачах (задачах, для которых модель настраивается после предварительного обучения), даже несмотря на то, что их показатели на этапе предварительного обучения могут уступать другим методам. Это свидетельствует о более глубоком и качественном обобщении знаний, что является ключевым фактором при создании адаптивных и надежных интеллекта-систем. С научной точки зрения, концепция энергоориентированных трансформеров открывает новые пути для исследований в области систем искусственного интеллекта, которые учатся самостоятельно улучшать свои предсказания на основе внутреннего критического анализа. Она соответствует устремлениям к созданию универсальных моделей с возможностью масштабируемого и устойчивого обучения, эффективности в ресурсопотреблении и способности решать широкий спектр задач без необходимости антропоморфных черт и сложных внешних механизмов контроля качества.

В практическом же плане, развитие и внедрение EBT может существенно повлиять на индустрии, где требуются интеллектуальные решения с повышенной точностью и адаптивностью — от разработки языковых ассистентов и систем машинного перевода до обработки медицинских изображений и аналитики данных. Модель с более выраженной способностью к саморефлексии и оптимизации предсказаний позволяет создавать AI-системы, приближающиеся к уровню человеческого мышления, способного абстрагироваться и уточнять информацию в процессе анализа. Однако, несмотря на многочисленные преимущества, технология энергоориентированных трансформеров всё еще требует дальнейшего развития и оптимизации. Эти модели требуют тщательной настройки гиперпараметров для эффективной минимизации энергии и объединения всех компонентов в единую рабочую систему. Кроме того, необходимо расширить исследование по области масштабного обучения для подтверждения устойчивости EBT в условиях реального мира и больших разнородных наборов данных.