В последнее десятилетие машинное обучение сделало решительный шаг вперёд, завоевав лидирующие позиции в сфере искусственного интеллекта и анализа данных. Однако несмотря на впечатляющий прогресс, многие фундаментальные вопросы касательно природы обучаемых моделей и способностей их представления сложной информации остаются открытыми. В этом контексте на первый план выходит топология — раздел математики, изучающий свойства объектов, сохраняющиеся при непрерывных деформациях. Попытки применить топологические концепции в машинном обучении создают новые возможности для качественного и структурированного анализа данных, что порождает многогранное и перспективное направление, объединяющее два этих казалось бы далеких мира. Топология, особенно её прикладные аспекты, предлагает методы для описания и понимания данных как геометрических и пространственных структур, что существенно расширяет инструментарий традиционного машинного обучения.

Одним из ключевых понятий является симплициальный комплекс — обобщение графов, включающее не только рёбра и вершины, но и многомерные простыеxes, такие как треугольники, тетраэдры и их аналоги. Это позволяет учитывать отношения между множеством точек, выходящие за рамки парных связей, и создавать более полное описание структуры данных. Важнейший топологический инвариант, используемый в таких исследованиях, — эйлерова характеристика, которая служит числовым показателем формы объекта. Она выражается в виде чередующейся суммы количества симплексов разных размерностей, позволяя компактно охарактеризовать сложные пространства. Однако сама по себе эйлерова характеристика слишком груба для глубокого анализа, поэтому была разработана её многомерная и многомасштабная версия — Эйлерова характеристическая трансформация (ECT).

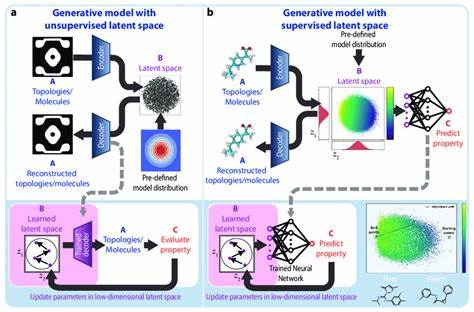

ECT представляет собой функцию, которая для каждого направления в пространстве возвращает так называемую Эйлерову характеристическую кривую, описывающую эволюцию структуры объекта при фильтрации по этому направлению. Такой подход позволяет создать информативный и инвариантный к ряду преобразований код объекта, что очень ценно для задач классификации и распознавания. Применение ECT и связанных с ней топологических инструментов в машинном обучении особенно интересно в контексте глубоких нейронных сетей. Обычно глубокие модели требуют многомиллионных наборов параметров и огромных объёмов данных, чтобы эффективно обучаться и избегать переобучения. Топологические методы позволяют внедрять структурные знания напрямую в архитектуру моделей, создавая своего рода индуктивное смещение — предположение, которое помогает обучению сосредоточиться на действительно значимых свойствах данных.

Это приводит к повышению устойчивости моделей, снижению их вычислительной сложности и улучшению интерпретируемости. Для глубокого обучения была предложена идеа дифференцируемой реализации ECT, которая заменяет резкие индикаторные функции на гладкие аппроксимации с помощью сигмоидальных переходов. Таким образом, вычисление топологических характеристик становится непрерывным и дифференцируемым процессом, совместимым с методами градиентного спуска и оптимизации нейросетей. Эта трансформация получила название Дифференцируемый Эйлеров характерестический трансформ. Такая реализация позволяет учить оптимальные направления фильтрации и даже сами координаты входных данных, тем самым интегрируя топологический анализ в конвейер обучения моделей.

Практические результаты использования ECT в машинном обучении послужили доказательством её огромного потенциала. На простых двумерных примерах показана возможность реконструкции форм и точек с помощью оптимизации параметров топологического слоя. В задачах классификации геометрических графов, где традиционно лидируют графовые нейронные сети с механизмом «передачи сообщений», применение топологических признаков демонстрирует конкурентоспособность при гораздо меньших требованиях к вычислительным ресурсам и памяти. В дополнение к своим преимуществам в эффективности и точности, топологические методы расширяют понимание «черных ящиков» глубокого обучения, раскрывая качественные структурные свойства, на которых базируется обучение. Такая перспектива особенно важна в условиях широкого распространения моделей, воспринимаемых как непредсказуемые или уязвимые к атакам извне, где топология может служить линзой для выявления уязвимых мест и повышения доверия.

В более широком плане развитие топологического машинного обучения открывает увлекательные перспективы для науки и техники. Оно знаменует собой трансформацию классических алгоритмических подходов в сторону более символического, осмысленного и теоретически подкованного анализа данных. Это помогает не только в решении прикладных задач — от медицины и робототехники до компьютерного зрения и биоинформатики — но и стимулирует фундаментальные исследования в математике, стимулируя создание новых инвариантов, методов и моделей. Особое внимание уделяется развитию гибридных систем, где нейронные сети объединяются с топологическими структурами, что даёт возможность обучать модели с обогащённым пониманием пространства данных и их внутренней организации. В перспективе это позволит не только улучшать качество и надёжность механизмов искусственного интеллекта, но и всерьёз приблизить их к способности к рассуждению и осмысленному восприятию информации.

Кроме того, топология обеспечивает фундамент для анализа функций нейронных сетей самих по себе, раскрывая внутренние механизмы обучения, влияния архитектуры и поведения моделей в различных режимах. Понимание таких качественных свойств способно привести к разработке новых принципов построения эффективных, устойчивых и объяснимых систем. В эпоху, когда машинное обучение всё чаще связано с большими данными и непрозрачными моделями, вкрапление строгих математических методов и структурных знаний оказывается своевременным и крайне важным. Таким образом, топология выступает не просто вспомогательным инструментом, а самостоятельной и мощной дисциплиной, способной изменить взгляд на задачи искусственного интеллекта и обеспечить надежную основу для будущих разработок. Интерес к этому междисциплинарному полю постоянно растёт, стимулируя учёных и инженеров исследовать новые направления, формируя мост между чистой математикой и практикой машинного обучения.

И хотя впереди остаётся множество открытых проблем — от поиска оптимальных топологических признаков до алгоритмической оптимизации для больших данных — уже сегодня ясно, что синергия топологии и машинного обучения сильно расширяет горизонты, делая технологии умнее, быстрее и надёжнее.