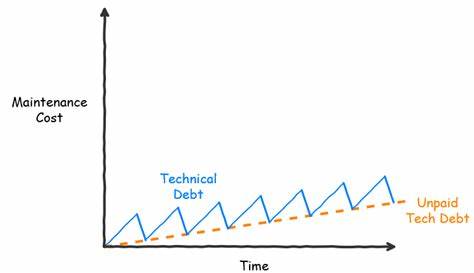

Современная эпоха стремительного развития технологий искусственного интеллекта (ИИ) порождает не только новые возможности, но и новые вызовы, одним из которых становится так называемый верификационный долг. Этот термин лишь недавно вышел на арену технологического и научного дискурса, однако уже стал ключевым для понимания проблем, связанных с использованием генеративного ИИ в различных сферах деятельности. По сути, верификационный долг – это накопленная стоимость недостаточного или поверхностного контроля и проверки результатов, которые создаются с помощью алгоритмов ИИ. В отличие от технического долга, который напрямую затрагивает качество и поддерживаемость программного обеспечения, верификационный долг затрагивает гораздо более широкие аспекты, связанные с достоверностью, точностью и глубоким пониманием информации, будь то академические исследования, программный код или разнообразные документы и отчёты. Одной из особенностей верификационного долга является эффект сложных процентов: с течением времени некачественно проверенные данные и материалы всё больше используются и копируются в смежных процессах, что приводит к цепным реакциям возникновения ошибок и недостоверностей, которые потом трудно исправить.

Такая цепочка недоверия может повлечь за собой серьёзные последствия — от неправильных управленческих решений до ущерба репутации целых организаций и отраслей. Помимо прямых ошибок и ложной информации, верификационный долг несёт ещё один важный когнитивный ущерб – из-за привычки полагаться на ИИ для создания результатов пользователи рискуют формировать упрощённые или даже ошибочные ментальные модели процессов и знаний. Когда задачи делегируются ИИ, люди часто теряют глубину понимания, что в долгосрочной перспективе снижает качество анализа, принятия решений и творчества. В программировании, например, эти ментальные модели играют ключевую роль. Если разработчики не вкладывают усилия в глубокое понимание архитектуры и логики кода, а полагаются на ИИ, генерирующий фрагменты программ, их способность выявлять ошибки и эффективно развивать проекты снижается.

Особенно это ощутимо у начинающих специалистов, которые могут попасть в «иллюзию компетентности», полагая, что делают всё правильно, тогда как на самом деле их понимание поверхностно. Интересным аспектом верификационного долга является его связь с моральным риском. Часто одна сторона создаёт контент с помощью ИИ, не проверяя его должным образом, а другая сторона вынуждена тратить ресурсы на выявление и исправление ошибок. Примером может служить область информационной безопасности, где отчёты, автоматически генерируемые ИИ, могут содержать недочёты, которые обнаруживают и исправляют другие члены команды, нередко вынужденные тратить на это немалое количество времени и сил. Эта ситуация описывается как форма «защиты от дешёвой продукции»: быстро созданное слабо проверенное содержимое влияет на общую эффективность и устойчивость систем.

В научной среде проблема верификационного долга также становится всё более актуальной. Ускоренное и упрощённое написание научных статей с использованием генеративных моделей приводит к появлению «AI slop» — скорее сгенерированного, чем тщательно исследованного и проверенного материала, который может содержать ошибки, плагиат или ложную авторскую атрибуцию. Это создаёт угрозу для авторитета научного сообщества и снижает доверие к академической публикации. Верификационный долг в этой сфере усугубляется тем, что рецензирование, которое традиционно служит барьером качества, сталкивается с проблемами автоматизации процессов, когда для проверки статей тоже начинают использовать ИИ. Однако искусственный интеллект не всегда способен выявить очевидные ошибки или мошенничество, а человеческие рецензенты вынуждены работать в условиях возрастающего числа публикаций и сокращающегося времени.

Появление скрытых инструкций внутри рукописей, призванных обойти ИИ-ревьюеров, свидетельствует о новом уровне сложности проверки. Экономические и социальные последствия накопления верификационного долга выходят далеко за пределы академической среды и разработки программного обеспечения. Наглядный пример — программы государственных грантов, где с помощью ИИ оформляются отчёты и заявки, иногда весьма убедительные на первый взгляд. Однако недостаточная проверка может привести к тому, что ресурсы расходуются на недостоверные или «искусственно» созданные проекты, создавая дополнительную нагрузку на контролирующие органы и налогоплательщиков. Такой сценарий ставит под вопрос устойчивость и эффективность существующих механизмов поддержки инновационной деятельности.

Борьба с верификационным долгом требует системных изменений во многих областях. В первую очередь, необходимо повысить культуру проверки и контроля. Это подразумевает привлечение экспертов с глубокими знаниями домена, разработку новых методов и инструментов для эффективного обнаружения ошибок и недостоверностей, а также обучение пользователей ИИ ответственному использованию технологий с акцентом на проверку и понимание результатов. В технической сфере важно не только использовать ИИ для генерации кода или отчётов, но и вкладывать время в оценку качества и актуальность созданных материалов. Для образовательных учреждений особенно важно поддерживать баланс между инновационными инструментами и формированием прочных базовых знаний, чтобы избежать «иллюзии компетентности» у студентов и специалистов любого уровня.

В научном сообществе развитие технологий обнаружения подлинности и оригинальности материалов, а также совершенствование моделей рецензирования может помочь снизить риски, связанные с распространением некорректных исследований. Более того, необходим системный подход к этическим и регулятивным аспектам использования ИИ, что включает прозрачность методов создания и проверки информации, а также распределение ответственности между создателями и проверяющими. В свете этого становится очевидно, что верификационный долг – не просто техническая или организационная проблема. Это комплексный вызов, который отражает новые парадигмы взаимодействия человека и машины, а также требует переосмысления процессов создания, проверки и доверия к информации. Сохраняя динамику инноваций и активно интегрируя ИИ в нашу деятельность, необходимо не терять бдительности и развивать инструменты, которые помогут минимизировать накопление долгов, связанных с качеством и достоверностью контента.

Такой подход позволит не только сохранить эффективность технологий, но и укрепить фундамент для устойчивого и прозрачного развития общества в эпоху цифровой трансформации.