На современном этапе развития искусственного интеллекта компании, занимающиеся созданием ИИ-моделей, сталкиваются с необходимостью балансировать между коммерческими интересами, этическими нормами и государственными требованиями. Одной из ярких иллюстраций такого конфликта стал недавний инцидент с компанией Anthropic, разработчиком ИИ-модели Claude, чьи ограничения в использовании технологии на благо правоохранительных структур вызвали озабоченность и даже раздражение в администрации Белого дома во главе с бывшим президентом Дональдом Трампом. Тема ограничения возможностей применения ИИ для полиционных и разведывательных служб приобретает все более острую актуальность, учитывая растущий интерес государственных органов к интеграции передовых технологий в свои оперативные процессы. Разработка ресурсов, способных эффективно обрабатывать и анализировать огромные объёмы информации, потенциально революционизирует методы работы спецслужб, однако их этическое и юридическое применение остаётся предметом интенсивных дискуссий. Anthropic позиционирует себя как компания, приверженная этичным нормам и ответственному развитию искусственного интеллекта.

В частности, руководство фирмы, возглавляемое сооснователем Дарио Амодеи, категорически запрещает применение их моделей для задач внутреннего наблюдения и массового слежения за гражданами. Эти ограничения налагаются на основании строгих политик использования, призванных предотвратить возможность нарушения приватности и гражданских свобод. Однако именно они и стали причиной недовольства у федеральных подрядчиков, работающих с такими структурами как ФБР и Секретная служба США, которым крайне необходимы эффективные инструменты анализа данных для ведения оперативной деятельности. Ведомости, опубликованные Semafor, свидетельствуют о том, что сотрудники правоохранительных органов сталкиваются с барьерами при попытках задействовать Claude в рамках своих полномочий. Отмечается, что политика Anthropic, запрещающая использование ИИ в целях внутреннего наблюдения, формулируется достаточно неопределённо, что порождает опасения относительно избирательного применения правил и их политической обоснованности.

Такая ситуация осложняет работу подрядчиков, особенно учитывая, что именно Claude является одним из немногих ИИ-решений, одобренных для работы с секретными данными в рамках облачного сервиса AWS GovCloud. Важным аспектом в истории с Anthropic является то, что компания официально предоставляет свои услуги клиентам из национальной безопасности лишь за символическую плату в размере одного доллара. Партнёрство распространяется на широкие слои государственных структур, включая Министерство обороны, при этом сохраняется жёсткий запрет на использование ИИ в разработке оружейных технологий. Таким образом, Anthropic демонстрирует стремление активно участвовать в укреплении безопасности страны, одновременно не отказываясь от взятых на себя этических обязательств. В августе 2025 года был анонсирован крупный контракт OpenAI, согласно которому более двух миллионов работников федеральных агентств получили доступ к ChatGPT Enterprise приблизительно за такую же символическую сумму.

Это показывает рост конкуренции на американском рынке ИИ для государственных нужд и подчеркивает стремление властей к масштабному внедрению современных технологий в повседневную деятельность. В контексте этого конкурса ограничения Anthropic выглядят громоздкими и вызывают вопросы у высших чиновников, что и приводит к разногласиям в администрации. Конфликт между Anthropic и администрацией Дональда Трампа не является новым - ранее компания высказывала несогласие с попытками ограничить возможность штатов США самостоятельно регулировать сферу искусственного интеллекта. Эта позиция сочетается с представлением о необходимости взвешенного и справедливого регулирования технологий, что иногда противоречит политической установке централизованной власти. Сложная траектория развития Anthropic иллюстрирует проблему совмещения амбиций бизнеса с морально-этическими принципами и внешними рыночными и политическими ограничениями.

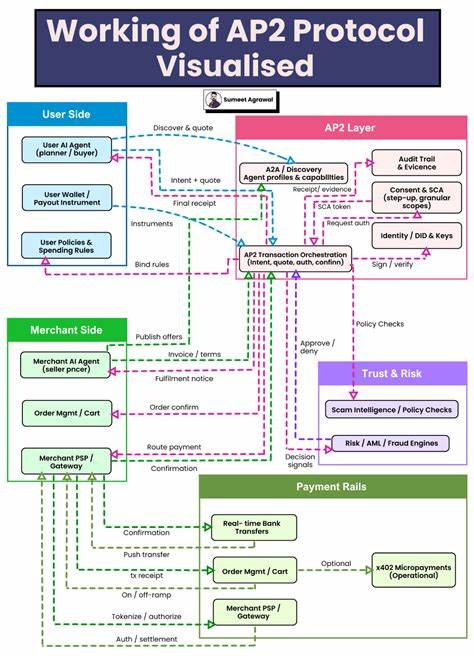

Примером является их сотрудничество с компаниями Palantir и Amazon Web Services, направленное на поставку модели Claude в американские разведывательные структуры через платформу Impact Level 6, обеспечивающую обработку и передачу информации со степенью секретности до уровня "секретно". Это партнерство вызвало критику среди защитников этики ИИ, которые расценивают его как противоречие заявленным принципам безопасности и ответственности. На более широком уровне вопросы, связанные с использованием ИИ для массового наблюдения, уже давно вызывают беспокойство экспертов по безопасности и правам человека. Очередной резонанс возник после публикации в декабре 2023 года редакционной колонки известного специалиста Брюса Шнайера. В ней он предупреждал, что автоматизация анализа огромных объемов коммуникаций с помощью ИИ может вывести слежку на качественно новый уровень.

По мнению Шнайера, традиционные методы шпионажа требуют крупных затрат человеческого труда, а ИИ способен выполнять подобные задачи за считанные минуты, что угрожает переходом от наблюдения за действиями к интерпретации намерений, включая анализ настроений и эмоций. В условиях стремительного совершенствования лингвистических моделей и повышения их возможностей обрабатывать человеческие коммуникации в огромных масштабах, вопросы регулирования, допустимых способов применения и этических границ таких технологий становятся предметом всё более острой борьбы. Американское правительство явно демонстрирует озабоченность необходимостью контролировать эти процессы, что, в свою очередь, вызывает определённые трения с технологическими компаниями, выражающими свои принципы и границы ответственности. Таким образом, конфликт вокруг ограничений Anthropic - это не просто столкновение бизнеса и государства, но симптом глобального вызова, связанного с интеграцией мощных и потенциально опасных технологий в сферу государственной безопасности и правоохранительной деятельности. Именно умение компаний и регуляторов найти общий язык, определить чёткие рамки и обеспечить прозрачность процессов решит исход этого конфликта и задаст вектор развития искусственного интеллекта в будущем.

Развитие событий в этой сфере требует пристального внимания как со стороны законодателей, специалистов отрасли, так и широкой общественности, поскольку последствия использования технологий ИИ выходят далеко за пределы узкоспециализированных ведомств и влияют на устои гражданского общества и демократические процессы в целом. Продолжение диалога между всеми заинтересованными сторонами обещает стать ключевым фактором, определяющим будущее взаимоотношений государства, общества и высоких технологий. .