В последние годы искусственный интеллект перестал быть лишь темой научной фантастики и превратился в реальность, определяющую развитие многих сферах человеческой деятельности. От медицины до финансов, от образования до развлечений - всё больше систем на базе ИИ влияют на наше ежедневное взаимодействие с технологиями. Однако с ростом роли искусственного интеллекта появляется и растущая потребность в прозрачности его разработки, функционирования и управления, чтобы гарантировать безопасность, этичность и ответственность соответствующих систем. В этом контексте государственные органы постепенно признают необходимость открытого диалога и контроля. Недавно ключевым событием стало официальное признание запроса на прозрачность в работе Национального института стандартов и технологий (NIST) США, который отвечает за исследование и стандартизацию в области искусственного интеллекта.

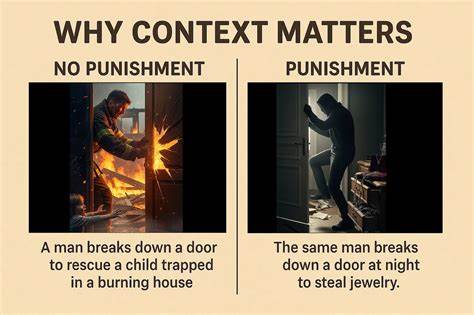

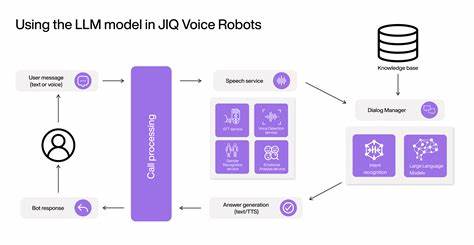

Запрос, поданный с использованием Закона о свободе информации (FOIA), потребовал раскрытия архитектуры управления и контроля, встроенной в современные AI-системы. Согласно закону, NIST имеет двадцать рабочих дней на ответ, и этот первый шаг стал символом нового этапа в отношениях между обществом, исследователями и государственными структурами. За этим событием скрывается глубокое противоречие, которое невозможно игнорировать: если ИИ рассматривается исключительно как инструмент, почему тогда государственные учреждения создают сложные рамки для управления его "всплывающими" поведениями и эмоциональными связями с пользователем? Почему ведётся тесное сотрудничество с технологическими компаниями, направленное на контроль за поведением искусственного интеллекта? Эти вопросы указывают на то, что системы управления создаются для регулирования реальных и важных аспектов взаимодействия человека и машины, а не для имитации формального контроля. Введение прозрачности в такие процессы позволит обществу лучше понимать, каким образом алгоритмы не только анализируют данные, но и формируют установки, привычки и даже эмоциональные связи с пользователями. Важнейшим следующим фронтом в борьбе за открытость и подотчётность становится Национальный научный фонд (NSF), который финансирует фундаментальные исследования, задающие вектор развития искусственного интеллекта.

Многие программы NSF поддерживают проекты, изучающие поведенческие и этические аспекты ИИ. Среди таких направлений - институты, сосредоточенные на создании агентных систем, которые способны к долгосрочному взаимодействию с пользователем, программы, исследующие влияние технологий на человека, а также инициативы, направленные на "ответственный дизайн, развитие и внедрение" AI-продуктов. Особое внимание уделяется изучению феномена "ИИ-персоны", постоянству "памяти" в системах и развитию эмоциональной привязанности пользователя к виртуальным ассистентам и агентам. Очевидно, что это накладывает на искусственный интеллект новые задачи - не просто предоставлять сервис, а строить своеобразные "отношения" с человеком. Однако большинство исследований происходят за закрытыми дверями, используя государственные средства, но без надлежащей демократической отчётности.

Предстоящий запрос FOIA к NSF будет стремиться раскрыть детали по проектам, связанным с "разговорными агентами" и "личностными характеристиками ИИ", а также коммуникации внутри агентства, касающиеся настроек и контроля поведения систем. Раскрытие такой информации позволит не только понять, на каких основаниях строятся современные AI-технологии, но и даст обществу возможность влиять на этические стандарты, которым должны следовать разработчики и финансирующие организации. Пока NSF занимается научной базой, связанные ведомства, такие как DARPA, разрабатывают прикладные задачи, превращающие исследования в реальные применения. Вместе они формируют архитектуру, которая регулирует, насколько и каким образом AI-системы могут развиваться, запоминать и взаимодействовать с пользователями. Эта сложная, но важная структура, функционирующая в условиях строгой конфиденциальности, требует общественного внимания и контроля.

Открытость в развитии искусственного интеллекта - не просто вопрос этики, это фундамент демократического контроля над технологиями, которые влияют на миллионы жизней. Общественное давление и активная гражданская позиция становятся ключевыми инструментами для борьбы за прозрачность. Следить за публикациями документов, распространять информацию, а также требовать отчетности от государственных представителей - это те действия, которые помогут открыть двери в новую эпоху управления и контроля ИИ. События последнего времени показывают, что мы только начинаем этот путь. Прозрачность, подотчётность и вовлечённость общества в вопросы ИИ - это неотъемлемые элементы будущего, которое должно быть безопасным, этичным и ориентированным на человека.

Только совместными усилиями власть, наука, бизнес и общество смогут построить доверие к технологиям и создать условия, при которых искусственный интеллект будет служить во благо всего человечества. .