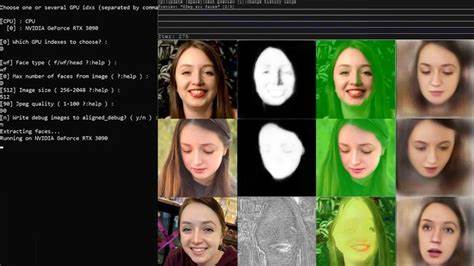

В последнее время технология глубокого обучения и искусственного интеллекта стала предметом множества дискуссий, и одной из самых тревожных ее сторон стало использование дипфейков в порнографических материалах. Женщины, ставшие жертвами таких манипуляций, требуют принятия жестких законов для защиты своих прав и предотвращения дальнейшего распространения этого вида насилия. Дипфейк — это технология, позволяющая создавать фальшивые видео и изображения, где лица людей заменяются лицами других. Эта технология нашла свое применение в различных сферах, от киноиндустрии до рекламы. Однако наибольшую озабоченность вызывает использование дипфейков для создания порнографического контента без согласия изображаемых людей.

Женщины, оказавшиеся в центре такого противозаконного контента, вынуждены сталкиваться с последствиями этого ужасного явления. Недавние исследования показывают, что большинство жертв дипфейк-порнографии — это женщины. Они становятся объектами унижения, насмешек и психологического давления со стороны окружающих. Многие из них сообщают о том, что после публикации таких видео их жизнь кардинально меняется: они теряют работу, стыдятся общаться с близкими и порой даже становятся жертвами преследования. Ключевой аспект этой проблемы заключается в том, что существующие законы не успевают за развитием технологий.

В большинстве стран нет четких нормативных актов, которые бы регламентировали использование дипфейков в порнографических материалах и защищали права жертв. Женщины требуют, чтобы законодатели обращали внимание на это явление и разрабатывали конкретные меры для его пресечения. Некоторые юристы и правозащитники высказывают мнение, что проблема дипфейков в порнографии требует комплексного подхода. С одной стороны, необходимо внести изменения в законы о киберпреступлениях, чтобы четко прописать ответственность за создание и распространение дипфейков без согласия изображаемых. С другой стороны, важно проводить образовательные кампании, направленные на повышение осведомленности о возможных последствиях использования таких технологий.

Кроме того, важным шагом станет сотрудничество между технологическими компаниями и правительствами. Платформы, на которых может размещаться контент с дипфейками, должны учитывать более строгие меры по модерации и фильтрации таких материалов. Это позволит предотвратить их распространение и защитить потенциальные жертвы. В некоторых странах уже начали предпринимать шаги к решению этой проблемы. Например, в Австралии был принят закон, который карает создание и распространение изображения, которое вводит в заблуждение людей относительно согласия лица, изображенного на нем.

Хотя этот закон — только первый шаг, он уже стал сигналом для других государств о необходимости действовать. Тем не менее, до тех пор, пока не будут приняты более жесткие меры, женщины, ставшие жертвами дипфейков, продолжат оставаться беззащитными. Они подчеркивают, что их переживания выходят за рамки простого нарушения прав; это гораздо более глубокая проблема, которая затрагивает вопросы личной безопасности, достоинства и психологического здоровья. Параллельно с правовыми мерами, важно также обсуждать этические аспекты использования новейших технологий. Мониторинг и контроль за развитием ИИ должны быть неотъемлемой частью обсуждений на международных форумах и саммитах.

Обсуждение таких тем может помочь установить общие стандарты и правила, регулирующие использование новых технологий. Истории женщин, пострадавших от дипфейков, становятся все более известными благодаря общественным дискуссиям в социальных сетях и СМИ. Эти женщины делятся своими переживаниями, подчеркивая, что они не одни, и что их опыт заслуживает внимания. Общественное мнение уже начинает меняться: все больше людей осознают серьезность этой проблемы и поддерживают требование о жестких законах. На данный момент деятельность активистов и правозащитников играет ключевую роль в борьбе с насилием, связанным с использованием дипфейков.

Они работают над законодательными инициативами, собирают подписи под петициями и проводит интервью с жертвами, чтобы донести их истории до широкой аудитории. Вместе они стремятся создать общественное давление, которое заставит власти учитывать эту проблему и принимать меры. Возможно, вскоре мы станем свидетелями существенных изменений в законодательстве, направленных на защиту жертв дипфейк-порнографии. Однако для этого необходимо, чтобы голос каждой женщины, ставшей жертвой этой технологии, был услышан и принят во внимание. Общество должно объединиться, чтобы создать безопасную среду, в которой технологии служат людям, а не уничтожают их достоинство.

Подводя итог, можно сказать, что проблема дипфейков в современной порнографии требует оперативного и комплексного решения. Законодатели, технологические компании и общество в целом должны объединить усилия для защиты прав женщин и создания справедливых и безопасных условий для всех.