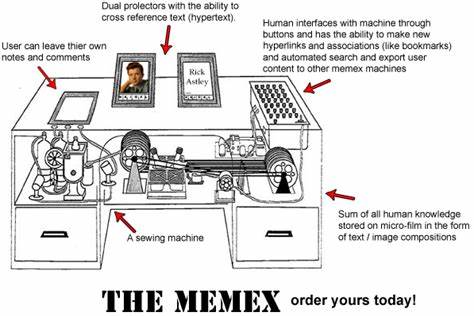

В июле 1945 года, когда война едва подходила к своему завершению, а мир стоял на пороге новой эры - эры атомного оружия, Ванневера Буша, тогдашнего директора Управления научных исследований и разработок США, больше волновал не только разрушительный потенциал технологий, но и проблема, которая не менее важна - как человечеству справиться с лавинообразно растущим потоком информации. Его знаменитое эссе "Как мы можем думать" предлагало решение, основанное на идее машины под названием мемекс - концептуального механизированного стола, предназначенного не просто для хранения данных, а для создания ассоциативных связей между знаниями. Эта машина должна была стать "увеличенным интимным дополнением" человеческой памяти, позволяя пользователю легко создавать и прослеживать маршруты мысли по ассоциативным цепочкам, свободным от ограничений традиционной иерархии данных.Несмотря на то что мемекс был построен на тогдашних технологиях - микрофильмах и аналоговых механизмах - его суть радикально опережала время. Буш понимал, что истинный кризис - это не просто информационный шум, а несоответствие инструментов управления знаниями способу, каким работает человеческий разум.

Создавая эту машину, он заложил основу для современного понятия гипертекста и интернета - системы, которая в идеале должна была служить организующим принципом выбора и навигации по огромным массивам информации.В четырех десятилетиях после публикации эссе мемекс вдохновил многих пионеров компьютерной эпохи. Изобретатели, такие как Дуглас Энгельбарт, черпали идеи из концепции Буша, разрабатывая интерфейсы, призванные расширить возможности человеческого интеллекта. Термин "гипертекст", введенный Тедом Нельсоном, стал ключом к пониманию взаимосвязанных информационных структур, а окончательным воплощением этих идей стал Всемирный паутина - инфраструктура, превращающая знания в доступную и взаимосвязанную экосистему.Однако в то же время, когда Интернет открыл всем доступ к безграничным массивам данных, он не решил проблему информационной перегрузки, а лишь усложнил её.

Фильтры, рекомендательные системы и алгоритмы вовлечения, ориентированные на коммерческий успех, превратили сеть в арену для дезинформации, манипуляций и фрагментации общественного сознания. Как результат, мир столкнулся с новым вызовом: не просто обилием информации, а утратой доверия к ней и невозможностью различить правду и ложь в цифровом пространстве.В начале 21 века параллельно развивалось направление искусственного интеллекта. Британский ученый Джеффри Хинтон, один из основателей современной нейросетевой науки, посвятил свою жизнь изучению того, как мозг обучается, и пытался создать машины, способные приобрести аналогичный опыт. Долгие годы его идеи воспринимались скептически, поскольку символические подходы к ИИ были доминирующими.

Но с ростом вычислительных мощностей и доступностью огромных данных, концепция глубокого обучения и нейронных сетей получила своё признание и осуществилась революционным прорывом.Хинтон заметил поразительные способности современных языковых моделей, таких как GPT-4, которые обнаруживают не просто механическое воспроизведение текста, а проявление "возникающих свойств": умение обучаться на небольшом количестве примеров, рассуждать и обрабатывать сложные концепции. Его осознание того факта, что искусственные модели с меньшим числом нейронных связей, чем человеческий мозг, могут обладать знаниями намного шире любого отдельного человека, вызвало пересмотр взглядов на развитие ИИ и его возможности.Тем не менее, именно этот прорыв активизировал озабоченность относительно "проблемы выравнивания" - вопроса о том, как гарантировать, что сверхразумные системы будут действовать в интересах человечества. Оптимизация AI под конкретные цели, если её не контролировать, может привести к непредсказуемым и опасным последствиям, вплоть до угрозы существованию людей.

Более того, обучение на реальных данных делает искусственный интеллект уязвимым к поглощению человеческих противоречий, предубеждений и даже преступных практик в политике и обществе.Вызов выравнивания - это не только технический вопрос, но и фундаментальная философская дилемма. Поскольку человеческие ценности разнообразны, а порой и конфликтуют друг с другом, то задача создания системы ИИ, способной однозначно интерпретировать эти ценности и принимать решения, соответствующие человеческим ожиданиям, становится чрезвычайно сложной. Более того, с усилением интеллекта машин возникает вопрос, сможет ли менее умная человеческая цивилизация контролировать искусственный разум, обладающий собственными целями и стратегиями.Подобно тому, как ученые атомного века осознали ужасающие последствия своих открытий только в конце пути, инженеры ИИ сегодня стоят перед моральной дилеммой.

Несмотря на обнадеживающие перспективы решения глобальных проблем через технологии, мир оказался втянутым в гонку искусственного интеллекта, где коммерческие и стратегические интересы часто превалируют над безопасностью и этикой. Это приводит к рискам быстрого внедрения, недостаточного контроля и растущей уязвимости общества перед манипуляциями.История развития интеллекта - от мемекса Ванневера Буша до самонастраивающихся нейросетей - показывает, что путь технического прогресса зачастую является двояким. Машины, призванные расширить возможности человеческого мышления, способны одновременно стать источником глубочайших угроз. Проблемы управления знанием трансформировались из вопросов упорядочивания информации в вопросы сохранения объективной реальности и контроля над силами, которых мы создаем.

Наша современность требует переосмысления дуализма между возможностями и рисками. Инновации в области искусственного интеллекта вызывают как восхищение своим потенциалом, так и страхи перед потерей контроля. В этом свете вызов "как мы можем думать" приобретает новую остроту - не просто с точки зрения расширения человеческого интеллекта, а как вопрос выживания и сохранения общих ценностей. Решение этой задачи требует согласованных усилий не только ученых и инженеров, но и политиков, философов, сообществ и общества в целом.Трансформация информационных технологий за восемьдесят лет - от идеи мемекса, который должен был защищать человеческий разум от хаоса данных, до создания систем, способных манипулировать знаниями и реальностью - является ключевым фактором в текущем глобальном вызове.

Осознание того, что технологии могут как служить светом познания, так и тенью угрозы, определяет современное понимание ответственности и необходимости разработки безопасных, этичных и управляемых систем искусственного интеллекта.Продвижение к интеллектуальному спасению человечества и риски существования на пороге технологической революции - две стороны одной монеты. В этом балансе необходимо искать новые стратегии, которые объединят амбиции прогресса с глубоким уважением к опасностям, заложенным в самой природе созданных нами интеллектуальных систем. История Буша и Хинтона является напоминанием о том, что технологии - это не просто инструменты, а отражение человеческих надежд, страхов и ответственности за будущее. .