Современный мир уже невозможно представить без искусственного интеллекта (ИИ). От поисковых систем и социальных сетей до офисных приложений и развлекательных сервисов – ИИ проник практически во все сферы цифровой жизни. Однако популярность этой технологии зачастую воспринимается как следствие естественного интереса пользователей и их потребностей. На самом деле крупные технологические корпорации целенаправленно и систематически навязывают искусственный интеллект широкой аудитории, используя тщательно продуманные стратегии и дизайн интерфейсов, заставляющие миллиарды людей взаимодействовать с ИИ вне их желания или осознанного выбора.Несмотря на активное продвижение отдельных продуктов, подобных чат-ботам и генеративным ассистентам, многие широкие слои пользователей не проявляют органического интереса к ИИ-инструментам.

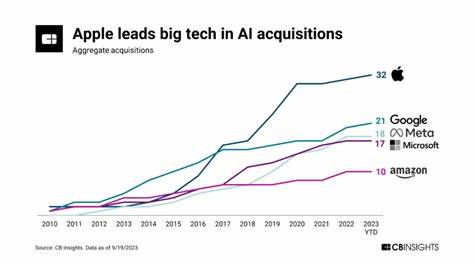

Большинство людей даже не обсуждают такие сервисы, как Gemini или AI-продукты Meta, а широкие внедрение функций с искусственным интеллектом зачастую воспринимается скорее как навязывание, а не как естественное развитие технологий.Основой для подобных выводов стала исследовательская работа группы дизайн-учёных, которая детально проанализировала сотни примеров интеграции ИИ функций в продукты крупнейших технологических компаний — Google, Meta, Adobe, SnapChat и других. Исследование показало, что компании делают ИИ настолько заметным и навязчивым, что взаимодействие с ним становится почти неизбежным. Среди приёмов, которые используют IT-гиганты, выделяются визуальное доминирование AI-элементов на экранах пользователей, присутствие множества всплывающих окон с призывами попробовать AI-функции, а также поощрение к взаимодействию с ИИ через специально выделенные кнопки, обычно окрашенные в эффектный сиренево-голубой цвет. Яркая цветовая гамма призвана вызывать ассоциации с магией и волшебством, усиливая интерес и доверие к продукту.

Примечательно, что в некоторых продуктах ИИ-функции включены по умолчанию или активируются ещё до того, как пользователь сможет дать согласие на их использование или отключить их. Самые яркие примеры – Google, где в поисковой выдаче подсовываются AI-сниппеты даже если пользователь не запрашивал их, а также Snapchat, где чат-бот MyAI располагается в самом верхнем списке контактов и не может быть удалён или скрыт. Эти действия свидетельствуют о намеренном навязывании технологий, игнорирующем предпочтения и комфорт пользователей.Навязывание искусственного интеллекта идёт рука об руку с ухудшением пользовательского опыта в традиционных интерфейсах. Частые прерывания рабочего процесса всплывающими окнами и баннерами с рекламой AI-инструментов и подсказками заставляют пользователей отвлекаться и тратить лишнее время, пытаясь продолжить работу в привычных приложениях.

В некоторых сервисах пространство экрана, которое раньше занимали активные элементы управления функционалом, урезается в пользу выделения места для AI-компонентов, что зачастую вызывает раздражение и приводит к росту негативных отзывов.Проблема усугубляется, когда возможность легкого отказа от AI-функций либо не предоставляется вовсе, либо скрыта глубоко в настройках, делая их деактивацию сложной задачей для обычного пользователя. Такие практики, по мнению экспертов, относятся к манипулированию архитектурой визуального выбора (choice architecture), когда дизайн интерфейса специально устроен так, чтобы подталкивать пользователя к нужному действию — в случае ИИ это значит к его использованию.В конечном итоге, политика крупнейших технологических компаний вызывает серьёзные вопросы не только с точки зрения удобства и свободы пользователей, но и в контексте этики и регулирования. С помпой продвигаемые функции искусственного интеллекта зачастую работают как мощные инструменты сбора и анализа личных данных без явного информирования об этом пользователей.

В дополнение к этому, обостряется проблема «омоложения» интернета, когда новые AI-вставки усложняют привычные сервисы, повышая порог необходимой для их освоения компетенции и расширяя возможности для монополизации цифрового пространства.Примечательно, что, несмотря на обилие маркетинговых обещаний и громких заявлений об управляемости и прозрачности ИИ, видные научные исследования указывают на обратное. Многие ведущие специалисты в области искусственного интеллекта признают, что внутренние механизмы современных моделей уже практически вышли из-под контроля человека, а попытки полностью понять и регулировать эти процессы порой становятся невозможными. Это несёт дополнительные риски для прав пользователей и общества в целом, поскольку такие технологии могут действовать без возможности предсказания и вмешательства.Кроме того, корпоративные структуры, стоящие за продвижением ИИ, порой демонстрируют сильное двойное дно.

Так, OpenAI управляется сложной многослойной системой, где небольшой некоммерческий орган претендует на контроль над корпорацией с прибыльной моделью, создавая путаницу в целях и мотивах развития искусственного интеллекта. Недавние отчёты этой организации содержат благозвучные декларации о «демократизации» и «инвестициях в людей», параллельно с активной лоббистской деятельностью по ограничению законодательного регулирования ИИ в различных юрисдикциях.Все эти факты дают основания полагать, что масштабное распространение и навязывание ИИ в цифровой экосистеме связано не только с объективным прогрессом технологии или реальным запросом пользователей. Скорее, это результат системной стратегии крупных игроков IT-индустрии, нацеленной на усиление своих позиций, контроль за пользовательскими данными, а также поддержание высокого уровня интереса и прибыли. При этом рядовые пользователи оказываются в ситуации, когда им сложно отказаться от использования навязанных AI-инструментов, несмотря на то, что многие из них воспринимают это как назойливое вмешательство и потерю удобства.