В последние годы искусственный интеллект стремительно внедряется в повседневную работу компаний по всему миру. Сотрудники используют ИИ для повышения эффективности и автоматизации рутинных задач. Однако вместе с этим растёт так называемый феномен теневого ИИ — использование несанкционированных инструментов и моделей искусственного интеллекта, что приводит к утечкам конфиденциальной и корпоративной информации. Многие специалисты считают теневой ИИ серьёзной угрозой. Но, возможно, он не проблема сам по себе, а важный сигнал для корпоративного управления и IT-безопасности.

Теневой ИИ — это неудобный, но крайне полезный индикатор. Он указывает на неудовлетворённость сотрудников доступными внутрикорпоративными инструментами и свидетельствует о потребности в более современных и удобных решениях. На практике около трети сотрудников уже признаются, что применяют неутверждённые компанией модели и сервисы ИИ в работе. Реальное число значительно выше, если учесть скрытность такого использования. Сотрудники стремятся максимально упростить свои задачи и зачастую прибегают к популярным внешним ИИ-платформам, не задумываясь о рисках безопасности.

Проблема теневого ИИ становится особенно острой из-за недостаточности контекста в большинстве коммерческих моделей. Например, если попросить современную модель, такую как ChatGPT, написать деловое письмо без предоставления конкретных данных о клиенте и истории взаимодействия, вероятность получить релевантный и эффективный ответ будет низкой. Напротив, более старые, но локально развернутые модели, с доступом к внутренним данным, способны дать куда более качественный результат простой и короткой подсказки. Это подчёркивает, что контекст — ключевой фактор успеха применения ИИ в бизнесе. Отказ сотрудников от теневого ИИ возможен только при обеспечении им доступных, удобных и безопасных инструментов с полным контекстом их задач.

Политики и запреты — это пережиток прошлого. Они вряд ли смогут остановить сотрудников, которые увидели, что внешние ИИ улучшают качество и скорость их работы. В эпоху быстрого технологического прогресса игнорировать человеческий фактор и предпочтения пользователей просто невозможно. Суть вызова заключается в том, что корпоративные данные становятся «золотой жилой» для обучения ИИ. Публичные данные, доступные для тренировки моделей в Интернете, постепенно исчерпываются.

Вся ценность теперь сосредоточена во внутренней информации компаний — отчетах, базах CRM, документах, заметках и переписке. Это делает защиту таких данных критически важной задачей для бизнеса. Нередки случаи, когда даже специалисты по ИИ и безопасности случайно вводят конфиденциальную информацию в незащищённые модели, потому что забывают проверить контекст или просто спешат. Следовательно, вопрос не только в жёстком контроле, а в создании таких условий, чтобы сотрудникам было проще и безопаснее работать с одобренными ИИ-системами. Реализация концепции моделей с контекстным доступом решает многие задачи одновременно.

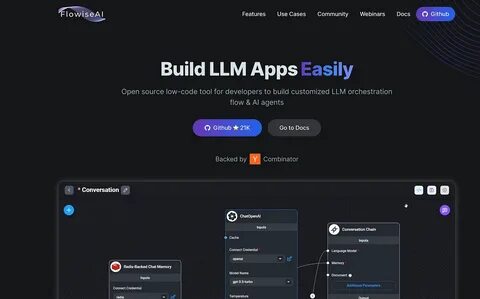

Если модель получает возможность самостоятельно извлекать нужные данные из защищённых корпоративных систем, будь то CRM, внутренние базы или иные источники, сотрудникам достаточно лишь отдавать команду на выполнение задачи. Это минимизирует риск утечек и ошибок, упрощает процесс и повышает качество конечного результата. Современный тренд — переход к архитектурам в стиле Zero Trust (нулевого доверия), которые требуют непрерывной проверки и аутентификации для каждого действия с данными. Интеграция Zero Trust с AI-платформами позволяет создать безопасную среду, где ИИ используется эффективно, а корпоративные данные остаются под надёжной защитой. Недавние разработки, такие как Model Context Protocol, направлены на унификацию способов, с помощью которых ИИ может получать доступ к данным, обеспечивая при этом безопасность и прозрачность.

Использование таких технологий позволяет компаниям быстро развернуть собственные ИИ-системы на базе открытых моделей, настраивая их под себя и контролируя процесс обработки и хранения данных. Для бизнеса это открывает новые горизонты. Во-первых, значительно сокращаются затраты на лицензирование внешних сервисов и риски, связанные с утечками. Во-вторых, повышается скорость работы и качество решений, так как персонализированный ИИ понимает специфику деятельности компании и задачи каждого подразделения. В-третьих, улучшается корпоративная культура — сотрудники не видят препятствий и ограничений, а наоборот получают поддержку в работе.

Использование теневого ИИ — это вызов для традиционных моделей управления рисками. Однако его появление должно восприниматься не просто как угроза, а скорее как мощный стимул к обновлению и модернизации корпоративных AI-систем. Пытаться бороться с этим явлением исключительно через запреты и мониторинг — значит упускать возможность выиграть конкурентное преимущество. Лучшим ответом на теневой ИИ становится предложение сотрудникам более удобного и безопасного инструментария. Это невозможно без тесного сотрудничества специалистов по безопасности, разработчиков и конечных пользователей.

Только вместе можно создать платформы, которые будут одновременно продуктивными и надёжными. В перспективе именно такие контекстно-ориентированные и защищённые решения определят новый уровень корпоративного ИИ. Компании, которые смогут быстро адаптироваться и внедрить эти технологии, получат значительное преимущество на рынке. Их сотрудники будут работать быстрее и эффективнее, а данные — надежно защищены. Поэтому, теневой ИИ — не враг, а важный сигнал.