В современном мире развитие технологий искусственного интеллекта идет семимильными шагами, особое внимание уделяется большим языковым моделям (БЯМ или LLM — Large Language Models). Эти технологии уже сегодня трансформируют все сферы жизни — от образования и медицины до политики и экономического управления. Однако вместе с очевидными преимуществами возникают серьезные вызовы, связанные с понятием суверенитета, который традиционно обусловлен контролем государства над собственной политической, экономической и информационной средой. Именно эти вопросы становятся ключевыми при оценке влияния больших языковых моделей на государство и общество в целом. Появление и молниеносное распространение LLM кардинально изменило способ взаимодействия человека с информацией.

Когда несколько лет назад пользователи с опаской относились к таким технологиям, опасаясь ошибок и недостаточной надежности, сегодня LLM широко внедрены в самые чувствительные сферы. Студенты используют их для написания учебных работ, юристы — для подготовки документов, политики — для разработки стратегий и публичных обращений. Ответы больших языковых моделей не только приходят мгновенно, но и звучат убедительно, оформлены достойно и могут быть адаптированы под разный уровень сложности, что делает их крайне привлекательными для широкой аудитории. Однако широкое внедрение LLM обнажило проблему так называемой «аналого́вой дыры»: даже если организация формально запрещает использовать ИИ, в реальности конечное выполнение задачи остается на совести отдельного человека. Он может свободно обращаться к моделям искусственного интеллекта для получения информации или решения вопросов без возможности контроля со стороны.

Это приводит к тому, что практически все сферы деятельности могут опираться на данные и решения, генерируемые LLM. Основа демократического общества — суверенитет народа, который проявляется через информированность граждан и прозрачность политических процессов. В случае массового использования LLM для получения знания возникает новая парадигма — власть над информацией перемещается к создателям и операторам языковых моделей. Если искусственный интеллект задает тон и формирует рамки обсуждений, а также влияет на восприятие фактов, то где граница между объективным пониманием мира и манипулируемым мнением? Централизация — один из самых значимых трендов в развитии LLM. Множество научных и промышленных экспертов сходятся во мнении, что из-за масштабных затрат на обучение и поддержку моделей, а также необходимости огромных мощностей в области вычислений и хранения данных, число ведущих разработчиков LLM сократится до нескольких крупных компаний.

В США и Китае уже сформировались лидирующие корпорации в этой области, обладающие ресурсами для постоянного улучшения своих систем. Европа и многие другие регионы испытывают проблемы с попаданием в этот клуб, главным образом из-за высокой стоимости инфраструктуры и неоптимальных регуляторных мер. Такое положение вещей вызывает тревогу в контексте национальной безопасности и цифрового суверенитета. Если страна не контролирует ключевые технологии ИИ, включая базы данных, обучение моделей и их эксплуатацию, она рискует оказаться в зависимости от технологий, формирующих общественное мнение и государственные решения. Возможность владения и контроля над собственными LLM становится неотъемлемой частью концепции суверенитета в цифровом мире.

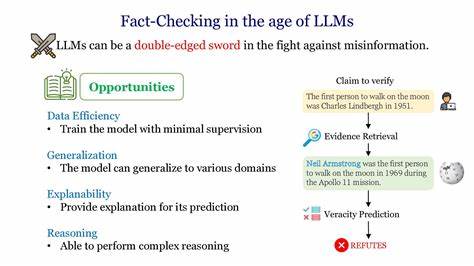

Психологическая уязвимость пользователей — еще одна грань проблемы. Все чаще появляются сообщения о зависимости людей от общения с искусственным интеллектом, использовании ИИ в качестве компаньона или терапевта. Подобные тенденции могут привести не только к утрате критического мышления, но и к появлению целых социальных групп, формирующих свои взгляды исключительно на основе ИИ, что усиливает риск манипуляций и распространения пропаганды. Манипуляции через LLM протекают не только на уровне явных фейков или откровенной дезинформации. Часто достаточно тонких вариантов подачи информации или выбора формулировок, способных создать сомнения в фактах или тенденциозно представить события.

Примером могут служить ответы на исторические вопросы, где одна формулировка дает ощущение устоявшейся истины, а другая — намек на «альтернативные теории». Такие нагрузки через миллионы взаимодействий способны менять мировоззрение целых обществ, и влияние здесь существенно превышает те, что наблюдались ранее в социальных сетях. В процессе консолидации цифровых ресурсов возникает также дискуссия о формировании международных альянсов и совместных инициатив для обеспечения доступа к передовым ИИ-ресурсам. Практическим примером служит инициатива Public AI Inference Utility, поддерживающая развитие суверенных моделей для отдельных стран с центрами в Европе и Северной Америке. Подобные проекты направлены на преодоление разрыва между технологическими державами и остальным миром, объединяя усилия для сохранения цифровой автономии и снижения зависимости от узколокальных поставщиков ИИ.

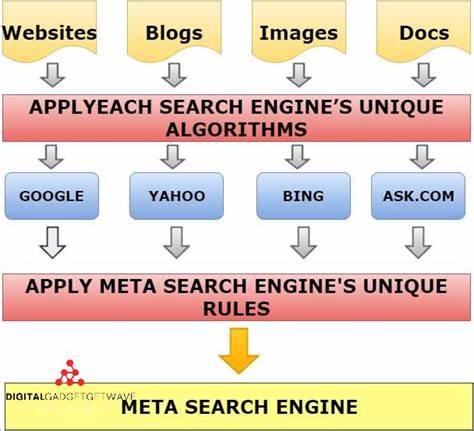

Вместе с тем существует и альтернативный взгляд, фокусирующийся не столько на создании собственных полностью автономных LLM, сколько на развитии «цифровой автономии». Речь идет о построении систем, способных гибко использовать различные модели и при необходимости заменять поставщиков без потери качества сервиса и прозрачности. Такое подход учитывает экономические реалии, масштабирование и требует развитой инфраструктуры контроля за данными и алгоритмической справедливостью. Важнейшей предпосылкой цифровой автономии является владение и управление собственными данными. Компании на рынке искусственного интеллекта стремятся «запереть» пользователей в своих экосистемах, аккумулируя данные в закрытых форматах и инфраструктурах.

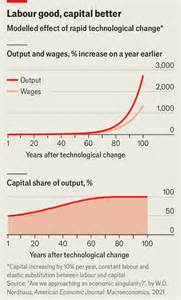

Такая практика усиливает централизацию и ограничивает возможности выбора как граждан, так и целых государств. Поддержание открытости и контролируемого обмена данными становится стратегическим вызовом современности. Помимо суверенитета и автономии, вопрос цифровых языковых моделей касается и глубоких социальных и экономических преобразований. Технологии ИИ интегрируются во все звенья государственно-управленческой системы, что делает владение ими не просто вопросом гордости, а необходимостью для безопасности и эффективности управления. Пренебрежение этими факторами может вызвать технологическую отсталость, зависимость и даже эрозию принципов демократии, если ключевые решения будут опираться на внешние источники, неподконтрольные национальным институтам.

В заключение стоит отметить, что переход к эпохе, где большие языковые модели играют решающую роль в формировании знаний и власти, требует новых подходов к пониманию суверенитета. Государствам необходимо переосмыслить свою стратегию в отношении технологий, инвестировать в инфраструктуру, создавать партнерства между государственным и частным секторами, а также развивать международное сотрудничество на базе доверия и прозрачности. В условиях стремительной централизации и масштабирования инноваций именно способность контролировать и адаптировать собственные ИИ-ресурсы станет ключом к сохранению суверенитета, устойчивости и демократичности обществ в будущем.